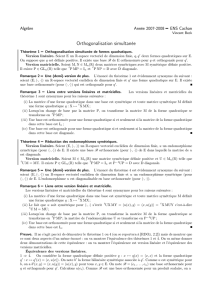

Algèbre bilinéaire cor

Algèbre bilinéaire

Les espaces vectoriels considérés sont des espaces sur IR

Montrer qu’une application est un produit scalaire

Définition du produit scalaire

Un produit scalaire sur un ℝ-espace vectoriel est une application

de E X E dans ℝ ( forme ), (u,v) (u,v)

symétrique : (u,v) = (v,u)

bilinéaire : ℝ, u,v,w E , (u+v,w) = (u,w) + (v,w)

définie : u,u) = 0 u = OE

positive : (u,u) 0

Théorème utile sur les

intégrales pour montrer que

certaines formes sont définies

si a < b, si f est une fonction positive et CONTINUE sur [ a, b ] et si

= 0 alors f = 0

Ce théorème s’applique aussi pour a = - et pour b = +

Produit scalaire canonique sur

IRn

Base orthonormée de IRn

< (x1 , ... , xn) , (y1,...,yn)> =

= tX Y avec X =

et Y =

La base canonique de ℝn est une b.o.n. pour le produit scalaire usuel.

Expression du produit scalaire

dans une base orthonormée

Dans une b.o.n de E, si on note U la matrice colonne formée des coordonnées d’un vecteur

u dans la b.o.n, on a : < u , v > = tU V

Reconnaître une norme euclidienne

Définition d’une norme

euclidienne

On appelle norme euclidienne sur un ℝ-ev E toute application N de E dans ℝ+ telle qu’il

existe un produit scalaire < , > sur E vérifiant :

u E, N(u) =

Passage de la norme

euclidienne au produit

scalaire associé

u,v E, <u,v> =

( )

=

( )

Expression matricielle de la

norme dans une base

orthonormée

Dans une b.o.n. : = tU . U

où U est la matrice colonne formée des coordonnées de u E dans la b.o.n.

Cauchy-Schwarz

Inégalité

u,v E , | < u , v > | ≤

Cas d’égalité

| < u , v > | = u et v colinéaires

Orthogonalité

Vecteurs orthogonaux

u v < u ,v > = 0

Famille de vecteurs

orthogonaux et familles libres

Toutes familles formées de vecteurs non nuls et deux à deux orthogonaux est libre

Espaces vectoriels

orthogonaux

Deux sev F et G de E sont orthogonaux ssi : u F, v G , <u,v>=0

Caractérisation des sev

orthogonaux à partir de leurs

bases

Soient deux sev F et G de E munis de bases respectives BF et BG.

F et G sont orthogonaux ssi tout vecteur de BF est orthogonal à tout vecteur de BG

Orthogonal d’un sev

Orthogonal de E

Orthogonal de { OE }

supplémentarité

Soit F un sev de E

On appelle orthogonal de F le sev de E noté F égal aux vecteurs orthogonaux à touts les

vecteurs de F.

E = { OE} , { OE]} = E

F F = E . En dimension finie, dim F = dim E – dim F

Cas des sev propres d’un

endomorphisme symétrique

Des sev propres d’un endomorphisme symétrique, associés à des valeurs propres distinctes

sont deux à deux orthogonaux

Cas des projections

orthogonales

Une projection orthogonale sur un sev F de E est une projection sur F parallèlement à F

Théorème de Pythagore

Généralisation

u v

Si u1,...,un sont deux à deux orthogonaux alors

Projections orthogonales

Définition

p est une projection orthogonale ssi p est la projection sur un sev F parallèlement à F

Caractérisation à partir de

l’image et du noyau

Une projection p est une projection orthogonale ssi Ker p = Im p

Caractérisation par orthogonalité

de vecteurs

Une projection p est une projection orthogonale sur F ssi

u E, p(u) F et u-p(u) F

Expression du projeté orthogonal

d’un vecteur u sur un ev F muni

d’une base orthonormée

Si F est muni d’une b.o.n. ( e1,...,en) et si p est la projection orthogonale sur F alors

u E , p(u) =

Lien entre la projection

orthogonale p sur F et la

projection orthogonale q sur F

Si p est la projection orthogonale sur F et q la projection orthogonale sur F alors

p = q = idE

Caractérisation par minimisation

de la norme

Soit u E , F un sev de E. min { F } = où p est la projection

orthogonale sur F.

Lorsque x parcourt F, les normes , atteignent leur minimum pour x = p(u)

Distance d’un vecteur u à un

sev F

la distance et u à F est la norme où p est la projection orthogonale sur F.

Bases orthonormées dans un espace euclidien

Définition d’un espace

euclidien

Un espace euclidien est un ℝ-ev de dimension finie et muni d’un produit scalaire.

Définition d’une base

orthonormée

Une base orthonormée d’un espace euclidien de dimension n est une famille de n vecteurs

unitaires de E et deux à deux orthogonaux.

Existence de bases

orthonormées

Tout espace euclidien admet une base orthonormée.

Construction de bases

orthonormées

Le procédé de Schmidt permet de construire une b.o.n. (u1,...,un) à partir d’une base

(e1,...,en) de E en respectant pour tout k 1, n :

Vect[ e1,...,ek] = Vect[ u1,...,uk ]

Coordonnées d’un vecteur

dans une base orthonormée

Les coordonnées d’un vecteur u dans une b.o.n. (e1,...,en) sont xi = < u , ei >

Ainsi u =

Théorème de la base

orthonormée incomplète

Toute famille de vecteurs unitaires deux à deux orthogonaux peut être complétée en une

base orthonormée de E.

Construction d’un vecteur

unitaire à partir d’un vecteur

u non nul

Si u OE alors

u est unitaire

Matrice de passage d’une base

orthonormée à une autre

La matrice de passage P d’une b.o.n. à une b.o.n. vérifie P-1 = t P

Problèmes de minimisation

A partir d’une projection

orthogonale

Soit u E , F un sev de E. min { F } = où p est la projection

orthogonale sur F.

Lorsque x parcourt F, les normes , atteignent leur minimum pour x = p(u)

Problème des moindres carrés

Il est lié à la norme de matrices et donne la meilleure solution approchée de AX=B.

Soit A Mn,p (ℝ) telle que rg A = p ( = nombre des colonnes de A ), soit une matrice

colonne B Mn,1(ℝ).

Il existe une unique matrice colonne X Mp,1(ℝ) telle que soit minimale. Cette

matrice est solution de tA A X = tA B.

Ajustement affine d’une série

statistique double, droite de

régression linéaire de y en x

Etant donnée une série statistique double : ( x1 , y1) , ... , (xn, yn).

Il existe une droite y = (x)= ax+b qui minimise la somme

C’est la droite de régression linéaire de y

en x par la méthode des moindres carrés.

Son équation est : y = (x) =

Droite de régression linéaire

de x en y par la méthode des

moindres carrés.

C’est la droite x = (y)= ay+b qui minimise la somme

. Son équation est : x =

Endomorphismes symétriques

Définition

Un endomorphisme d’un espace euclidien E est symétrique ssi

u,v E , < (u) , v > = < u , (v) >

Caractérisation par sa matrice

dans une base orthonormée

Un endomorphisme d’un espace euclidien E est symétrique si et seulement si sa matrice

dans une base ORTHORMÉE est symétrique .

Attention, il faut que la base soit une b.o.n.

Valeurs propres

Un endomorphisme symétrique a toutes ses valeurs propres réelles

Sev propres

Les sev propres d’un endomorphisme symétrique de E sont deux à deux orthogonaux et

leur somme est directe, égale à E.

Réduction et base de vecteurs

propres

Tout endomorphisme symétrique de E est diagonalisable et il existe une b.o.n. de E

formée de vecteurs propres de .

Lien avec les formes

quadratiques

Si est un endomorphisme symétrique de ℝn alors l’application ℝn ℝ , u < (u) , u >

est une forme quadratique sur E

Matrices réelles symétriques

Définition

Une matrice carrée M est symétrique ssi tM = M

Valeurs propres

Les valeurs propres d’une matrice symétrique à coefficients réels sont toutes réelles

Réduction

Toute matrice symétrique à coefficients réels est ℝ-diagonalisable.

Toute matrice A réelle symétrique s’écrit A = P D tP où D est une matrice diagonale

formée des valeurs propres de A, P est une matrice orthogonale, matrice de passage de la

base canonique ( b.o.n.) à une b.o.n. de vecteurs propres de A.

Décomposition à l’aide d’une

base orthonormée de

vecteurs propres

Si ( Xi)1 ≤ i ≤ n est une b.o.n. de vecteurs colonnes propres d’une matrice réelle symétrique A

telle que 1 soit la valeur propre associée à Xi alors :

A =

Formes quadratiques

Définition

Une forme quadratique sur ℝn est un polynôme de ℝn dans ℝ homogène de degré 2.

q(x1,...,xn) =

où ai j ℝ.

Matrice symétrique associée à

une forme quadratique

Soit q une forme quadratique sur ℝn. La matrice de q est la matrice M symétrique de Mn(ℝ) telle

que : q(X) = tX M X.

Ses termes diagonaux sont les coefficients ai i de xi².

Ses autres termes de ligne i et de colonne j sont

ai j où ai j est le coefficient de xi xj dans q(x)

Endomorphisme symétrique

associé à une forme

quadratique

Si q est une forme quadratique, on appelle endomorphisme symétrique associé à q

l’endomorphisme de ℝn tel que q(x) = < (x) , x >.

est l’endomorphisme de ℝn canoniquement associé à la matrice M (symétrique ) de q.

Forme bilinéaire symétrique

associée à une forme

quadratique

La forme bilinéaire symétrique associée à une forme quadratique q de ℝn est :

ℝn X ℝn ℝ , ( X , Y ) f(X,Y) = tX M Y où M est la matrice de q et X,Y les matrices colonnes

canoniquement associées aux vecteurs de ℝn.

Si q(x) =

alors f(x,y) =

où bi i = ai i et bi j =

si i j

Par conséquent : q(x) = f(x,x)

Signe d’une forme

quadratique à partir de

valeurs propres

Soit q une forme quadratique de matrice M.

q est positive ( x ℝn, q(x) 0 ) ssi toutes les valeurs propres de M sont positives.

q est strictement positive ( x OIRn , q(x) > 0) ssi toutes les valeurs propres de M sont dans ℝ+*

q est négative ( x ℝn, q(x) ≤ 0 ) ssi toutes les valeurs propres de M sont négatives.

q est strictement négative ( x OIRn , q(x) < 0) ssi toutes les valeurs propres de M sont dans ℝ-*

Décomposition en

combinaison linéaire de

carrés (2 méthodes)

q(x) se décompose en combinaison linéaire de termes du type (ai xi + ... + akxk)²

- 1ère méthode : on regroupe les termes comprenant une même variable xk et s’il y a xk² on

reconnaît le début d’un carré. S’il n’y a pas de carré , on regroupe les termes comprenant deux

même variable et utilise (a-b)(a+b)

- 2ème méthode : Si ( e1 , ... , en) est une b.o.n. de vecteurs propres de la matrice symétrique de q

associés respectivement aux valeurs propres 1 , ... , n, alors q(x) =

où x =

.

Exemple

q(x,y,z,t) = 2xy – yz + xz + xt + 2yt - zt

on prend le terme en xy et on regroupe tous les termes contenant x et tous ceux contenant y :

q(x,y,z,t) = 2xy + x ( z+t) + y (-z+2t) - zt

On reconnaît dans l’encadré le début de (a+b) (a-b) :

2 (x +

) ( y +

) –

= 2 ( a+b) (a-b) - –

avec a =

(x +

) + ( y +

et b =

(x +

) - ( y +

)....

1

/

5

100%