1 Variable aléatoire

Probabilités : Rappels de première

1 Variable aléatoire

Définition 1 : Variable aléatoire

Soit Ωl’univers d’une expérience aléatoire.

On appelle variable aléatoire toute fonction Xde Ωdans Rqui, à tout élément de Ω,

fait correspondre un nombre réel x.

Exemple 1 : Par exemple le gain obtenu à l’occasion d’un jeu de hasard ou encore le

temps d’attente d’un bus.

Définition 2 : Loi de probabilité d’une variable aléatoire

Soit Ω = {ω1;ω2;...;ωn}un univers associé à une expérience aléatoire sur lequel a

été définie une loi de probabilité et Ω′={x1;x2;...;xn}l’ensemble des valeurs prises

par une variable aléatoire X.

La loi de probabilité de Xest la fonction définie sur Ω′, qui à chaque xifait correspondre

le nombre pi=p(X=xi). On la représente en général dans un tableau :

xix1x2. . . xn

p(X=xi)p1=p(X=x1)p2=p(X=x2). . . pn=p(X=xn)

Exemple 2 : On tire une carte d’un jeu de 32 cartes. Si l’on tire un coeur, on gagne 8e,

sinon, on perd 4e.Ωest l’ensemble des 32 cartes et on peut définir la variable aléatoire

Xsur Ωqui, à chaque carte associe le gain. La loi de Xest xi−4 8

p(X=xi)3

4

1

4

Définition 3 Espérance, variance, écart-type

L’espérance mathématique, la variance et l’écart-type de la variable aléatoire Xsont

respectivement les nombres :

E(X) = p1x1+p2x2+···+pnxn=Pn

i=1 pixi

V(X) = Pn

i=1 pi)(xi−E(X))2=Pn

i=1 pi)x2

i−E(X)2

σ(X) = pV(X)

Exemple 3 Dans l’exemple 2, l’espérance de Xest E(X) = 3

4×(−4) + 1

4×8 = 1. Cela

veut dire que le gain moyen à ce jeu stupide est de 1e. C’est un jeu favorable au joueur

Le signe de E(X)permet donc de savoir si le joueur a plus de chances de gagner que

de perdre. Si E(X) = 0, on dit que le jeu est équitable. L’écart-type de Xpermet, lui,

d’évaluer le "risque" du jeu : plus l’écart-type est grand plus le risque de perdre ou de

gagner est important.

1

2 Loi binomiale

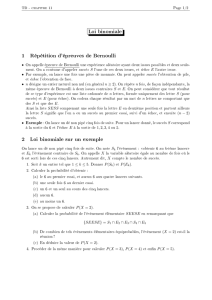

2.1 Loi de Bernoulli

Définition 4 On appelle épreuve de Bernoulli de paramètre ptoute épreuve aléatoire

admettant exactement deux issues :

– l’une appelée succès dont la probabilité d’apparaître est p;

– l’autre appelée échec dont la probabilité d’apparaître est 1−p.

La loi de Bernoulli est donc résumée dans le tableau suivant (on note 0l’échec et 1le

succès) :

xi0 1

p(X=xi) 1 −p p

On dit que la variable aléatoire Xsuit une loi de Bernoulli de paramètre pet on note

X∼B(p).

Exemple 4 :

– Lancer d’une pièce de monnaie équilibrée, avec pour issues contraires PILE (pro-

babilité p=1

2) et FACE (probabilité q= 1 −p=1

2).

– Tirage d’une boule contenant 70 boules blanches et 30 boules rouges, avec pour

issues contraires :

–S: tirer une boule blanche (p= 0,7)

–E=S: tirer une boule rouge (q= 0,3)

2.2 Loi binomiale

Définition 5 On appelle schéma de népreuves de Bernoulli de paramètre ptoute

expérience aléatoire consistant à répéter nfois de manière indépendante une épreuve

de Bernoulli de paramètre p.

Un résultat d’une telle expérience est une liste de nissues (SE. . .SSE). La variable

aléatoire Xà valeurs dans {0,1,2. . . n}associant à chaque issue le nombre de succès

suit la loi binomiale de paramètres net pnotée B(n, p)

Propriété 1 Si Xsuit une loi binomiale de paramètres net pon a :

p(X=k) = n

kpk(1 −p)n−k, k ∈ {0; 1; 2; ...;n}

Remarque 1 Les n

kappelés coefficients binomiaux se calculent à l’aide de la calcula-

trice. Par exemple, pour calculer 4

2sur Casio, on tape OPTN puis PROB puis 4 puis

nCr puis 2. On trouve 4

2= 6

Exercice : Un Q.C.M comporte 4 questions offrant chacune 3 réponses possibles (une

seule étant juste). On répond complètement au hasard. Quelles sont les probabilités :

1. d’obtenir 2 réponses exactes ?

2. d’obtenir la moyenne ?

2

1

/

2

100%