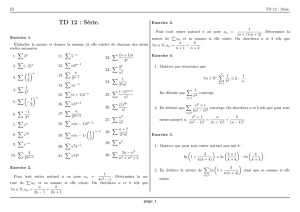

PC 7 TCL, Méthode de Monte-Carlo

X1, X2, . . . ΦX(t) = E[eitX ]N≥1

gN(z) = E[zN]N

XkE[X1]<∞E[N]<∞

S=X1+··· +XN,

SE[S]E[X1],E[N]

N(0,1)

12 [0,1] 6

20000 U1+··· +U12 −6N(0,1)

p

n Fn

Fn

In95 p

limnP(In3p)≥0.95

Z∼ N(0,1) P(−1.96 ≤Z≤1.96) = 0.95

P|Binom(n, p)−np|> r≤2 exp −2r2

n.

Jn95 p

nP(Jn3p)≥0.95

(Xn)n≥1E[X1]=0 E[X2

1]<+∞

lim

n→+∞

P(X1+··· +Xn≥0) = 1/2.

g

0≤g≤1m=

R1

0g(x)dx

X Y [0,1]

U=1Y≤g(X), V =g(X)W=g(X) + g(1 −X)

2.

U, V W

m

gE(g(X)g(1 −X)) ≤m2

(g(x)−g(y))(g(1 −x)−g(1 −y)) ≤0

x, y

(Xi)i≥1[0,1]

An=1

2n

2n

X

i=1

g(Xi), Bn=1

2n

n

X

i=1

(g(Xi) + g(1 −Xi)),

m

(Xi)i≥10

Pn

i=1 Xi

pPn

i=1 X2

i

?

?

(Xn)nσ2>0

Zn=1

σ√n

n

X

j=1

Xj.

(Zn)

Z2n−Zn

(Z2n−Zn)n≥1

(Zn)X

1

/

2

100%