test - WordPress.com

1

-10 -

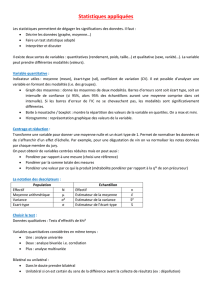

Tests d’hypothèses

Version 1.2

Sujets abordés

Tests d’hypothèses

Paramétriques

Non-paramétriques

Illustration sur Excel

Calculs de valeurs critiques

Calculs de tests

2

3

Introduction

Un test d’hypothèse est une démarche consistant à

rejeter ou ne par rejeter (accepter) une hypothèse en

fonction d’un jeu de données

Les hypothèses souvent testées concernent les

caractéristiques statistiques d’une population :

La moyenne

La variance

La comparaison de la moyenne de 2(+) jeux de données

La comparaison de la variance de 2(+) jeux de données

La forme de la distribution

…

Chaque catégorie d’hypothèse fera appel à un type de

test particulier

4

Introduction

Nous pouvons classer les tests d’hypothèses en 2

grandes catégories :

Les tests paramétriques :

Une hypothèse est dite paramétrique s’il s’agit d’un

énoncé quantitatif concernant un paramètre de la ou des

populations (moyenne ou écart-type)

Les tests non-paramétriques :

Lorsque l’énoncé concerne la forme de la distribution

alors il s’agit d’une hypothèse non paramétrique

5

Étapes d’un test d’hypothèse

1. Poser une hypothèse

2. Identifier le test statistique et la distribution de probabilité

adéquats

3. Spécifier le seuil de signification du test

4. Énoncer une règle de décision

5. Récupérer des données (échantillon), calculer le test

statistique et prendre la décision

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

1

/

40

100%