Variables aléatoires. Lois et moments. I Variables aléatoires II Lois

Variables aléatoires. Lois et moments.

I Variables aléatoires

Confrontés à une expérience aléatoire, on est souvent amené à préférer observer les résultats non directement

mais à travers un effet produit. Par exemple, si l’expérience est constituée par la météo, on peut concevoir la

température Tcomme résultant de l’expérience, au sens où Tpeut être vu comme l’action de la météo sur le

thermomètre. C’est là la notion de variable aléatoire.

Soit (Ω, P )un espace de probabilités. Soit Eun ensemble.

Définition 1 On appelle variable aléatoire à valeurs dans Eune application X: Ω →E.

Dans cette définition, Epeut être un ensemble quelconque, fini ou infini. Dans le cas où Eest une partie

de l’ensemble des nombres réels IR, on parle de variable aléatoire réelle. On utilisera systématiquement les

abréviations v.a. pour variable aléatoire et v.a.r. pour variable aléatoire réelle.

Quand on a une variable aléatoire, on s’intéresse à des événements indiquant que la v.a. prend certaines

valeurs. D’où la notation

Notation 1 Pour C⊂E, on note (X∈C)l’événement

(X∈C) = {ω∈Ω, X(ω)∈C}.

Dans le cas particulier où A={x}, on écrira (X=x)au lieu de (X∈ {x}).

Un exemple important de variable aléatoire sont les indicatrices : si A⊂Ωest un événement, on définit la

v.a.r. 1IApar

1IA=1 si ω∈A

0 sinon

On a la définition suivante concernant l’influence réciproque de variables aléatoires.

Définition 2 Soient X1, . . . , Xnnvariables aléatoires à valeurs dans E. On dit que X1, . . . , Xnsont indé-

pendantes si et seulement si pour tous C1, . . . , Cninclus dans E, les événements

(X1∈C1),...,(Xn∈Cn)

sont indépendants.

II Lois

A l’aide de la variable aléatoire X, on “transporte” le hasard sur l’espace Een transformant cet ensemble en

un espace de probabilités grâce à la définition suivante.

Théorème et Définition 1 Soit Xune variable aléatoire à valeurs dans Esur un espace de probabilités

(Ω, P ). Pour C⊂E, on pose

µX(C) = P(X∈C).

µXdéfinit une probabilité sur Eappelée la loi de la v.a. X.

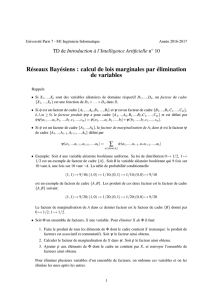

Cas particulier important : on suppose ici que Eest un ensemble fini E={x1, . . . , xn}.

La loi µXest alors entièrement définie par la donnée des nombres µX({xi}) = P(X=xi). On la présente

en général sous forme d’un tableau

x x1x2. . . xnΣ

P(X=x)P(X=x1)P(X=x2). . . P (X=xn) 1

1

III Moments

On suppose jusqu’à la fin de ce chapitre que Ωest un ensemble fini. Cette restriction sera levée progressive-

ment dans la suite du cours. On suppose en outre que Xest une variable aléatoire réelle.

Définition 3 On appelle espérance de X(ou moment d’ordre 1) la quantité

E(X) = X

ω∈Ω

X(ω)P({ω})

Propriété 1 Soient Xet Ydeux variables aléatoires réelles et λ∈IR. On a

(i) E(X+Y) = E(X) + E(Y)

(ii) E(λX) = λE(X)

(iii) Si Xest à valeurs dans IR+, E(X)≥0

(iv) Si Xest une variable aléatoire constante égale à α,E(X) = α.

On a

Proposition 1 Si Xest une v.a.r. à valeurs dans {x1, . . . , xn}, on a

E(X) =

n

X

i=1

xiµ({xi}).

Plus généralement,

Proposition 2 Si Xest une v.a.r. à valeurs dans {x1, . . . , xn}, et fune fonction de IR dans IR, on a

E(f(X)) =

n

X

i=1

f(xi)µ({xi}).

Définition 4 Soit Xune v.a.r.

(i) Soit n∈IN. Le moment d’ordre nde Xest E(Xn).

(ii) On appelle variance de Xle réel

Var(X) = E((X−E(X))2) = E(X2)−E(X)2

Proposition 3 Si Xet Ysont deux variables aléatoires indépendantes,

(i) E(XY ) = E(X)E(Y)

(ii) Var(X+Y) = Var(X) + Var(Y)

IV Inégalités

Proposition 4 (Inégalité de Markov) Si Xest une v.a.r. à valeurs positives, si α > 0, on a

P(X > α)≤1

αE(X)

Proposition 5 (Inégalité de Bienaymé-Tchebitcheff) Si Xest une v.a.r., et si ε > 0, on a

P(|X−E(X)|> ε)≤1

ε2Var(X).

2

1

/

2

100%