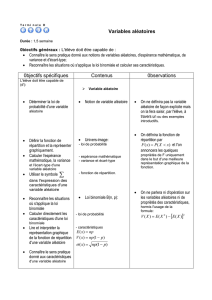

Chapitre 22 : Variables aléatoires réelles discrètes.

ECS3 Carnot Chapitre 22 — Variables aléatoires réelles discrètes 2013/2014

Chapitre 22 : Variables aléatoires réelles

discrètes.

1 Variables aléatoires réelles

1.1 Définitions

Définition 1.1.1

Soit (Ω,A)un espace probabilisable et X: Ω →une application. Alors on dit que X

est une variable aléatoires réelle lorsque

∀x∈,[X6x] = {ω∈Ω, X(ω)6x} ∈ A}

Remarque. On note comme on l’a déjà fait [X∈I]pour {ω∈Ω, X(ω)∈I}.

Proposition 1.1.1

Soit X: (Ω,A)→une variable aléatoire réelle. Alors pour tout intervalle I(de la

forme [a, b],[a, b[,]a, b],]a, b[,[a, +∞[,]a, +∞[,]− ∞, b],]− ∞, b[) on a [X∈I]∈ A.

Autrement dit toutes les parties du type [X∈I]sont des événements.

Démonstration : Il suffit de monter que toute partie du type [X∈I]peut se décrire à l’aide de

[X6x]. Par exemple on a déjà vu que [X∈]a, b]] = [a < X 6b] = [X6b]∩[X6a]∈ A...

Remarque. En particulier [X=x] = [X6x]∩[X < x]∈ A.

En général, les énoncés demandent d’admettre qu’une application Xest bien une va-

riable aléatoire, mais il faut savoir le vérifier si besoin.

Exemple. On lance un dé, et on ne s’intéresse qu’à la parité du résultat. On note X= +1

si le résultat est pair, −1si il est impair. Alors en choisissant par exemple la tribu A=

{∅,{2,4,6},{1,3,5},Ω},Xest une variable aléatoire réelle : exercice !

Par contre si Yest le numéro de la face obtenue, Yn’est pas une variable aléatoire sur

(Ω,A)mais l’est sur (Ω,P(Ω)).

Remarque. Pour les variables aléatoires finies nous n’avions pas donné de condition car

on prenait jusqu’à présent systématiquement A=P(Ω).

Remarque. Si X(Ω) est fini, on le note {x1,...,xn}avec x1< x2··· < xnet on a pour

tout x∈l’existence d’un unique k∈[[ 1 ; n−1 ]] tel que x∈[xk, xk+1[. On a alors

[X6x] = Sk

i=1[X=xi].

De nombreux exemples de manipulation d’événements associés à un variable aléatoire

ont déjà été vus : Révisions !

J. Gärtner. 1

ECS3 Carnot Chapitre 22 — Variables aléatoires réelles discrètes 2013/2014

1.2 Fonction de répartition et loi

Définition 1.2.1

Soit (Ω,A, P )un espace probabilisé et Xune variable aléatoire réelle. L’application

FX:−→

x7−→ P(X6x)

est appelée Fonction de répartition de X.

Remarque. On va avoir besoin dans cette section de décrire les évènements [X6x]et

[X < x]par

[X6x] = \

∗

[X6x+1

n] [X < x] = [

∗

[X6x−1

n]

Théorème 1.2.1

La fonction de répartition FXd’une variable aléatoire réelle Xest

1. Croissante sur .

2. ∀x∈,06FX(x)61et lim

x→−∞ FX(x) = 0,lim

x→+∞FX(x) = 1.

3. FXest continue à droite : ∀x∈,lim

t→x

t>x

FX(t) = FX(x).

4. ∀x∈,lim

t→x

t<x

FX(t) = FX(x)−P(X=x) = P(X < x)

5. FXest continue en xsi et seulement si P(X=x) = 0.

La preuve de ce théorème est intéressante pour commencer à comprendre comment

manipuler les variables aléatoires.

Démonstration : 1. Soient x, y ∈tels que x6y. On a ]− ∞, x]⊂]− ∞, y]donc

(X6x)⊂(X6y)et P(X6x)6P(X6y). C’est donc que FX(x)6FX(y)et FX

est croissante.

2. FXest croissante et minorée par 0 donc a une limite en −∞. Par caractérisation

séquentielle, on a lim

−∞ FX= lim FX(−n). La suite (X6−n)est une suite décrois-

sante d’évènements. D’après le théorème de la limite monotone, lim P(X6−n) =

P(Tn(X6−n)). Mais Tn(X6−n) = ∅. Donc lim P(X6−n) = 0.

La fonction FXest croissante et majorée par 1. Elle a une limite en +∞, qui est égale

àlim FX(n). La suite (X6n)est une suite croissante d’évènements. On conclut donc

de même par le théorème de la limite monotone.

3. Soit x∈. Puisque FXest croissante, elle admet une limite à droite en xet par

caractérisation séquentielle, lim

x+FX= lim FX(x+1

n). La suite d’évènements (X6

x+1

n)est décroissante, d’intersection X6x. On applique alors le théorème de la

limite monotone pour montrer que lim FX(x+1

n) = FX(x).

4. Soit x∈. Alors si t < x on a (X6t)⊂(X < x). Donc F(t)6FX(x)−P(X=x).

Puisque FXest croissante, elle admet une limite à gauche en xet lim

x−

FX= lim FX(x−

1

n). La suite (X6x−1

n)est croissante et le théorème de la limite monotone donne

lim P(X6x−1

n) = P(

+∞

[

n=1

(X6x−1

n))

J. Gärtner. 2

ECS3 Carnot Chapitre 22 — Variables aléatoires réelles discrètes 2013/2014

Ainsi lim

x−FX=P(X < x)car S+∞

n=1(X6x−1

n) = (X < x). Comme P(X < x) =

P(X6x)−P(X=x)on peut conclure pour la fin de ce point, et pour le suivant.

Définition 1.2.2

Soit (Ω,A, P )un espace probabilisé et X: Ω →une variable aléatoire réelle. On

appelle loi de Xla donnée de toutes les probabilités P(X∈A)pour tout Adans la

tribu borélienne (engendrée par les intervalles ouverts) de .

Théorème 1.2.2 (La fonction de répartition caractérise la Loi)

Si Xet Ysont deux variables aléatoires réelles de même fonction de répartition, alors

Xet Yont même loi de probabilité, i.e. X ֒→Y.

Démonstration : Ce résultat est admis.

Proposition 1.2.1

Si a < b on a P(a < x 6b) = FX(b)−FX(a).

Démonstration : En effet, (a < X 6b) = (X6B)r(X6a)et (X6a)⊂(X6b).

2 Variables aléatoires réelles discrètes

2.1 Définitions

Définition 2.1.1

Soit (Ω,A)est un espace probabilisable. On appelle variable aléatoire réelle sur

(Ω,A)toute application

X:Ω−→

ω7−→ X(ω)

telle que, pour tout x∈, on ait

(X6x)∈ A

Lorsque l’image X(Ω) est au plus dénombrable, on dit que la variable aléatoire X

est une variable aléatoire réelle discrète.

Remarque. Pour vérifier qu’une fonction Ω→ {xi, i ∈I}est une variable aléatoire

discrète, il suffit de vérifier que pour tout i,(X=xi)est un évènement. Toutes les autres

caractérisations que l’on a déjà vu restent valables.

Remarque. Lorsque Xest une variable aléatoire réelle discrète, on a X(Ω) au plus dé-

nombrable. On peut donc numéroter ses éléments, et on note souvent X(Ω) = {xi, i ∈I}

avec xi < xjsi i < j et Iest une partie (infinie ou non) de ou de .

Remarque. On peut être amené dans les exercices à considérer des variables aléatoires

discrètes à valeurs dans 1. Ce sont des fonctions X: Ω →, telles que X(Ω) = {xi, i ∈I}

est au plus dénombrable et tel que pour tout i∈I,(X=xi)∈ A. On ne manipulera de

telles variables aléatoires que si elles sont presque-sûrement à valeurs réelles : P(X∈) = 1.

1. Rappelons que cette notation est à la limite du programme

J. Gärtner. 3

ECS3 Carnot Chapitre 22 — Variables aléatoires réelles discrètes 2013/2014

C’est une question de convention, mais il faudra toujours s’assurer que les évènements

(X= +∞)et (X=−∞)sont quasi-impossibles.

Exemple. On considère une urne composée de boules rouges et de boules blanches. On

tire avec remise une boule jusqu’à l’obtention d’une boule rouge. Soit Xl’application de

Ωdans ∪ {+∞} qui donne le nombre de tirages effectués, avec la convention X= +∞

si on ne tire jamais de boule rouge. On a vu en exercice que P(X= +∞) = 0 donc que X

est presque-sûrement à valeurs réelles.

En général, on n’a pas trop besoin de cette notation [X= +∞], il suffit de donner une

valeur arbitraire, par exemple X=−1si on ne tire jamais de boule rouge. Peu importe la

valeur précise puisque c’est un événement négligeable !

Exemple. On effectue une succession de lancers d’un dé équilibré jusqu’à ce qu’on obtienne

6. Soit Xle nombre de lancers effectués. A priori Xest à valeurs dans ∪ {+∞} mais

vu qu’on effectue presque-sûrement un nombre fini de lancers P(X= +∞) = 0 et on peut

considérer que X(Ω) = ∗.

2.2 Tribu engendrée par X

Proposition 2.2.1

Soit (Ω,A)un espace probabilisable. Pour toute variable aléatoire réelle discrète Xsur

(Ω,A), l’ensemble

{(X=x), x ∈X(Ω)}

est un système complet d’évènements. On l’appelle le système complet d’évène-

ments associés à X.

Démonstration : On sait que (X=x)∈ A par définition d’une variable aléatoire réelle. Si

x6=y∈X(Ω), il est clair que (X=x)∩(X=y) = ∅: les évènements (X=x)et

(X=y)sont incompatibles. De plus Sx∈X(Ω)(X=x) = (X∈X(Ω)) = Ω. Ce qui montre

le résultat attendu.

Définition 2.2.1

Soit (Ω,A)un espace probabilisable. Pour toute variable aléatoire réelle discrète Xsur

(Ω,A), on appelle tribu engendrée par X, et on note AXla tribu engendrée par le

système complet d’évènements associé à X.

Remarque. Autrement dit AXest l’unique tribu incluse dans Atelle que Xsoit une

variable aléatoire réelle discrète sur (Ω,AX)et pour toute sous tribu A′de Atelle que X

est une variable aléatoire sur (Ω,A′)contient AX.

Remarque. On a vu au chapitre précédent que la notion de tribu était liée à celle d’in-

formation. Les événements de la tribu AXsont exactement ceux que l’on peut connaître

par X. La donnée de Xne peut pas donner d’information sur la réalisation d’événements

qui ne sont pas dans AX.

Proposition 2.2.2

La tribu engendrée par Xest aussi

AX={(X∈A), A ⊂X(Ω)}

J. Gärtner. 4

ECS3 Carnot Chapitre 22 — Variables aléatoires réelles discrètes 2013/2014

Démonstration : En effet si (Ei)est un système complet d’évènements, la tribu engendrée

par les Eiest {Sk∈KEk, K ⊂I}.

Exemple. Une urne contient une infinité de boules numérotées. On tire simultanément

deux boules de l’urne. L’univers Ω = {(i, j),16i < j}est muni de la tribu discrète. Soit

Xla variable aléatoire réelle discrète égale à la somme des numéros tirés. On a X(Ω) =

{3,...,n,...,}et (X=k)k>3est un système complet d’évènements. La tribu engendrée

par Xest alors {(X∈I, I ⊂ {3,...,n,...,}}.

Proposition 2.2.3

Si Xest une variable aléatoire réelle discrète sur (Ω,A), alors pour toute fonction

g:X(Ω) →on a

Ag(X)⊂ AX

Démonstration : En effet, il suffit de monter que g(X)est une variable aléatoire sur (Ω,AX)

et d’utiliser la remarque qui suit la définition de tribu engendrée par une variable aléatoire.

On sait que g(X)est une variable aléatoire sur (Ω,A)réelle discrète. Notons g(X)(Ω) =

{yi, i ∈I}où Iest une partie de . On a (g(X) = yi) = Sx∈g−1(yi)(X=x). Par

définition tous les (X=x)sont des évènements de AX. En utilisant la stabilité par réunion

dénombrable, on a (g(X) = yi)∈ AX, ce qui permet de conclure.

Exemple. Revenons un moment sur la notion d’information de la tribu. On joue à Pile

ou Face. On touche 1 euro si on tombe sur Pile et on perd un euro sur Face. Soit Xle

gain algébrique et Y=X2. Alors AX={∅,[X= 1],[X=−1],Ω}autrement dit la

connaissance de Xnous permet (suivant que [X= 1] est réalisé ou non) de connaître le

résultat du lancer. La connaissance de Ypar contre ne nous donne rien d’interessant et

pour cause Yest la variable aléatoire certaine égale à 1, on a donc AY={∅,Ω}ce qui

n’est pas une information très intéressante...

2.3 Lois de probabilité d’une variable aléatoire

Soit (Ω,A, P )un espace probabilisé et Xune variables aléatoire réelle discrète sur

(Ω,A). On a construit une algèbre a priori plus petite AXassociée à X. La restriction

de PàAXest une probabilité. Celle-ci est entièrement déterminée par la donnée des

P(X=x), x ∈X(Ω). En effet, l’ensemble {(X=x), x ∈X(Ω)}est un système complet

d’évènements qui engendre AXet une probabilité est entièrement définie si elle est donnée

sur un système complet d’évènements par additivité dénombrable.

Définition 2.3.1

Soit (Ω,A, P )un espace probabilisé et Xune variables aléatoire réelle discrète sur

(Ω,A).

La donnée de la loi de probabilité est équivalente à la donnée de l’ensemble X(Ω)

et de

{P(X=x), x ∈X(Ω)}

Théorème 2.3.1

Si Xest une variable aléatoire réelle discrète et g:X(Ω) →. La loi de Y=g(X)est

donnée par

P(Y=y) = X

x∈g−1({y})

P(X=x)

J. Gärtner. 5

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

1

/

16

100%