Table des matières 1. Éléments propres, caractéristiques 1 2

Table des matières

1. Éléments propres, caractéristiques 1

2. Diagonalisation 4

3. Co-diagonalisation 6

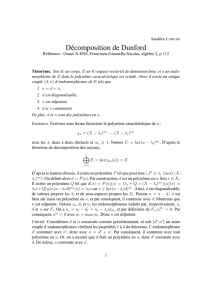

4. Décomposition de Dunford 7

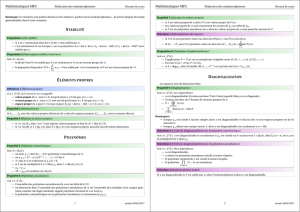

1. Éléments propres, caractéristiques

Soient f∈ L(E)et λ∈K. On dit que λest une valeur propre de fsi f−λIdEn’est

pas inversible. De manière équivalente, λest une valeur propre pour fsi ker(f−λIdE)6=

0, c’est-à-dire, il existe x∈Etel que f(x) = λx.

On appelle x∈Eun vecteur propre pour fsi x6= 0 et il existe λ∈Ktel que

f(x) = λx. Bien que xsoit supposé non nul, la valeur propre λcorrespondante peut

être zéro.

Étant donnés f∈ L(E)et une valeur propre λde f, on appelle sous-espace propre

associé à λ, noté Eλ, le sous-espace ker(f−λId). Donc Eλest constitué de tous les

vecteurs propres de valeurs propre λainsi que le vecteur nul. On appelle multiplicité

géométrique, notée mg(λ), la dimension de Eλ.

Proposition 1.1. Soit f∈ L(E). Toute famille finie de vecteurs propres associés à

des valeurs propres pour fdeux à deux distincts est libre. En particulier, si Eest de

dimension finie, alors il existe au plus dim Evaleurs propres deux à deux distinctes.

Proof. La preuve est par récurrence sur le nombre de vecteurs dans la famille. S’il y a

un seul vecteur dans la famille, alors c’est une famille libre car un vecteur propre est

par définition non nul.

Maintenant supposons le résultat vrai pour toute famille finie à Néléments. Soit

{x1, . . . , xN+1}une famille vérifiant les hypothèses de la proposition. Désigons par λila

valeur propre associée à xi. Supposons qu’on ait une relation α1x1+· · ·+αN+1xN+1 = 0E.

On lui applique fpour trouver λ1α1x1+· · · +λN+1αN+1xN+1 = 0E. En multipliant la

première relation par λN+1 et en lui soustrayant la seconde relation, on obtient

(λN+1 −λ1)α1x1+· · · + (λN+1 −λN)αNxN= 0E.

Par l’hypothèse de récurrence on a (λN+1 −λi)αi= 0 pour tout i= 1, . . . , n. Mais les

λisont deux à deux distincts par hypothèse, donc αi= 0 pour tout i= 1, . . . , N. Inséré

dans la première relation, cela implique αN+1 = 0 puisque xN+1 6= 0E.

Le dernier énoncé suit de façon triviale du premier, car le nombre de membres d’une

famille libre de vecteurs ne peut pas excéder la dimension.

Exemple 1.1.1. Soit E=C∞(R)et f∈ L(E)donné par la dérivation. Alors si les

scalaires λ1, . . . , λn∈Ksont deux à deux distincts, alors les vecteurs eλ1t, . . . , eλnt

forment une famille libre dans E.

Exemple 1.1.2. On a déjà montré, à travers des critères de cyclicité (polynôme mini-

mal, commutant) que si un f∈ L(E)admet dim Evaleurs propres distinctes alors f

est cyclique. Donnons maintenant une autre preuve, qui repose sur la proposition 1.1.

1

2

Pour motiver le raisonnemment, on se rappelle qu’un générateur du produit direct

Z/p1Z×· · ·×Z/pnZ, où les pisont des nombres premiers deux à deux distincts, est donné

par le produit des générateurs des facteurs. Dans notre context, si x0, . . . , xn−1sont les

vecteurs propres associés aux nvaleurs propres distinctes on pose x=x0+· · · +xn−1.

Montrons que les vecteurs x, f(x), . . . , fn−1(x)forment une base de E.

Supposons que Pakfk(x) = 0Eet montrons que les aksont tous nuls. Or on calcule

fk(x) = λk

0x0+λk

1x1+· · · +λk

n−1xn−1.

Ainsi la relation ci-dessus devient

n−1

X

k=0

ak(λk

0x0+λk

1x1+· · · +λk

n−1xn−1) =

n−1

X

j=0 n−1

X

k=0

akλk

j!xj= 0E.

Or les xiforment une base de E(car associés à des valeurs propres distinctes – voir

la proposition 1.1). On en déduit que Pakλk

j= 0 pour tout j. Mais cela équivaut à

l’équation

V(λ0, . . . , λn−1)

a1

a2

.

.

.

an

=

0

0

.

.

.

0

,

où à gauche apparaît la matrice de Vandermonde. Comme det V(λ0, . . . , λn−1)est égal

àQi<j (λi−λj), on en déduit de l’hypothèse que les valeurs propres sont distinctes que

les aisont tous 0.

Proposition 1.2. Soit f∈ L(E). Soient λ1, . . . , λndes valeurs propres de f, supposées

deux à deux distinctes. Alors les Eλisont en somme directe.

Proof. Soit x∈Eλ1+· · · +Eλnet supposons que

x1+· · · +xn=x=y1+· · · +yn,

avec xi, yi∈Eλi. Alors (x1−y1) + · · · + (xn−yn)=0Eavec xi−yi∈Eλi. Or les

différences xi−yidoivent toutes être 0E, car sinon celles qui sont non zéro seraient

liées, en contradiction à la proposition 1.1.

Proposition 1.3. Soient f∈ L(E)et λune valeur propre de f. Alors λest racine de

toute polynôme annulateur de f. En particulier, les valeurs propres sont exactement les

racines du polynôme minimal.

Proof. Si xest un vecteur propre associé à λ, alors P(f)x=P(λ)x. En effet, par

linéarité il suffit de vérifier cette relation pour des monômes, ce qui peut se faire par un

argument de récurrence. Ainsi, puisque P(f)annule fon a P(λ)x= 0E, d’où P(λ) = 0

car x6= 0E.

Pour voir comment le deuxième énoncé s’en déduit du premier, supposons que α∈K

est racine de µfsans être une valeur propre. Alors µf(x)=(x−α)Q(x), pour un

polynôme Q∈K[x]de degré strictement inférieur à celui de µf. Ainsi 0L(E)=µf(f) =

(f−αId) ◦Q(f). Comme αn’est pas valeur propre de f, l’endomorphisme f−αId est

inversible. Ainsi Qest annulateur de f, ce qui contredit la minimalité de f.

Soient f∈ L(E)et λ∈Kune valeur propre de f. On appelle multiplicité minimale

de λ, notée mm(λ), la multiplicité de λen tant que racine de µf.

3

1.4. Racines du polynôme caractéristique.

Proposition 1.5. Soit f∈ L(E)où Eest de dimension finie. Alors les valeurs propres

de fsont précisément les racines de χf. En particulier, si K=C, alors fadmet au

moins une valeur propre.

Proof. Le scalaire λ∈Kest valeur propre de fsi, et seulement si, f−λIdEn’est pas

inversible, c’est-à-dire χf(λ) = det(f−λIdE) = 0.

Maintenant prenons K=C. On peut supposer que dim E≥1. Alors le théorème

d’Alembert-Gauss dit que χf(x), puisque ce n’est pas un polynôme constant, admet au

moins une racine. Par la première partie de la proposition, ceci implique que fadmet

au moins une valeur propre.

1.6. Sous-espaces caractéristiques. Soit f∈ L(E), où Eest de dimension finie. Soit

λ∈Kune valeur propre de f. Alors la multiplicité de λen tant que racine de polynôme

caractéristique χfde fest appelée multiplicité algébrique. On la note ma(λ). On

appelle espace caractéristique l’espace ker(f−λId)ma(λ). Noter bien l’égalité

ker(f−λId)ma(λ)= ker(f−λId)mm(λ).

L’espace caractéristique est un sous-espace stable de f. En effet l’endomorphisme

(f−λId)ma(λ)est un polynôme en fet donc commute avec f. Ainsi son noyau est

stable par f.

Par ailleurs, si f∈ L(E)est tel que χfest scindé, une application du lemme des

noyaux montre que Ese décompose en somme directe des sous-espaces caractéristiques.

1.7. Multiplicités. Soit λune valeur propre de f∈ L(E). Regardons maintenant les

relations entre les trois multiplicités mg(λ), mm(λ), ma(λ).

Il est clair qu’on a

1≤mm(λ)≤ma(λ).

En effet, par le théorème de Cayley-Hamilton, puisque µf|χf, la multiplicité de λen

tant que racine de µfest inférieure ou égale à sa multiplicité en tant que racine de χf.

Proposition 1.8. Soient f∈ L(E)et λune valeur propre de f. Alors

ma(λ) = dim ker(f−λId)ma(λ).

In particular 1≤mg(λ)≤ma(λ).

Proof. Posons gl’endomorphisme induit de fsur le sous-espace caractéristique G=

ker(f−λId)ma(λ). Alors g−λId est un endomorphisme nilpotent. Ainsi, il existe une

base dans laquelle la matrice de g−λId est triangulaire supérieure stricte. Dans cette

même base la matrice de gest donc triangulaire supérieure avec λcomme coefficient

sur chaque diagonal. Ainsi le polynôme caractéristique de gest χg(T)=(T−λ)dim G,

ce qui montre que dim G=ma(λ).

L’inégalité mg(λ)≤ma(λ)découle de l’inclusion ker(f−λId) ⊂ker(f−λId)ma(λ)

(car ma(λ)≥1par définition), et la première partie de la proposition.

Exemple 1.8.1. Soit f∈ L(E), où Eest de dimension finie. Soit λune valeur propre

de f. On a maintenant trois notions de multiplicité de λ: géométrique, minimale, et

algébrique. Comparons ces multiplicités dans le cas des endomorphismes nilpotents.

Noter que la seule valeur propre d’un endomorphisme nilpotent est 0.

4

Soit f∈ L(E)nilpotent d’indice pet posons n= dim E < ∞. Alors

p=mm(0), n =ma(0),et dim ker f=mg(0).

Rappelons-nous que l’hypothèse p= dim Eimplique dim ker fk=kpour k= 0, . . . , p.

En particulier mm(0) = ma(0) implique mg(0) = 1.

Par exemple,

•pour diag(J1, J1, J2)∈M4(K)on a mm(0) = 2,ma(0) = 4, et mg(0) = 3;

•pour diag(J1, J3, J4, J5)∈M13(K)on a mm(0) = 5,ma(0) = 13, et mg(0) = 4.

2. Diagonalisation

Soit f∈ L(E), où Eest de dimension finie. On dit que fest diagonalisable si l’une

des conditions suivantes équivalentes est vérifiée

(1) il existe une base de Edans laquelle la matrice de fest diagonale;

(2) il existe une base de Econstituée de vecteurs propres de f;

(3) Eest somme directe des sous-espaces propres de f.

On dit qu’une matrice M∈Mn(K)est diagonalisable si elle est semblable à une

matrice diagonale, c’est-à-dire, il existe P∈GLn(K)telle que P MP −1est diagonale.

Ces définitions sont compatibles: un fest diagonalisable si, et seulement si, toute

matrice qu’on peut associer à fen choisissant une base de Eest diagonalisable.

Si M∈Mn(K)est diagonalisable, avec P MP −1une matrice diagonale D, les valeurs

propres de Msont les coefficients diagonaux de D.

Proposition 2.1. Soit f∈ L(E)avec dim E=n. Si fadmet nvaleur propres deux

à deux distinctes, alors fest diagonalisable. De façon équivalente, si χfest scindé de

racines simples, alors fest diagonalisable.

Proof. Par la proposition 1.1, les vecteurs propres associés à des valeurs propres deux

à deux distinctes sont en famille libre. Comme il y a n= dim Eéléments dans cette

famille libre, c’est une base.

Que l’hypothèse que χfsoit scindé de racines simples est équivalente à l’hypothèse

que fadmette n= dim Evaleur propres deux à deux distinctes est clair, car les racines

des χfsont précisément les valeurs propres et deg χf=n.

Par exemple, une matrice triangulaire supérieure telle que les coefficients le long du

diagonal sont deux à deux distincts est diagonalisable. En effet, les coefficients le long

du diagonal sont précisément les valeurs propres.

La réciproque de la proposition ci-dessus n’est pas vrai: il suffit de penser à des

homothéties en dimension ≥2.

2.2. Critère de diagonalisibilité avec µf.

Théorème 2.1. Soit f∈ L(E), où Eest de dimension finie. Alors fest diagonali-

sable si, et seulement si, µfest scindé à racines simples. De façon équivalent, fest

diagonalisable si, et seulement si, fadmet un polynôme annulateur scindé à racines

simples.

5

Proof. Pour voir l’équivalence entre les deux énoncés, supposons que fadmet un po-

lynôme annulateur scindé Pà racines simples, comme µf|P, on en déduit que µfest

scindé à racines simples. (L’autre direction est évidente).

Alors, supposons que fest diagonalisable. Ainsi fadmet une base x1, . . . , xnde

vecteurs propres; notons λ1, . . . , λnles valeurs propres associés. De ces valeurs propres

on en choisit une pour chaque répétition; on note λ1, . . . , λm, où m≤n, ces valeurs

propres deux à deux distinctes. On pose P(x) = Qm

i=1(x−λi); par construction, c’est

un polynôme scindé à racines simples. Montrons que Pest annulateur de f. Il suffit de

démontrer que P(f)(v) = 0Epour tout v∈ {x1, . . . , xn}. Si λest la valeur propre de

v, et Q(x) = Qλi6=λ(x−λi)on calcule

P(f)(v) = Q(f)((f−λId)(v)) = 0E,

ce qui montre une direction.

Maintenant supposons que fadmet un polynôme annulateur scindé Pà racines

simples. Écrivons P(x) = Qm

i=1(x−λi), où les λisont deux à deux distincts. Alors les

facteurs x−λisont premiers entre eux, et le lemme du noyau implique que

E= ker P(f) =

m

M

i=1

ker(f−λId).

Ainsi Eest somme directe d’espaces propres, et du coup fest diagonalisable.

Remarque 1. On en déduit que si fest diagonalisable et Fest un sous-espace stable,

alors l’endomorphisme sur Finduit par fest diagonalisable. En effet, µfF|µfet comme

le dernier est scindé à racines simples, le premier l’est aussi.

Exemple 2.2.1. Les symmétries vectorielles et projecteurs sont diagonalisables (de

polynôme annulateurs (x+ 1)(x−1) et x(x−1), respectivement).

Exemple 2.2.2. Si fest nilpotent et diagonalisable, alors fest nul. En effet, Xpest

le polynôme minimal, où pest l’indice de nilpotence. Pour que les racines de Xpsoit

simple, il faut que p= 1, c’est-à-dire f= 0L(E).

Exemple 2.2.3. Soit A∈Mn(R)telle que A5= Idn. Alors Aest diagonalisable sur C,

car les racines de x5−1sont deux à deux distinctes.

Qu’est-ce qui se passe sur R? Cherchons à décrire les Aci-dessus qui sont diagona-

lisables. On sait que µA|(x5−1), puisque ce dernier est annulateur de A. Mais (par

l’hypothèse que Asoit diagonalisable et la proposition ci-dessus) on sait également que

µAest scindé à racines simples. On en déduit que µA(x) = x−1. Ainsi A= Idn.

Exemple 2.2.4. Soit f∈ L(E), avec dim E=n. Supposons fde rang 1. Alors f

est diagonalisable si, et seulement si, sa trace est nulle. En effet, le noyau de fest

de dimension n−1, et ce noyau est l’espace propre E0de la valeur propre 0. Alors f

est diagonalisable précisément lorqu’il existe λtel que E=Eλ⊕E0. Un tel λserait

forcément différent de 0.

Exemple 2.2.5. Si une matrice triangulaire par blocs

M=A B

0nD

6

6

7

7

8

8

1

/

8

100%