II. Probabilités conditionnelles

Probabilités élémentaires :

)()()()( BAPBPAPBAP

si A et B compatible

)()()( BPAPBAP

si A et B incompatible (

BA

)

)(1)( APAP

Probabilités conditionnelles :

)( )(

)( AP ABP

A

B

P

)( )(

)( AP BP

A

B

P

si B inclus dans A

)()( AP

B

A

P

si A et B indépendants

Variables aléatoires :

Variables aléatoires discrète :

fonction de répartition

xx

j

j

pxXPXF )()(

fonction de répartition :

0)(lim

xF

x

1)(lim

xF

x

espérance

mathématique

n

i

iixpXE 1

)(

Variance

)²(²)()( XEXEXV

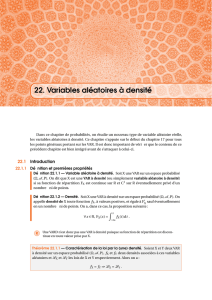

Variables aléatoires continue

fonction de répartition

)()()( aFbFbXaP

densité de probabilité

)(')( xFxf

b

a

dxxfaFbFbXaP )()()()(

espérance

mathématique

dxxxfXE )()(

Variance

²)())²(()( xdxxfxExXV

Opérations sur les variables aléatoires

espérance mathématique

bXEbXE )()(

)()( XaEaXE

)()()( YEXEYXE

v.a. indépendantes ou non

)()()( YEXEYXE

v.a. indépendantes

Variance

)var(

1

)var( 2

Xi

n

X

)var()var( XbX

)var(²)var( XaaX

),cov(2)var()var()var( YXYXYX

)var()var()var( YXYX

X et Y indépendants

Covariance

c YEXEXYEYEYXEXEYX )()()())]())(([(),cov(

coefficient de corrélation :

cYX

x²),cov(

)()( XaaX

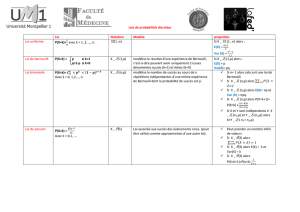

Lois usuelles

Loi de Bernoulli :

X= 1 et P(X=1)=p

0 et P(X=0)=1-p

Loi Binomiale :

knkk

nqpCkxP

)(

Loi Hypergéométrique :

n

N

kn kN

k

n

C

CC

kxP

)(

Loi de Poisson :

e

k

kxP k

!

)(

avec param. >0

Loi multinominale :

nk

k

nn

kk pppnNnNnNP ...),...,,( 2

2

1

1

12211

Lois continues :

Loi uniforme (sur l’intervalle [a,b]) :

Densité :

ab

xf

1

)(

Fonction de répartition

ab ax

xF

)(

Espérance

2

)( ba

xE

Variance

12)²(

)( ab

xV

Loi exponentielle :

Densité f(x)=0 si x<0

f(x)=

x

e

1

sinon

Fonction de répartition

x

exF

1)(

si x>0

Espérance

1

)( xE

Variance

²

1

)(

xV

Loi normale ( de paramètre (m,

) ):

2

2)²(

2

1

)(

mx

exf

mxE )(

2

)(

xV

Loi de X² :

Si on a n variables aléatoires indépendantes et

suivant la loi normale N(0,1).

n

ii

XX 1

2

I. Convergences

Convergence presque sure :

0

et

Aw

0))()((

wXwXP n

Convergence en probabilité :

0

1)(lim

XXP n

n

Convergence en loi :

)()(lim xFxFn

n

Loi des grands nombres :

Dans L1 :

)( nn XEX

Dans L2 :

XXn

Statistiques descriptives

Moyenne empirique :

n

ii

X

n

x1

1

Variation empirique :

n

iixx

n

S1

2

22 )(

1

Distribution empirique :

n

i

iCkkxn 1

)(!1

1!A (x) = 1 si x A

0 sinon

Quantiles :

Q(u) = inf {x , F(x) u } u ]0,1[

Estimation paramétrique

Convergence d’un estimateur Tn :

0)(lim

n

nTP

Erreur quadratique de Tn par rapport à

:

EQ[Tn,

] = E[(Tn-

)²]

Biais d’un estimateur :

B(Tn,

) = E[Tn-

]

E[(Tn-

)²] = Var(Tn) + B²(Tn,

)

Test d’hypothèses

Test de Fischer :

2

2

2

2

*

1

*

1

y

y

y

y

x

x

x

x

S

nn

S

nn

T

Test de student :

y

y

x

x

yx

n

S

n

S

YX

T2

2*

)()(

1

/

3

100%