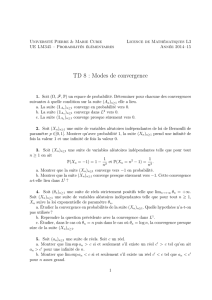

UNIVERSITÉ DE TOURS UFR SCIENCES ET TECHNIQUES

UNIVERSITÉ DE TOURS UFR SCIENCES ET TECHNIQUES

MASTER 1 DE MATHEMATIQUES cours de M. L. Gallardo

FORMULAIRE de PROBABILITÉS (1er semestre 2012-2013)

Avertissement : Ce formulaire est un résumé du cours dont il suit les étapes. Il contient

donc des redites dues aux exigences du tronc commun au Master MME (concerné seulement

par la première partie du cours) et aux Master MA et MIMATS.

I) Généralités du calcul des probabilités : Soit Ωun ensemble (univers des possibles)

Espace probabilisé (Ω,T,P):Test une tribu sur Ωc’est à dire T⊂P(Ω) vérifie

1)Ω∈T,2) (An)n∈N∗∈T⇒

+∞

[

n=1

An∈T,3) A∈T⇒Ac∈T,

et P:T→[0,1] (la probabilité) est telle que :

1)P(Ω) = 1 ,2)P∞

[

n=0

An=

+∞

X

n=0

P(An)pour tous (An)∈T, tels que Ai∩Aj=∅si i6=j.

Limite sup et Limite inf : Si (An)n∈N∗∈T, on note

1) lim inf An=

+∞

[

n=1 +∞

\

m=n

Am,2) lim sup An=

+∞

\

n=1 +∞

[

m=n

Am. On a alors :

1) lim inf An⊂lim sup An, 2) (lim inf An)c= lim sup Ac

n, 3) (lim sup An)c= lim inf Ac

n.

Continuité de P: Pour toute suite monotone (An)∈T, on a P(lim An) = lim

n→+∞

P(An)

(où lim An=SnAnsi An%et lim An=TnAnsi An&).

Probabilité conditionnelle : Si B∈T(avec P(B)>0) est un événement fixé, pour tout

A∈T, la quantité PB(A) = P(A|B) = P(A∩B)/P(B)est la probabilité conditionnelle de A

sachant B. L’application PB:T→[0,1] ainsi définie est la probabilité conditionnelle sachant

B.

Formule de l’intersection : Si A1, A2, . . . , Ak∈Tet P(A1∩A2∩. . . ∩Ak−1)>0,

P(A1∩A2∩. . . ∩Ak) = P(A1)P(A2|A1)P(A3|A1∩A2). . . P(Ak|A1∩. . . ∩Ak−1).

Formule de la probabilité totale : Soit (An)un système complet d’événements. Alors :

∀A∈T,P(A) = X

n

P(A|An)P(An).

Formule de Bayes : P(An|A) = P(A|An)P(An)

X

k

P(A|Ak)P(Ak)(A∈T) si (An)est un système complet.

Tribus indépendantes, événements indépendants : Les tribus Ti(1≤i≤n) sur Ωsont indé-

pendantes si ∀1≤i≤n, Ai∈Ti, implique P(A1∩. . .∩An) = P(A1). . . P(An). En particulier

des événements Ak(1≤k≤msont indépendants si les tribus TAkqu’ils engendrent sont

indépendantes (où TAk={∅,Ω, Ak, Ac

k}).

1

Espace probabilisé produit : Si (Ωi,Ti,Pi)(1≤i≤n) sont des espaces probabilisés, leur

espace produit est (Ω,T,P)où Ω = Ω1×···×Ωn,T=T1⊗···⊗Tnet P=P1⊗···⊗Pnoù T

est engendrée par les rectangles A1×···×An,Ai∈Ti, et Pest telle que P(A1×···×An) =

Qn

i=1 Pi(Ai).

II) Variables (resp. vecteurs) aléatoires discrètes (resp. discrets) : Ce sont les ap-

plications X: Ω →R(resp. X: Ω →Rd) telles que (resp. tel que) X(Ω) = {xk;k∈D}est

fini où dénombrable (D={1, . . . , N}ou D=N) et vérifiant la condition de mesurabilité :

∀k∈D,[X=xk]∈T. Dans la suite on écrit v.a. pour variable (resp. vecteur) aléatoire.

Distribution de probabilité : C’est la suite des nombres pk=P(X=xk)(k∈D). Ce sont

des nombres 0≤pk≤1tels que Pk∈Dpk= 1.

Moments : La v.a. Xa un moment d’ordre n(n∈N∗) si Pk∈Dpk|xk|n<+∞et le moment

d’ordre nest E(Xn) = Pk∈Dpkxn

k( c’est l’espérance si n= 1). Si Xa un moment d’ordre n

alors Xa des moments de tous les ordres k≤n. Si E(X2)existe, la variance est V ar(X) =

E((X−E(X))2) = E(X2)−(E(X))2et σX=pV ar(X)est l’écart type. Si (X, Y )est un

couple de v.a. ayant un moment d’ordre 2, la v.a. (X−E(X))(Y−E(Y)) a un moment

d’ordre 1 qui s’appelle la covariance de Xet Y.

Si Xa un moment d’ordre 2, alors pour tout a > 0,P(|X−E(X)

σX| ≥ a)≤1

a2(inégalité de

Bienaymé-Tchebychev).

Formule de l’espérance totale : Soit Xune v.a. discrète ayant un moment d’ordre 1 et (An)

un système complet d’événements. Alors :

E(X) = X

n

E(X|An)P(An),

où E(X|An) = Pk∈DxkPAn(X=xk)(PAnest la probabilité conditionnelle sachant An).

Transformée déterministe d’un v.a., formule du transfert : Si Xest un vecteur aléatoire dis-

cret de Rdet f:x7→ f(x)une fonction déterministe de Rddans R, la v.a. f(X) = f◦Xa

une espérance donnée par la formule

E(f(X)) = Pk∈Dpkf(xk)

(à condition , si D=N, que la série soit absolument convergente).

Variables aléatoires indépendantes : Les v.a. discrètes X1, . . . , Xksont dites (mutuellement)

indépendantes si

∀1≤i≤k,∀xi∈Xi(Ω) P(X1=xi, . . . , Xk=xk) = P(X1=x1). . . P(Xk=xk).

Si les v.a. discrètes X1, . . . , Xksont indépendantes et si elles ont un moment d’ordre 1 alors

la v.a. Qk

i=1 Xia un moment d’ordre 1 et E(Qk

i=1 Xi) = Qk

i=1 E(Xi).

Si les v.a. discrètes X1, . . . , Xksont indépendantes et si elles ont un moment d’ordre 2 alors

la v.a. S=Pk

i=1 Xia un moment d’ordre 2 et V ar(S) = Pk

i=1 V ar(Xi).

v.a. binomiale B(n, p): Toute v.a. Xtelle que X(Ω) = {0,1, . . . , n}et pour tout 0≤k≤n

P(X=k) = Ck

npk(1 −p)n−k,(où n≥1et p∈[0,1] sont fixés). Si n= 1, on dit que Xest

une v.a. de Bernoulli. On a E(X) = np et V ar(X) = np(1 −p).

v.a. de Poisson de paramètre λ > 0: Toute v.a. Xtelle que X(Ω) = Net P(X=k) = e−λλk

k!

(k∈N). On a E(X) = V ar(X) = λ.

2

v.a. de Pascal de paramètre p∈]0,1[ : Toute v.a. telle que X(Ω) = N∗et P(X=k) =

p(1 −p)k−1(kentier ≥1) (on l’appelle aussi v.a. géométrique, ou v.a. instant du premier

succès).

Loi faible des grands nombres : Si (Xk)est une suite de variables aléatoires indépendantes

de même loi ayant un moment d’ordre 2, alors ∀ > 0,P(|1

n(X1+···+Xn)−E(X1)|> )→0

si n→+∞.

III) Variables aléatoires ayant une densité de probabilité : Soit (Ω,T,P)un espace

probabilisé.

Vecteur aléatoire (v.a.) (ou variable aléatoire si d= 1) : C’est une application X: Ω,−→Rd

telle que pour tout pavé Ide Rd,[X∈I] = {ω∈Ω ; X(ω)∈I} ∈ T(condition de

mesurabilité).

Fonction de répartition d’une v.a. X : C’est la fonction F:R→Rtelle que : ∀t∈R, F (t) =

P(X≤t). Elle est telle que : 1) 0≤F(t)≤1 ; 2) Fest croissante (au sens large), continue

à droite en chaque t∈R; 3) lim

t→−∞ F(t)=0et lim

t→+∞F(t) = 1.

Densité d’un v.a. (resp. d’une v.a. lorsque d= 1) : Le v.a. Xde Rda une densité fsi f:

Rd→R+est intégrable avec RRdf(x1, . . . , xd)dx1. . . dxd= 1 et si ∀I(pavé de Rd),

P(X∈I) = RBf(x1, . . . , xd)dx1. . . dxd.

Densité normale N(0,1) : C’est la fonction f(x) = 1

√2πe−x2/2(x∈R).

Densité normale N(m, σ2): C’est la fonction f(x) = 1

σ√2πexp −1

2(x−m

σ)2(x∈R).

Densité uniforme sur [a, b]: C’est la fonction f(x) = 1

b−a1[a,b](x)(x∈R).

Densité exponentielle de paramètre λ > 0: C’est la fonction f(x) = λe−λx 1R+(x).

Densités marginales : Si (X, Y )est un couple de v.a. ayant une densité f(x, y)sur R2, les

densités marginales sont données par fX(x) = R∞

−∞ f(x, y)dy et fY(y) = R∞

−∞ f(x, y)dx.

v.a. indépendantes : Les v.a. X1, . . . , Xksont dites (mutuellement) indépendantes si

∀I1, . . . , Ik(intervalles de R)P(X1∈I1, . . . , Xk∈Ik) = P(X1∈I1). . . P(Xk∈Ik).

CNS d’indépendance : Soit X= (X1,··· , Xd)un vecteur aléatoire de Rdayant une densité

de probabilité f(x1,··· , xd). Les v.a. (Xk)sont indépendantes si et seulement si λd-p.p. on

af(x1,··· , xd) = fX1(x1)···fXd(xd)(produit des densités marginales).

Espérance, variance et moments : Une v.a. Xde densité fa un moment d’ordre 1 si

RR|x|f(x)dx < +∞. On pose alors E(X) = RRxf(x)dx et on l’appelle l’espérance ma-

thématique de X. La v.a. Xa un moment d’ordre n(∈N∗)si Xna un moment d’ordre 1, le

moment d’ordre nest alors le nombre E(Xn). De plus les formules donnant l’espérance du

produit et la variance de la somme de variables aléatoires indépendantes sont valables pour

les v.a. ayant une densité.

Théorème (ou Formule) du transfert : Soit Xun v.a. de Rdde densité probabilité fet soit

ϕ:Rd→Rune fonction mesurable. Alors ϕ(X) = ϕ◦Xa un moment d’ordre 1 ⇔

RRd|ϕ(x)|f(x)dx < +∞et on a E(ϕ◦X) = RRdϕ(x)f(x)dx.

3

Théorème de caractérisation d’une densité : Soit Xun vecteur aléatoire de Rdet f:Rd→

R+une fonction borélienne positive tels que pour toute fonction borélienne bornée ψ:Rd→

R, on ait E(ψ◦X) = RRdψ(x)f(x)dx, alors fest une densité de probabilité de X.

IV) Convergence en loi, théorème limite central, applications

Fonction caractéristique : La fonction ϕX(t) = E(eitX ) = E(cos(tX)) + iE(sin(tX)(t∈R)

est la fonction caractéristique de la v.a. X. Par exemple si Xest de loi N(0,1),ϕX(t) =

exp(−1

2t2), si Xest de loi binomiale B(n, p),ϕX(t) = (1 −p+peit)net si Xest de loi de

Poisson de paramètre λ > 0,ϕX(t) = exp(λ(eit −1)).

Propriétés des fonctions caractéristiques : 1) Si X1,...Xnsont des v.a. indépendantes et

S=Pn

i=1 Xi, on a ϕS(t) = Qn

i=1 ϕXi(t).

2) Si la v.a. Xa des moments jusqu’à l’ordre n,ϕX(t)est nfois dérivable et ∀k≤n,

dkϕX

dtk(0) = (i)kE(Xk). Inversement si ϕX(t)est dérivable jusqu’à l’ordre n,Xa des moments

jusqu’à l’ordre 2m≤noù 2mest le plus grand entier pair inférieur ou égal à n.

La convergence en loi : La suite de v.a. (Xn)converge en loi vers la v.a. Xsi limn→+∞Fn(t) =

F(t)en tout point de continuité tde F, où Fn(resp. F) est la fonction de répartition de

Xn(resp. X). La convergence des fonctions caractéristiques implique la convergence en loi,

c’est à dire si pour tout t∈R,limn→+∞ϕXn(t) = ϕX(t), alors Xnconverge en loi vers X

(théorème de Paul Lévy faible).

Théorème limite central : Si Xn(n≥1) sont des v.a. ayant un moment d’ordre 2, indépen-

dantes et de même loi d’espérance met de variance σ2et si on pose Sn=Pn

i=1 Xi, alors

limn→+∞1

σ√nSn−nm=N(0,1) en loi .

En particulier si les Xn(n≥1) sont des v.a. de Bernoulli de même paramètre p∈]0,1[,

limn→+∞qn

p(1−p)Sn

n−p=N(0,1) en loi.

V) Théorie générale des v.a., loi forte des grands nombres, divers modes de

convergence des suites de v.a.

Vecteur aléatoire (v.a.) (ou variable aléatoire si d= 1) : C’est une application mesurable X:

(Ω,T,P)−→ (Rd,Bd)où Bdest la tribu borélienne de Rd, c’est à dire :

∀B∈Bd,[X∈B] = {ω∈Ω ; X(ω)∈B} ∈ T(condition de mesurabilité).

Loi de probabilité d’un v.a. X de Rd: C’est la mesure de probabilité µXsur Bddéfinie par :

∀B∈Bd, µX(B) = P(X∈B)(mesure image de la mesure Ppar l’application Xde Ωdans

Rd).

Indépendance et loi de probabilité : Soit X= (X1, . . . , Xd)un vecteur aléatoire de loi µX

(sur (Rd,Bd)). Les v.a. Xk(1≤k≤d) sont indépendantes si et seulement si

µX=µX1⊗ ··· ⊗ µXd(produit tensoriel des lois marginales).

Espace L1: Une v.a. Xest dans L1(Ω,T,P) := L1si la fonction X: Ω →Rest intégrable

sur Ωpour la mesure Pi.e. RΩ|X|dP<+∞. Le nombre E(X) = RΩXdPest alors l’espérance

mathématique de X. De même pour p∈N∗on dit que Xest dans Lp(ou que Xa un moment

d’ordre p) si Xpest intégrable et le nombre E(Xp)est alors le moment d’ordre p. Enfin L1

est un espace vectoriel et X7→ E(X)est une forme linéaire sur L1.

4

Formule générale du transfert : Soit Xun v.a. de Rdet µXsa loi de probabilité sur Bd. Soit

ϕ:Rd→Rborélienne. Alors ϕ◦X∈L1(Ω,F, P )⇔ϕ∈L1(Rd,Bd, µX)et on a E(ϕ◦X) =

RΩϕ◦XdP=RRdϕ(x)dµX(x). Ainsi si Xest réelle et dans L1on a : E(X) = RRxdµX(x).

Espace de Banach L1: Si dans L1, on considère comme égales deux v.a qui sont égales P-

presque sûrement, on obtient l’espace L1. Avec la norme ||X||1=E(|X|), l’espace (L1,||.||1)

est un espace de Banach. Ainsi une suite (Xn)de v.a. de L1converge dans L1(vers une v.a.

Xde L1) si et seulement si limn,m→+∞E(|Xn−Xm|) = 0.

Inégalité de Markov : Si X∈L1, alors ∀a > 0, on a P(|X| ≥ a)≤E(|X|)

a.

Convergence dans L1et en probabilité : Si une suite (Xn)de v.a. de L1converge dans L1

vers une v.a. Xalors (Xn)converge vers Xen probabilité i.e. :

∀δ > 0,lim

n→+∞P(|Xn−X| ≥ δ) = 0.

Espace L2et variance : L2est un espace vectoriel. La variance d’une v.a. Xde L2est le

nombre V arX =E((X−E(X))2) = E(X2)−(E(X))2et l’écart type est σX=√V arX.

Tous les résultats établis sur l’espérance et la variance dans le cas des v.a. discrètes ou ayant

une densité, restent valables dans le cadre général. En particulier si Xet Ysont dans L2, la

v.a. XY est dans L1et on a E(|XY |)≤pE(X2)pE(Y2)(inégalité de Cauchy-Schwartz).

Il en résulte que L2est inclus dans L1.

Espace de Hilbert L2: Si dans L2, on considère comme égales deux v.a qui sont égales P-

presque sûrement, on obtient l’espace L2. Avec le produit scalaire < X, Y >2=E(XY )et la

norme ||X||2=pE(X2), l’espace (L2,||.||2)est un espace de Hilbert.

Convergence dans L2et en probabilité : Si une suite (Xn)de v.a. de L2converge dans L2

vers une v.a. Xalors (Xn)converge vers Xen probabilité.

Convergence p.s. : La suite de v.a. (Xk)converge P-p.s. (ou p.s.) vers la v.a. Xsi

P({ω∈Ω; limk→∞ Xk(ω) = X(ω)})=1.

Convergence p.s. et en probabilité : Si la suite de v.a. (Xk)converge p.s. vers la v.a. Xalors

elle convergence aussi en probabilité (i.e. la convergence p.s. implique la convergence en

probabilité).

CS de convergence p.s. : Si ∀ε > 0,P∞

k=1 P(|Xk|> ε)<+∞alors Xn→0p.s. En particu-

lier si (Xn)∈Lpet si P+∞

n=1 E(|Xn|p)<+∞alors Xn→0p.s.

Lemme de Borel Cantelli : Si (An)∈Tet ∞

X

n=1

P(An)<+∞. Alors P(lim sup An) = 0.

Loi forte des grands nombres : Si (Xk)est une suite de v.a. de L2, de même espérance m,

de variances bornées et 2 à 2 de covariance nulle alors 1

nPn

k=1 Xk→mp.s. (n→+∞).

Ce résultat est en particulier vrai si les v.a. (Xk)sont indépendantes et de même loi avec

moment d’ordre 2.

Loi forte des grands nombres de Kolmogorov : Si (Xk)est une suite de v.a. de L1indépen-

dantes et de même loi alors limn→+∞1

nPn

k=1 Xk=mp.s. (m=E(X1)).

La convergence en loi et les autres modes de convergence : Si une suite (Xk)de v.a. converge

vers une v.a. Xen probabilité, elle converge aussi en loi vers X.

5

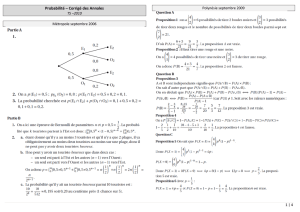

1

/

5

100%