notion de probabilite

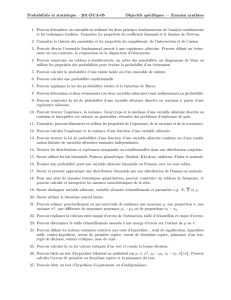

1

Variables aléatoires

Exemple:

On joue une partie de pile (P) ou face (F) en 4 lancers. A l’issue de la

partie globale, on peut considérer l’ensemble des éventualités comme

un ensemble de quadruplets comportant des P et des F [exemple:

(F, F, P, F) ]. Pour chaque partie, comptons les points de la façon

suivante:

* si le nombre de P est 3 ou 4, le joueur marque 1 point.

* si le nombre de P est 2, le joueur marque 0 point.

* si le nombre de P est 0 ou 1, le joueur marque - 1 point.

(F,F, F, P)

(P, P,F, F)

(P, P, P,F)

(F, F,P, F)

(P, F,P, F)

(P,P, F, P)

(F, P, F,F)

(F, P,F, P)

(P, F, P,P)

(P, F, F,F)

(F, F,P, P)

(F, P, P,P)

(F, F, F,F)

(F, P, P,F)

(P, P, P,P)

(P, F, F,P)

C

B

A

X X X

-1 0 1

Ainsi, à chacun des quadruplets

de A, on associe le nombre 1;

à chacun des quadruplets de B, on

associe 0;

à chacun des quadruplets de C, on

associe -1.

On définit ainsi une application X

de dans {-1, 0, 1} = X

Si X-1({0}) désigne l’ensemble

des éléments de tels que la

valeur associée à un quadruplet

soit égale à 0 (ou encore tels que

X() = 0), alors X-1({0}) = B.

2

De même, X-1({1}) = A et X-1({-1}) = C

On appellera variable aléatoire cette application qui au jeu de « pile

ou face » associe le gain.

Si, à chaque partie, la question se pose de savoir avec quelles

probabilités respectives, le joueur marque 0, 1 ou -1 point, on peut

répondre:

Proba [marquer un point] = P(A) = 5/16 =

P(C) = Proba [marquer -1 point]

Proba [marquer 0 point] = P(B) = 6/16 = 3/8.

Ainsi, on définit sur X (muni de l’ensemble des événements) une

probabilité P’ telle que :

P’ ({1}) = P(A) = P(C) = P’({-1})

P’({0}) = P(B)

Définition:

Soit (, P(), P) un espace probabilisé et (X, P(X)) un espace

probabilisable où X est une partie de IR (ou IR lui-même). Une

application X qui à un élément de fait correspondre un élément de X

, et plus généralement un nombre réel, est une variable aléatoire

rélle.

L’ensemble des valeurs de X peut être:

* un ensemble fini ou infini de nombres:

X est dite variable aléatoire discrète

3

* un intervalle, une réunion d’intervalles ou IR

: : X est dite variable aléatoire continue

Autrement dit, une variable aléatoire s’exprime à l’aide d’une

grandeur mesurable et ses variations dépendent du hasard.

Autres exemples de variables aléatoires: nombre de fleurs produites

par une plante, nombre d’acheteurs d’un produit donné, etc.

Propriété: On peut alors définir sur X une probabilité P’ en posant:

P’(A) = P[X-1(A)]

pour tout événement A de P(X).

Définitions: P’ est appelée loi de probabilité de X ou encore

distribution de X.

On appelle fonction de répartition de X la fonction F qui, à tout x

réel, fait correspondre le nombre réel positif défini par:

F(x) = P’(]- , x]) = P ({ X() x})

ou F(x) = P’(]- , x[) = P ({ X() < x})

Remarque 1: ces deux définitions conduisent à la même fonction dans

le cas continu. La deuxième est généralement utilisée en France dans

le cas des variables aléatoires discrètes.

4

Remarque 2 : le plus souvent, la loi de X n’est pas calculable à partir

de P, car l’espace lui-même est mal connu. C’est pourquoi on notera

la plupart du temps P la loi de probabilité.

5

Variables aléatoires discrètes.

La loi de probabilité est alors donnée par la probabilité de chacun des

points. On note en général P({X = xi}) = pi.

On a p1 + p2 + ... + pn = 1 dans le cas où X() est fini

ou p1 + p2 + ... + pn + ... = 1 (somme infinie des termes) dans le cas où

X() est infini

La fonction de répartition F de X est pour tout x:

F(x) = P(X <x) = P(X =x1) + P(X = x2) + ... + P(X = xi) avec xi < x

Exemple: Le nombre de pannes journalières d’une machine est une

variable aléatoire X dont la loi de probabilité est:

X

0

1

2

3

4

5

P(X = x)

0,1

0,3

0,4

0,1

0,05

0,05

Déterminer la fonction de répartition de X.

x < 0 F(x) = P(X < x) = 0

0 x < 1 F(x)= P(X < x) = P(X = 0) = 0,1

1 x < 2 F(x) = P(X < x) = P(X = 0) + P(X = 1) = 0,1 + 0,3 =

0,4

2 x < 3 F(x) = P(X < x) = P(X = 0) + P(X = 1) + P(X = 3) =

0,1 + 0,3 + 0,4 = 0,8

3 x < 4 F(x) = P(X < x) = P(X = 0) + P(X = 1) + P(X = 2) +

P(X = 3) = 0,1 + 0,3 + 0,4 + 0,1 = 0,90

4 x < 5 F(x) = P(X < x) = P(X = 0) + P(X = 1) + P(X = 2) +

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

1

/

26

100%