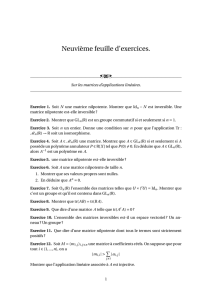

II. Matrices à coefficients dans un corps. 1 Opérations sur

K m, n ∈Nm,n(K)K

K m n m, n, p ∈N

m,n(K)×n,p(K)−→ m,p(K)

n(K) = n,n(K)

n(K)

n(K)m,n(K)n,m(K)

m(K)m,n(K)

Kmm,1(K) (Kn)?

1,n(K)

M∈m,n(K)Li(M)∈(Kn)?1≤i≤m i M

Cj(M)∈Km1≤j≤n j M

m,n(K)−→ n,m(K)

M−→ M

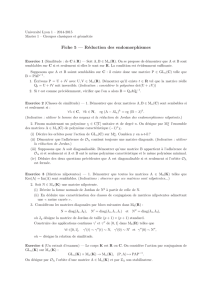

(Ei,j )1≤,i,j≤n n(K)

Ei,j .Ek,l =δj,k Ei,l

X(n)

i,j (s) = + sEi,j =

1· · · 0· · · 0· · · 0

0 1 · · · s· · ·

0 0 · · · 1· · ·

0· · · 0· · · 0· · · 1

1≤i6=j≤n s

(i, j)

1≤i6=j≤n k 6=j

(Cj(M X(n)

i,j (s)) = sCi(M) + Cj(M)

Ck(M X(n)

i,j (s)) = Ck(M)

M X(n)

i,j (s)

M M Cj Cj+sCi

1≤i6=j≤m k 6=i

(Li(X(m)

i,j (s)M) = Li(M) + sLj(M)

Lk(X(m)

i,j (s)M) = Lk(M)

M X(m)

i,j (s)M

M Li Li+sLj

λ= (λ1,· · · , λn)∈(K∗)n

(λ) =

λ10· · · 0

0λ2· · · 0

0

0 0 · · · λn

λ

Cj(M(λ)) = λjCj(M) 1 ≤j≤n

λ−→ (λ) (K∗)nn(K)

n(K)

d∈K∗

D(n)

j(d) = (d j)

µ−→ (µ) (K∗)mm(K)

Li( (µ)M) = µiLi(M) 1 ≤i, j ≤m

π:Sn−→ n(K)πσ= (δi,σ(j))1≤i,j≤nσ∈Sn

Pn(K)

M∈m,n(K)

Cj(M πσ) = Cσ(j)(M) 1 ≤j≤n

π:Sm−→ m(K)

Li(πσM) = Lσ−1(i)(M) 1 ≤i≤n

1≤i6=j≤n

P(n)

i,j =X(n)

i,j (1).X(n)

j,i (−1).X(n)

i,j (1)

j= (1,· · · ,1, d, 1,· · · ,1)

| {z }

d j

Ci(M P (n)

i,j ) = −Cj(M)

Cj(M P (n)

i,j ) = Ci(M)

Ck(M P (n)

i,j ) = Ck(M)

P(n)

i,j =i(−1)π(i,j)=π(i,j)j(−1)

Li(P(m)

i,j M) = Lj(M)

Lj(P(m)

i,j M) = −Li(M)

Lk(P(m)

i,j M) = Lk(M)

1≤i6=j≤m k 6=i, j

P(m)

i,j =X(m)

i,j (1).X(m)

j,i (−1).X(m)

i,j (1)

M∈ Mn(K)σ∈Sn

(π−1

σM πσ)i,j =Mσ(i),σ(j)

1≤i, j ≤n

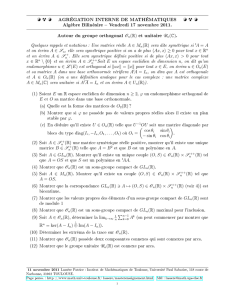

K6=F2n(K)(H) = HoP M =HoPn(K)

O(λ)∈ H

(π−1

σ(λ)πσ) = (σ.λ)

σ.λ = (λσ(1),· · · , λσ(n))P H

H P H ∩ P ={ } M =H.P

n(K)H.P M ⊂ n(K)(H)

M∈n(K)(H)λ∈(K∗)nM(λ)M−1∈ H

λ0∈(K∗)nM(λ) = (λ0)M1≤i, j ≤n

λ0

iMi,j =λjMi,j

M i, j1, j2

j16=j2Mi,j16= 0 Mi,j26= 0 λ∈(K∗)nλj16=λj2

M∈n(K)(H)M

:Km−→ [0,· · · , m]

x= (a1,· · · , am)Km(x)h∈[0,· · · , m]ai= 0

1≤i≤m−h h = 0 x am−h+1 6= 0

H∈m,n(K)H

(C1(H)) >· · · >(Cr(H)) >(Cr+1(H)) = · · · = 0

r≤n Cj(H)=0∈Kmj > n

Cj(H) 1 ≤j≤r H s(j) = m−(Cj(H)) + 1

Cj(H)s(j)H

H

Ls(j)(H) = Lj(n) 1 ≤j≤r

x∈Km

H

M∈m,n(K)H∈m,n(K)V∈n(K)

H=M.V

M∈m,n(K)

H:= M V n j := 1

i m

Hi,j = 0

s≥j+ 1 Hi,s 6= 0

X=P(n)

j,s

V:= V.X

H:= H.X

X=D(n)

j(1

Hi,j

)

V:= V.X

H:= H.X

s1j−1j+ 1 n

X:= X(n)

j,s (−Hi,s)

H:= H.X

V:= V.X

j:= j+ 1

j=n

H V ∈n(K)H=M.V

O

HjVjj H0=M V0=

Vj∈n(K)Hj

j Hj=M.Vj

X

Hj+1 =Hj.X Vj+1 =Vj.X Vj+1 ∈n(K)Hj+1

j+ 1 Hj+1 =M.Vj+1

K

m2n

4n(mn2)M

M∈m,n(K)H=M.V H

V∈n(K)E={Cj(H)/1≤j≤r}H

(M)MK={Cj(V)/r + 1 ≤j≤n}

(M)M

OHEKm(H)

H H =M.V V (M) = (H)

Cj(H) = MCj(V) 1 ≤j≤n Cj(V)∈(M)r+ 1 ≤j≤n

V V

y∈(M)V y =V x x ∈(H)

n

P

j=1

xjCj(H) =

r

P

j=1

xjCj(H)=0 H xj= 0 1 ≤j≤r

y=

n

P

j=r+1

xjCj(V)K(M)M

n(K)m,n(K)

M, M0∈m,n(K) (M0) = (M)V∈n(K)

M0=M.V

OM0=MV V ∈n(K) (M0) = (M)

(M0) = (M)

Kn= (M)⊕F Kn= (M0)⊕F0

M F (M)M0

F0(M0)x→V1x F 0F M0x=M.V1x

x∈F0

y→V2y(M0) (M)

z=y+x∈Kn= (M0)⊕F0V z =V2y+V1x V ∈n(K)M0=MV M

M∈m,n(K)n(K)

OH, H0∈m,n(K)

V∈n(K)H0=HV H0=H H

H0r r

V=r0

X Y

X∈n−r,r(K)Y∈n−r,n−r(K)

V H =e

H0e

H∈m,r(K)r

H

H0=HV =e

H0r0

X Y =H0r0=H

( (M)) = ( (M0))

6

6

1

/

6

100%