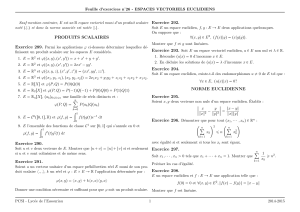

Espaces euclidiens

Espaces euclidiens

1. Généralités

Définition 1.1

Soit E un e.v. sur .

On appelle produit scalaire sur E toute forme bilinéaire sur E symétrique, définie et positive.

On note généralement un produit scalaire ou (x

|

y) pour x et y

∈E.

…x,y

Remarque 1.2

Les propriétés caractérisant un produit scalaire sur un e.v. réel E sont donc :

• ∀x,x',y∈E, ∀α,β∈

…x+x

∏

,y=…x,y+…x

∏

,y

• ∀x,y∈E

…x,y=…y,x

•…x,x=0ex=0

• ∀x∈E

…x,xm0

Exemples 1.3

•f :

2

→

(x,y) xy c'est-à-dire f

(x,y)

=

=

xy.

…x,y

• ϕ : [X]

×

[X] →

(P,Q) c'est-à-dire ϕ(P,Q)

=

= .

¶

0

1

P(t)Q(t)dt…P,Q

¶

0

1

P(t)Q(t)dt

Définition 1.4

L'application f définie par f :

n

×

n

→

(x,y) où x = (x

1

,x

2

,x

3

,...,x

n

) x

i

∈ pour tout i

=

1,n

i=1

n

x

i

y

i

et y = (y

1

,y

2

,y

3

,...,y

n

) y

i

∈ pour tout i

=

1,n

est appelé produit scalaire canonique sur

n

.

Remarque 1.5

La forme quadratique associée au produit scalaire canonique de

n

est où x = (x

1

,x

2

,x

3

,...,x

n

).q(x)=

i=1

n

x

i

2

Définition 1.6

On appelle espace préhilbertien réel tout espace vectoriel réel muni d'un produit scalaire.

On appelle espace euclidien tout espace préhilbertien réel de dimension finie.

Francis Wlazinski

1

Remarque 1.7

Hilbertien = evn complet dont la norme est issue d'un produit scalaire.

Préhilbertien de dim finie = Hilbertien.

Exemples 1.8

•Soit E = [X]

< > : [X]

×

[X] →

(P,Q) = (E,<

>) est un espace préhilbertien réel.

…P,Q

¶

0

1

P(t)Q(t)dt

•Soit F =

n

[X] {P∈[X] / deg P

≤

n} et soit < > le produit scalaire précédent.

(F,<

>) est un espace euclidien.

•Soient n*, G =

M

n

() et f l'application définie par f : (A,B) tr

(

t

A.B).

(G,<

>) = (G,f) est un espace euclidien.

Remarque 1.9

La donnée d'une forme quadratique de signature (n,0) sur un -e.v. de dimension n fournit une structure

d'espace euclidien.

Propriété 1.10

(Inégalité de Cauchy-Schwarz)

Soit (E,< >) un espace préhilbertien réel.

∀x,y∈E, .

…x,y[…x,x

1

2

…y,y

1

2

L'égalité est obtenue si et seulement si x et y sont linéairement dépendants.

Démonstration

Si y = 0, l'égalité de la propriété est vérifiée ∀x∈E. On peut donc supposer y ≠ 0.

Inégalité ∀x,y∈E et ∀λ∈ et on suppose x et y fixés.

car le produit scalaire est positif.

…x+y,x+ym0.

…x,x+…x,y+…y,x+

2

…y,ym0

.

2

…y,y+2…x,y+…x,xm0

Puisque y ≠ 0, est un polynôme de degré 2 en λ.

2

…y,y+2…x,y+…x,x

Ce polynôme est de signe constant donc le discriminant doit être négatif

ou nul, ce qui donne :

4…x,y

2

−4…x,x …y,y[0

g4…x,y

2

[4…x,x …y,y

.g…x,y[…x,x

1

2

…y,y

1

2

Egalité : •Supposons x = λy

…y,y=…y,y

.

…y,y

1

2

…y,y

1

2

=(

2

)

1

2

%…y,y

1

2

%…y,y

1

2

=…y,y

•Si on a l'égalité .

…x,y=…x,x

1

2

…y,y

1

2

On obtient .4…x,y

2

−4…x,x …y,y=0

Le discriminant est nul et l'on a donc une racine double pour le polynôme

.

2

…y,y+2…x,y+…x,x

Or, si celui-ci s'annule pour un λ

0

, on a nécessairement .

…x+

0

y,x+

0

y=0

C'est-à-dire x + λ

0

y = 0 où encore x = −λ

0

y.

Francis Wlazinski

2

Remarques 1.11

•On utilise aussi l'expression (au carré) : .

…x,y

2

[…x,x …y,y

•Si E =

n

, et si < > est le produit scalaire canonique, on obtient .

i=1

n

x

i

y

i

2

[

i=1

n

x

i

2

i=1

n

y

i

2

•Si E =

C

([0,1]) et si on prend comme produit scalaire : <

f,g

> = , on obtient

¶

0

1

f(t)g(t)dt

.

¶

0

1

f(t)g(t)dt

2

[

¶

0

1

(f(t))

2

dt

¶

0

1

(g(t))

2

dt

Propriété 1.12

Soit (E,< >) un espace préhilbertien réel.

L'application : E →

æ.æ

x <

x,x

>

1/2

est une norme.

c'est-à-dire (i)æxæ=0ex=0

(ii)∀x∈E, ∀λ∈.

æxæ=æxæ

(iii)∀x,y∈E.

æx+yæ[æxæ+æyæ

De plus, on obtient l'égalité dans (iii) lorsque x et y sont positivement liés.

Démonstration

(i) car le produit scalaire est défini.

æxæ=0e…x,x=0ex=0

(ii)æxæ=…x,x

1

2

=(

2

)

1

2

%…x,x

1

2

=æxæ

(iii) Inégalité triangulaire ou inégalité de Minkowski

æx+yæ

2

=…x+y,x+y=æxæ

2

+…x,y+…y,x+æyæ

2

=æxæ

2

+…x,y+…x,y+æyæ

2

=æxæ

2

+2…x,y+æyæ

2

si y = λx avec λ positif c’est une égalité et non sinon.

[æxæ

2

+2…x,y+æyæ

2

d'après Cauchy-Schwarz.

[æxæ

2

+2æxæ%æyæ+æyæ

2

[(æxæ+æyæ)

2

(iii) Egalité •Supposons y = λx avec λ∈

.

æx+yæ=æx+xæ=æ(1+)xæ=1+æxæ=(1+)æxæ

æxæ+æyæ=æxæ+æxæ=æxæ+æxæ=æxæ+æxæ=(1+)æxæ

•On a l'égalité de Cauchy-Schwarz lorsque x et y linéairement dépendants.

On vérifie aisément que y = λx avec λ∈

ne convient pas.

Remarques 1.13

•La norme associée au produit scalaire canonique de

n

est si x = (x

1

,x

2

,x

3

,...,x

n

).

æxæ=

i=1

n

x

i

21/2

•Pour retenir l'inégalité de Cauchy-Schwarz , on peut se rappeler de .

u.v=æuæ ævæcos(u,v)

Rappel 1.14

(Inégalité de Minkowski)

•Si E =

n

, et si < > est le produit scalaire canonique, on a .

i=1

n

(a

i

+b

i

)

21/2

[

i=1

n

a

i

21/2

+

i=1

n

b

i

21/2

•Si E =

C

([0,1]) et si on prend comme produit scalaire : <

f,g

> = , on obtient

¶

0

1

f(t)g(t)dt

.

¶

0

1

[f(t)+g(t)]

2

dt

1/2

[

¶

0

1

[f(t)]

2

dt

1/2

+

¶

0

1

[g(t)]

2

dt

1/2

Francis Wlazinski

3

Définition 1.15

Soit (E,< >) un espace préhilbertien réel. Soient x,y deux vecteurs non nuls de E. On appelle mesure de

l'angle non orienté du couple (x,y) le réel compris entre 0 et tel que cos

θ = .

<x,y>

<x,x>

1/2

<y,y>

1/2

Remarques 1.16

•Toutes les normes ne sont pas forcement issues d'un produit scalaire.

•On obtient un espace métrique en posant d(x,y) = .

æy−xæ

•Interprétation dans le cas euclidien : soit (e) une base d'un espace euclidien (E,< >) = (E,f ).

Si A =

M

e

(f) =

M

e

(< >) et si x a pour coordonnées X dans (e), alors ||

x

|| = (

t

XAX)

1/2

.

Propriété 1.17

Dans un espace euclidien, toute famille de vecteurs non nuls et deux à deux orthogonaux est libre.

Démonstration

Soit (E,< >) un espace euclidien de dimension n 1.

Soit (a

1

, a

2

, a

3

, ... , a

p

) une famille de vecteurs non nuls et deux à deux orthogonaux p∈* (on aura p

≤

n).

⇒

i=1

p

i

a

i

=0≤j=1,p<

i=1

p

i

a

i

,a

j

> = 0

⇒≤j=1,p

j

<a

j

,a

j

> = 0

⇒car < > est défini donc il n'y a pas de vecteurs isotropes.

≤j=1,p

j

=0

Donc c'est bien une famille libre.

Propriété 1.18

(Théorème de Pythagore)

Soit (E,< >) un espace euclidien de dimension n 1.

Soit (v

i

)

i

=1,p

une famille de vecteurs non nuls et deux à deux orthogonaux. Alors .

i=1

p

v

i

2

=

i=1

p

æv

i

æ

2

Démonstration

.

i=1

p

v

i

2

=<

i=1

p

v

i

,

i=1

p

v

i

> = <

i=1

p

v

i

,

j=1

p

v

j

> =

i=1

p

j=1

p

<v

i

,v

j

> =

i=1

p

<v

i

,v

i

> =

i=1

p

æv

i

æ

2

Remarque 1.19

Avec une notation f au lieu de < >, on obtient ou f(x

1

+x

2

+¢+x

n

,x

1

+x

2

+¢+x

n

)=f(x

1

,x

1

)+f(x

2

,x

2

)+£+f(x

n

,x

n

)

.

q

f

(x

1

+x

2

+¢+x

n

)=q

f

(x

1

)+q

f

(x

2

)+£+q

f

(x

n

)

Propriété 1.20

(Identité du parallélogramme)

Soit (E,< >) un espace euclidien. On a : ∀x,y∈E, .

æx+yæ

2

+æx−yæ

2

=2(æxæ

2

+æyæ

2

)

Démonstration

Voir exercice formes quadratiques 011 : q(x + y) + q(x − y) = 2q(x) + 2q(y).

Francis Wlazinski

4

2. Orthogonaux

Corollaire 2.1

Soit (E,<

>) un espace euclidien.

∀ϕ∈

L

(E,) = E* = dual de E (c'est-à-dire pour toute forme linéaire sur E).

∃!y

0

∈E / ϕ(x) = <

x,y

0

> ∀x∈E.

On a E* isomorphe à E.

Corollaire 2.2

Tout espace euclidien (E,< >) admet une base orthonormale et dans cette nouvelle base, le produit

scalaire est le produit scalaire canonique.

Propriété 2.3

Soit (e

1

, e

2

, ..., e

p

) est une base orthogonale d'un espace euclidien (E,<

>) de dimension p 1.

Alors, ∀v∈E, v = .

i=1

p

<v,e

i

>

<e

i

,e

i

>e

i

Démonstration

On a v = et, pour tout j = 1,p, <

v,e

j

> = .

i=1

p

v

i

e

i

<

i=1

p

v

i

e

i

,e

j

> =

i=1

p

v

i

<e

i

,e

j

> = v

j

<e

j

,e

j

>

D'où .

v

j

=<v,e

j

>

<e

j

,e

j

>

Remarque 2.4

Les coordonnées de v dans (e

1

, e

2

, ..., e

p

) sont donc .

<v,e

1

>

<e

1

,e

1

>,<v,e

2

>

<e

2

,e

2

>,..., <v,e

p

>

<e

p

,e

p

>

Si la base est orthonormale, on a pour tout j =1,p.

…e

j

,e

j

=1

Propriété 2.5

Soit (E,< >) un espace euclidien et soit F un s.e.v. de E.

On a E = F ⊕ F

⊥

et (F

⊥

)

⊥

= F.

F

⊥

est appelé le supplémentaire orthogonal de F.

Démonstration

On a une structure d'espace euclidien en considérant la restriction de < > à F.

Soit (e

i

)

i=1,p

une base orthonormale de F et soit x∈E.

Pour tout i = 1,p on pose λ

i

= <

x,e

i

> et .

a=

i=1

p

i

e

i

On a bien a∈F et on pose b = x − a.

On a, ∀i

=1,p, <

b,e

i

> = <

x,e

i

> − <

a,e

i

> = λ

i

− λ

i

= 0.

Donc b∈F

⊥

et x = a + b.

De plus, montrons que F∩F

⊥

= {0} : on sait déjà que {0} ⊂ F

∩

F

⊥

.

Soit maintenant x∈F∩F

⊥

, on a et donc x = 0.

æxæ

2

= < x,x> = 0

Puisque E = F ⊕ F

⊥

E = F

⊥

⊕ (F

⊥

)

⊥

, on a dim

F dim

(F

⊥

)

⊥

.

Or F (F

⊥

)

⊥

donc (F

⊥

)

⊥

= F.

Francis Wlazinski

5

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

1

/

15

100%