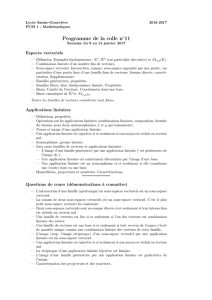

Cours s`algèbre - Faculté des Sciences de Rabat

1

Universit´e Mohammed V-Agdal

Facult´e des Sciences

D´epartement de Math´ematiques et informatique

Avenue Ibn Batouta, B.P. 1014, Rabat, Maroc

Fili`ere DEUG :

Sciences Math´ematiques et Informatique (SMI)

et

Sciences Math´ematiques (SM)

Module Math´ematiques II

Cours d’Alg`ebre II

Par

BENLARBI-DELAI M’HAMMED

JABBOURI ELMOSTAFA

LBEKOURRI ABOUBAKR

Ann´ee 2006-2007

2

Table des mati`eres

Chapitre 1 : Strucures alg´ebriques

1. Groupes

(a) G´en´eralit´es

(b) Sous-groupes

(c) Homomorphisme de groupes

(d) Groupes sym´etriques

2. Anneaux

(a) G´en´eralit´es

(b) Sous-anneaux

(c) Homomorphisme d’anneaux

3. Corps

(a) G´en´eralit´es

(b) Sous-corps

Chapitre 2 : Espaces vectoriels

1. G´en´eralit´es

(a) Structures d’espaces vectoriels

(b) Sous-espaces vectoriels

(c) Sous-espace vectoriel engendr´e par une partie

(d) Partie libre et partie li´ee

2. Espace vectoriel de dimension finie

(a) Lemme fondammental

(b) Existence d’une base-dimension d’un espace vectoriel

(c) Th´eor`eme de la base incompl`ete

(d) Dimension d’un sous-espace vectoriel

(e) Rang d’un syst`eme de vecteurs

3

3. Somme de sous-espaces vectoriels

(a) Somme de deux sous-espaces vectoriels

(b) Somme directe de deux sous-espaces

(c) Sous-espaces suppl´ementaires

(d) Somme de plusieurs sous-espaces

Chapitre 3 : Applications lin´eaires

1. G´en´eralit´es

2. Applications lin´eaires

3. Image et noyau d’une application lin´eaire

4. Th´eor`eme de la dimension

5. Alg`ebre L(E) et projecteurs

Chapitre 4 : Applications lin´eaires et Matrices

1. Matrices associ´ees aux applications lin´eaires

2. Matrice colonne associ´e ´a un vecteur

3. Matrice de l’inverse d’une application lin´eaire

4. Changement de bases

5. Rang d’une matrice

6. Matrices remarquables

Chapitre 5 : Valeurs propres et vecteurs propres

1. D´efinitions

2. Propri´et´es des valeurs propres et vecteurs propres

3. Polynˆome carat´eristique

4

Chapitre 1

Structures alg´ebriques

1.1 Groupes

D´efinition 1.1.1 .

1. Une loi de composition interne sur un ensemble Eest une application de E×E

dans E. Si fest une telle application, on appelle f(x, y)le compos´e de xet yet on

convient de noter f(x, y) = x∗y,xT y.... Un ensemble Emuni d’une loi interne

∗est not´e (E, ∗).

2. On appelle loi de composition externe sur E, de domaine de scalaires l’ensemble

A, une application de A×Edans E.

Exemples 1.1.2 .

1. L’addition et la multiplication sont des lois internes dans IN∗, IN, Z, lQ, IR, IC.

2. Si Eest un ensemble, les op´erations ∩et ∪sont des lois internes dans P(E).

3. Soient Eun ensemble et A(E, E)l’ensemble des applications de Edans E. La

composition des applications est une loi interne dans A(E, E).

4. La multiplication par un r´eel est une loi de composition externe dans IR, IC, IR[X],

IC[X].

5

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

1

/

52

100%