Laboratoire d`Analyse – Recherche en Economie Quantitative

48

Laréq

Par J. Paul Tsasa/ Chercheur co – accompli

Révision bayésienne, par Jean – Paul Tsasa

Laboratoire

d’

Analyse

–

Recherche

en

Economie Quantitative

One pager

Avril 2012

Vol. 1 – Num. 008

Copyright © tsasajp –laréq 2012

www.lareq.com

Probabilité et révision bayésienne

De la genèse du calcul de probabilités à l’initiation aux pratiques bayésiennes

Jean – Paul Tsasa V. Kimbambu†

L’abstraction est le prix à payer pour transcender la vision du commun de mortel !

[L’auteur]

La probabilité est – elle réductible à notre incapacité à prédire précisément quelles sont les forces qui pourraient

affecter un phénomène ? Ou fait – elle partie de la nature de la réalité elle – même comme le suggère la

mécanique quantique ou la théorie du chaos ?

Question ouverte

Probabilité : le hasard de Pascal versus le théorème de Cox – Jaynes

La probabilité peut être appréhendée en considérant soit une approche objective [démarche classique],

soit une approche subjective [démarche bayésienne]. La première approche, développée notamment par

Pascal, Bernoulli et Pòlya, consiste à dériver la probabilité de réalisation d’un événement grâce à des

calculs combinatoires. Et la deuxième approche, basée sur le théorème de Cox – Jaynes, suppose que

tout mécanisme d’apprentissage est soit isomorphe à la théorie des probabilités, soit incohérent. Ainsi,

au sens bayésien, la probabilité apparait comme une codification numérique d’un état de connaissance

[valeur subjective] obtenue par un processus rationnel et individuellement indépendant.

Par la suite, il parait donc important de distinguer à chaque fois que l’on approche le futur :

- D’une part, la probabilité de l’aléatoire qui est une évaluation du caractère vraisemblable d’un

événement dont les chances de réalisation est fonction de quelques phénomènes physiques

stochastique ;

- Et d’autre part, la probabilité de l’epistémé qui mesure l’incertitude éprouvée face à certaines

affirmations ou preuves par manque d’informations et de connaissances sur les circonstances et

les causalités de choses.

Afin de bien saisir la dimension analytique du concept de probabilité et son application dans les pratiques

bayésiennes, il nous parait légitime de procéder comme suit. Présenter, d’abord, un panorama de

l’évolution de la théorie des probabilités‡. Ensuite, rappeler quelques notions et concepts clés du calcul de

probabilité. Et enfin, illustrer, par un exemple, le processus de révision bayésienne.

† Master en cours Economie – NPTCI 2011 ; Assistant CCAM – UPC et Chercheur au Laboratoire d’Analyse – Recherche

en Economie Quantitative [LAREQ] ; jeanpaultsasa@lareq.com – BP 16.626 Kinshasa I.

‡ Si l’on admet que la probabilité est une évaluation du caractère vraisemblable d’un événement, et donc, une mesure

de réalisation d’un événement ; ce que la théorie des probabilités peut dès lors être définie comme l’étude

mathématique des phénomènes stochastiques, c’est – à – dire caractérisés par le hasard et l’incertitude.

49

Laréq

Par J. Paul Tsasa/ Chercheur co – accompli

Evolution temporelle et conceptuelle de la probabilité

Laplace (1795) propose une première définition opérationnelle de la probabilité d’un événement, mais

l’attribue explicitement à Pascal : « la probabilité est une fonction dont le numérateur est le nombre de

cas favorable, et dont le dénominateur est le nombre de cas possibles ». Cette définition garde ses vertus

historiques mais demeure pas universellement valable, puisque, intrinsèquement, elle ne se réduit qu’à

des cas d’événements équiprobables.

Notons que la définition proposée par Laplace ne marque pas du tout le début de la pensée sur la

probabilité. En effet, comme le notent nombre d’historiens, notamment Ernet Coumet, le concept de

probabilité a fait également l’objet d’analyse par le savant des civilisations anciennes. Ainsi, Coumet

estime que le calcul de probabilité n’est pas né par hasard. Il est le fait d’une réflexion autour de

nombreuses situations concrètes vécues dans l’évolution et les développements de différents domaines

tels que le commerce, le contrat d’échange, les pratiques actuarielles, la médecine, etc.

Bien que longtemps ignoré en algèbre, géométrie, chimie et physique, le concept de probabilité a connu

une dynamique dans l’appréhension de sont contenu dès l’antiquité. Ainsi, par exemple, Aristote

considère la probabilité comme une opinion dont le caractère est généralement admis. Cicéron,

contrairement à Aristote ; associe la probabilité à la notion de vraisemblance.

Au XVIè siècle, Galilée établit un lien entre le concept de probabilité et la notion du risque. Et par la suite,

Bartolomé de Médina propose une définition proche du sens généralement admis à ce jour : la probabilité

est une traduction du caractère vraisemblable d’une idée. Il estimait que, une fois une opinion probable,

il est permis de la suivre, même si l’opinion opposée est plus probable.

Et enfin, Blaise Pascal et Pierre de Fermat, à travers une série de correspondance, intègre la notion de

hasard dans l’appréhension du concept de probabilité.

Les réflexions de Pascal et Fermat ont été sémantiques, puisqu’à l’origine d’une série d’innovations :

- Christian Huygens, encouragé par Pascal, publie en 1657, un premier traité sur la probabilité et

introduit la notion d’espérance mathématique ;

- Par la suite, Jakob Bernoulli, définit la variable aléatoire, établit le lien entre probabilité et

fréquence en cas de jeux répétés, propose la première expression de la loi binomiale et énonce

la loi des grands nombres [théorème de Bernoulli] ;

- Abraham de Moivre (1718) généralise l’usage de la combinaison ;

- Thomas Simpson (1755), sur base de travaux de Roger Coes, applique la théorie des erreurs aux

erreurs sur les observations ;

- Pierre – Simon Laplace (1812) énonce une première version du théorème central limite. Plus

tard, en 1901, Alexandre Liapounov donne sa version moderne et en 1910, Paul Lévy en fournit

la première preuve ;

- Emile Borel (1897) introduit les notions de mesure et d’ensembles mesurables. Ses travaux

seront complété par Henri Léon Lebesgue, avec la théorie de l’intégration ;

- Andrei Markov (1902) introduit les chaînes de Markov afin de généraliser la loi des grands

nombres par une série d’expérience dépendant les unes des autres ;

50

Laréq

Par J. Paul Tsasa/ Chercheur co – accompli

- Andrei Kolmogorov, par ses recherches, fait de l’analyse de probabilités une véritable théorie,

notamment, en énonçant son axiomatique et en révélant ses applications ;

- Kiyoshi Itô développe, dès 1940, une théorie et un lemme reliant l’analyse [équations aux

dérivées partielles] et les probabilités [calcul stochastique].

Le calcul de probabilités

Le calcul de probabilités est un exercice qui permet de chiffrer les chances de réalisation d’un événement.

Le calcul de probabilités est gouverné par des axiomes, théorèmes et lois. Ci – après, nous illustrons les

plus importants.

Soit E, la réalisation d’un événement quelconque ; p, sa probabilité de réalisation et q, sa probabilité de

non réalisation, Au sens de Laplace – Pascal :

où est le nombre de cas favorables et , le nombre de cas possible

et

Par conséquent :

Lorsque la réalisation de l’événement E est certain, , dans l’opposé [événement impossible],

Axiomatique de Kolmogorov

Soit un espace probabiliste (Ω, A, p), où Ω est l’ensemble fondamental ou l’univers ; A, la tribu ou un

sous – ensemble des événements Ei tel que et p Il ressort que les définitions classique [Laplace –

Pascal], fréquentiste [Bernoulli] et subjective [Bayès] de la probabilité de réalisation d’un événement

vérifient les axiomes suivants.

- Axiome 1 : pour tout événement E,

- Axiome 2 :

- Axiome 3 : pour événements mutuellement exclusifs,

Loi de multiplication de probabilités :

Les formules issues de la loi de multiplication diffèrent suivant la nature des événements.

- Pour des événements mutuellement non exclusifs et stochastiquement indépendants :

- Pour des événements mutuellement non exclusifs et stochastiquement dépendants :

- Pour des événements mutuellement exclusifs, on obtient la formule du crible :

51

Laréq

Par J. Paul Tsasa/ Chercheur co – accompli

Loi d’addition de probabilités :

De même, les formules issues de la loi d’addition diffèrent suivant la nature des événements.

- Pour des événements mutuellement non exclusifs et stochastiquement indépendants :

- Pour des événements mutuellement non exclusifs et stochastiquement dépendants :

- Pour des événements mutuellement exclusifs, on obtient la formule du crible :

Théorèmes de Morgan [ou Théorème de De Morgan§]

Les théorèmes de Morgan ont été mis à jour par le mathématicien Auguste De Morgan.

- Théorème 1 : lorsque deux événements E1 et E2 obéissent à la restriction d’indépendance

stochastique, il est prouvé que :

- Théorème 2 : si deux événements E1 et E2 obéissent à la restriction d’indépendance

stochastique, il est prouvé que :

-

Démonstration du théorème de Morgan

Théorème 1 :

Une manipulation mathématique simple montre

clairement que :

Théorème 2 :

Et en conséquence :

§ Appelé également lois de Morgan.

52

Laréq

Par J. Paul Tsasa/ Chercheur co – accompli

Binôme de Newton et Triangle de Pascal

Le binôme de Newton, du nom d’Isaac Newton, est généralement utilisé en calcul de probabilités lorsque

deux événements E1 et E2, ayant une probabilité de réalisation constante, sont complémentaires. Il est

donc construit en considérant une expansion entre deux termes. Supposons que soit la probabilité de

fabrique une bonne pièce de monnaie et , celle de fabrique une mauvaise pièce de monnaie.

1ière expérience

:

est la probabilité de fabriquer une bonne pièce de

monnaie ;

est la probabilité d’en fabriquer une mauvaise.

2ième expérience

:

est la probabilité de fabriquer 2 bonnes pièces de

monnaie ;

est la probabilité de fabriquer une bonne pièce et

une mauvaise ;

est la probabilité de fabriquer 2 mauvaises pièces

de monnaie.

3ième expérience

:

est la probabilité de fabriquer 3 bonnes pièces de

monnaie ;

est la probabilité de fabriquer 2 bonnes pièces et

une mauvaise ;

est la probabilité de fabriquer une bonne pièce et

2 mauvaises ;

est la probabilité de fabriquer 3 mauvaises pièces

de monnaie.

.

.

.

.

.

.

.

.

.

nième expérience

C’est la formule qui généralise le binôme de Newton,

avec, le nombre de fois où l’expérience est répétée.

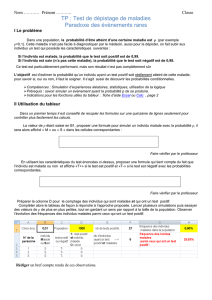

Le tableau illustratif ci – dessous établit un lien étroit entre le binôme de Newton et le triangle de Pascal.

Chaque terme repris à l’intérieur du triangle de Pascal correspond à la somme du terme immédiatement

supérieur et de celui qui se trouve directement à sa gauche.

i

m

0

1

2

3

4

5

6

7

8

9

10

0

1

1

1

1

2

1

2

1

3

1

3

3

1

4

1

4

6

4

1

5

1

5

10

10

5

1

6

1

6

15

20

15

6

1

7

1

7

21

35

35

21

7

1

8

1

8

28

56

70

56

28

8

1

9

1

9

36

84

126

126

84

36

9

1

10

1

10

45

120

210

252

210

120

45

10

1

Ainsi, les coefficients du binôme de Newton peuvent dès lors être dérivés à partir du triangle de Pascal.

6

6

7

7

1

/

7

100%