Introduction et « lecture conseillées

LES FONDEMENTS

COGNITIFS DE

L’INTELLIGENCE

Les travaux des psychologues factorialistes dans le domaine de l’intelligence ont

permis d’édifier des représentations fournissant une description de la structure des

aptitudes intellectuelles commune à tous les individus à partir de l’information

apportée par les tests (cf. chapitre 3). Pour autant, ces approches descriptives

n’informent que très peu sur les processus intellectuels qui sous-tendent la

performance observée aux tests. Comment alors atteindre, au-delà du constat des

différences de performance, les mécanismes ayant engendré celles-ci ?

Avec l’essor, vers la fin des années 50, de la psychologie cognitive générale et le

développement de méthodes de recherche permettant une exploration fine des

processus mentaux mis en œuvre dans le fonctionnement cognitif, les psychologues

différentialistes ont progressivement pris conscience des avantages à tirer de

l’application des outils conceptuels et méthodologiques de l’approche du traitement

de l’information à l’étude des aspects cognitifs des différences individuelles. Ainsi

est né un domaine d’investigation original se proposant d’appliquer les approches

expérimentale et différentielle à l’étude de la relation entre mécanismes cognitifs et

intelligence mesurée par les tests. L’intégration de l’approche fonctionnelle de la

cognition et de l’analyse des différences individuelles offre des perspectives très

intéressantes. Elle contribue tout d’abord à l’identification des mécanismes cognitifs

qui sous-tendent les différences de performance aux tests. A ce titre, elle éclaire sous

un autre jour les théories de l’intelligence et des aptitudes humaines. Elle contribue

aussi à l’identification de variations individuelles dont le caractère systématique a

pu échapper aux théories générales de la cognition mais doit être pris en compte.

Ce chapitre illustre la diversité des points de vue et des méthodes d’investigation

mises en œuvre pour réaliser ce projet. Nous verrons qu’un premier ensemble de

travaux a échoué à « localiser » les processus élémentaires responsables des

différences d’efficience intellectuelle. Une autre direction de recherche combinant

les approches expérimentale et différentielle s’est intéressée aux ressources de

traitement du système cognitif humain en tant que composante stable et générale de

la cognition. Les résultats obtenus n’éclairent cependant que très partiellement les

différences individuelles de performance aux tests d’intelligence. On peut également

douter de la valeur d’une explication générale des différences de performance aux

tests d’intelligence tant est grande la diversité inter- et intra-individuelle des

stratégies de résolution mises en œuvre, tant est complexe le jeu des relations entre

processus de haut niveau (impliqués par exemple dans la planification et la sélection

des stratégies, la surveillance et le contrôle de l’activité cognitive, etc.) et

connaissances générales ou plus spécifiques.

L’examen d’ensemble des faits d’expérience dont certains sont présentés et discutés

dans ce chapitre suggère que le produit de l’activité cognitive doit être compris

comme le résultat d’une interaction entre différents niveaux d’intégration de la

connaissance, différents degrés de savoir-faire, différents types de processus

cognitifs, les processus de contrôle de l’activité cognitive s’alimentant pour leur part

à des connaissances situées à un niveau supérieur d’organisation. En conséquence,

les différences d’efficience intellectuelle mises en évidence par les tests sont à

comprendre comme des différences dans le fonctionnement d’un système d’unités

cognitives interdépendantes qu’il est souhaitable d’appréhender à des niveaux

d’organisation différents.

LECTURES CONSEILLÉES

Ouvrages généraux :

HUTEAU, M., & LAUTREY, J. (1999). Evaluer l’intelligence : psychométrie

cognitive. Paris : Presses Universitaires de France.

1/

6

La quatrième partie de l’ouvrage (« Les perspectives de renouvellement ») présente

un bilan des travaux sur les différences de traitement de l’information responsables

des différences de performance aux tests.

MACKINTOSH, N.J. (2004). QI et intelligence humaine. Bruxelles : DeBoeck

Université.

Texte très accessible qui aborde de manière critique la notion de QI sous forme de

synthèse bien documentée de l’approche cognitive expérimentale des aptitudes

intellectuelles.

Pour aller plus loin :

LAUTREY, J. (Ed.) (1995). Universel et différentiel en psychologie. Paris : P.U.F.

Pour avoir un aperçu général de la psychologie différentielle. Certains textes de cet

ouvrage collectif complètent plusieurs des thèmes abordés dans ce chapitre.

LAUTREY, J., & RICHARD, J.-F. (Eds.) (2005). L’intelligence. Paris : Lavoisier.

La diversité des approches qui caractérise cet ouvrage témoigne de la multitude des

points de vue qui ont été adoptés pour étudier l’intelligence. La première partie

(« L’intelligence vue comme compétence individuelle ») est en lien avec certains des

points abordés dans ce chapitre.

REUCHLIN, M. (1999). Evolution de la psychologie différentielle. Paris : PUF.

Cet ouvrage regroupe un ensemble d’articles théoriques portant par exemple sur les

relations entre psychologie générale et psychologie différentielle, la différenciation

interindividuelle, les différences individuelles dans le fonctionnement cognitif, etc.

WILHELM, O., & ENGLE, R.W. (Eds.) (2005). Handbook of understanding and

measuring intelligence. London: Sage Publications.

Le lecteur trouvera dans cet ouvrage récent des revues de question consacrées à des

points traités dans ce chapitre : le rôle de la mémoire de travail dans la cognition

(chapitres 5, 6, 22 et 23), les liens entre connaissance et intelligence (chapitres 7, 8

et 20).

2/

6

A

L’INFLUENCE DE LA

PSYCHOLOGIE COGNITIVE

La psychologie cognitive dont le développement a révolutionné les conceptions

classiques de l’intelligence humaine, s’est progressivement dessinée en psychologie

expérimentale à partir des années 60. Elle peut être présentée aujourd’hui comme

l’étude des processus mentaux mis en jeu dans l’attention, la perception, la

mémoire, le langage, le raisonnement, etc., ainsi que celle de la connaissance, de son

organisation, de son utilisation et des mécanismes par lesquels elle s’acquiert (cf.

Grand Amphi, Psychologie Cognitive). S’il existe une grande variété de modèles du

fonctionnement cognitif, les psychologues qui étudient la cognition humaine ont

tous en commun de définir un niveau de description fondamental qui est celui du

traitement de l’information et d’explorer les processus mentaux au moyen de

paradigmes permettant de tester des hypothèses sur le fonctionnement du système

cognitif humain.

La démarche qu’adopte la psychologie cognitive est la même que celle des autres

disciplines scientifiques. Elle consiste d’abord à élaborer une théorie, un ensemble

de principes explicatifs qui visent à rendre compte d’une catégorie donnée de

phénomènes cognitifs. Des prédictions vérifiables (ou hypothèses) déduites de cette

théorie sont ensuite soumises à l’épreuve des faits. Pour cela, on imagine des

situations contrôlées visant à provoquer des conduites. Ces situations

expérimentales permettent de recueillir aussi rigoureusement que possible des

données d’observation, grâce auxquelles le caractère de vraisemblance des

hypothèses peut être empiriquement testé et évalué statistiquement. La réplication

des résultats obtenus permettra d’étayer la formulation de nouvelles hypothèses

susceptibles d’enrichir la théorie.

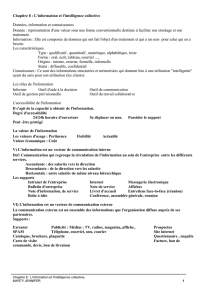

1. Un schéma minimal d’architecture cognitive

Pour des raisons qui tiennent à la démarche adoptée, les modèles de la psychologie

cognitive évoluent et l’interprétation d’un phénomène cognitif donné peut être

rapidement remise en question par de nouvelles données empiriques non

compatibles avec les prédictions du modèle. On peut néanmoins tenter de dégager

quelques propositions fonctionnelles minimales susceptibles d’être appliquées à une

large variété de phénomènes cognitifs.

Le schéma d‘architecture cognitive présenté ci-après met l’accent sur plusieurs

catégories de processus en relation avec différentes étapes du traitement de

l’information. L’information sensorielle doit d’abord être transformée en une

information de nature symbolique (par exemple, la perception d’un stimulus visuel

donnera lieu à la construction d’une image mentale). Des processus cognitifs

opèrent alors pour sélectionner l’information pertinente (fonctions attentionnelles),

organiser, interpréter et maintenir active cette information en mémoire temporaire

(fonction mémoire de travail). L’action de ces processus, y compris les plus

précoces, est guidée par les connaissances stockées en mémoire à long terme

(arrière-plan de connaissances).

Schéma d’architecture cognitive

3/

6

processus attentionnels

sélection

encodage

mémoire sensorielle

Mémoire de travail

Mémoire à long terme

arrière-plan de connaissances structurées par domaines

récupération, intégration,

organisation

activation, coordination

Evénements

externes

Réponse

Le psychologue qui étudie les différences individuelles dans le fonctionnement

intellectuel peut s’appuyer sur ce cadre théorique très général pour chercher à

identifier les mécanismes cognitifs susceptibles d’expliquer les différences de

performance aux tests d’aptitudes et d’intelligence.

2. L’interprétation cognitive des différences de performance aux tests

L’approche différentielle du fonctionnement intellectuel, prédominante en

psychologie de l’intelligence jusqu’à la fin des années 50, a progressivement suscité

des critiques de plus en plus vigoureuses. Les critiques d’ordre théorique remettaient

en question la conception, à la fois dispositionnelle et statique, que certains

différentialistes de l’époque avaient largement contribué à valider et diffuser. On

reprochait aussi à ces derniers d’utiliser une méthode essentiellement descriptive ne

permettant pas la confrontation d’explications psychologiques rivales des

différences de performance aux tests d’aptitudes (cf. chapitre 2, l’analyse factorielle

confirmatoire). Pour beaucoup de psychologues différentialistes pourtant, les

résultats des analyses factorielles pouvaient être interprétés en termes de processus

psychologiques sous-jacents. Ceux-ci ont donc été de plus en plus nombreux à

réaliser les possibilités offertes par les concepts de la psychologie cognitive pour

décrire et expliquer les différences individuelles dans le fonctionnement intellectuel.

Au milieu des années 70, Carroll, un psychologue spécialiste de l’analyse

factorielle, suggère de faire appel aux concepts de la psychologie cognitive pour

« interpréter » les sources de variation de la performance aux tests. Pour mener à

bien cette première spécification, Carroll s’appuie sur un modèle de fonctionnement

cognitif très influent à l’époque, le modèle en systèmes de production de Newell et

Simon (1972) pour préciser comment et dans quelle mesure les différences liées aux

structures, aux processus et à leur organisation pourraient contribuer aux différences

révélées par l’analyse factorielle.

Note marginale *******************************************************

Le modèle en systèmes de production est défini comme un ensemble ordonné de

séquences de production (condition-action : si...alors) impliquées dans la sélection

de l’information, le traitement et le stockage de l’information en mémoire à court

terme, le stockage et la récupération en mémoire à long terme, etc.

************************************************ fin de la note marginale

Prenons pour exemple le facteur primaire de vitesse perceptive dont un des

meilleurs indicateurs est le test des Figures Identiques. L’analyse cognitive qu’en

propose Carroll fait référence à la nature des stimuli, aux contenus mentaux

correspondants, aux opérations sur ces contenus et aux produits qui en résultent.

Elle se traduit par les hypothèses suivantes: 1) les processus sous-jacents sont des

processus de recherche visuelle ; 2) les différences individuelles sont principalement

associées à des paramètres temporels (vitesse d’encodage, vitesse de comparaison);

3) la structure impliquée est la mémoire à court terme (stockage temporaire d’une

information visuo-spatiale).

Encadré*************************************************************

Test des Figures Identiques : test papier-crayon de la batterie des Aptitudes

Mentales Primaires de Thurstone. Pour chaque item, le sujet a pour consigne de

retrouver dans une série de formes simples celles qui sont identiques à une figure de

référence (les bonnes réponses sont en noir dans l’exemple ci-dessous). Le score au

test est le nombre d’items auxquels le sujet a répondu correctement en un temps

donné (2 planches d’items à résoudre en 3 mn).

4/

6

Les tests de ce type saturent le facteur de vitesse perceptive décrit comme la rapidité

avec laquelle un individu peut comparer des figures et les retrouver au sein d’un

ensemble d’autres figures (cf. chapitre 3).

******************************************************Fin de l’encadré

Mais cette description a posteriori des variables latentes dont l’analyse factorielle

révèle l’existence n’est que peu satisfaisante si les conclusions tirées ne sont pas

ultérieurement mises à l’épreuve. Cette prise de conscience va conduire au

développement d’une approche dans laquelle les différences individuelles dans le

fonctionnement cognitif sont étudiées à partir de données d’observation recueillies

dans des situations expérimentales.

3. L’étude expérimentale des bases cognitives de l’intelligence

Les premiers travaux réalisés dans ce domaine reposent sur l’hypothèse qu’un

nombre réduit de mécanismes cognitifs généraux joue un rôle fondamental dans la

performance aux tests. Certains chercheurs ont ainsi étudié les corrélations entre la

vitesse d'exécution et/ou l'efficacité de processus élémentaires mesurés dans un

cadre expérimental spécifié et la performance aux tests d’intelligence ou d’aptitudes.

D’autres ont proposé de décomposer l'activité mentale mise en jeu lors de la

résolution d’items de tests d’intelligence en modélisant les étapes du traitement de

l’information. Quelle que soit l’approche privilégiée, on admet que les valeurs des

paramètres de traitement de l’information ainsi mesurés sont fonction de l’efficacité

de processus cognitifs de base qu’il s’agit d’identifier (section B). L’interprétation

de ces paramètres est souvent réductionniste.

Note marginale*******************************************************

Réductionnisme : réduction systématique d’un niveau de description et

d’explication à un autre niveau de description et d’explication ; réduire par exemple

le psychologique au biologique (les différences d’intelligence sont principalement

dues à des différences dans la vitesse de transmission de l’influx nerveux), le

psychologique au social (les différences dans le développement cognitif sont

essentiellement dues à des facteurs sociaux).

************************************************Fin de la note marginale

Un autre courant de recherches, plus soucieux que les précédents de références

théoriques explicites et validées par la psychologie cognitive, s’est ensuite tourné

vers les notions d’allocation des ressources attentionnelles et de capacité de la

mémoire de travail pour expliquer les différences de performance aux tests

d’intelligence. L’objectif des travaux effectués dans cette perspective est d’élucider

le rôle des ressources de traitement de l’information dans la performance aux tests

tout en considérant que les processus sous-jacents opèrent de manière relativement

indépendante des contenus symboliques (section C).

Les postulats qui fondent ces approches générales se sont cependant révélés parfois

peu compatibles avec les faits. L’approche élémentariste de l'activité mentale s’est

par exemple heurtée à la diversité des procédures mises en jeu pour résoudre une

tâche donnée. L’approche des ressources de traitement n’apporte de son côté qu’un

éclairage limité au rôle des connaissances dans la perception et la compréhension de

l’information à traiter. Si l’individu face aux demandes de la tâche peut en effet ne

pas allouer les ressources de traitement suffisantes pour mettre en œuvre une

stratégie de résolution adaptée, il peut aussi ne pas disposer des connaissances

nécessaires lui permettant la sélection de la stratégie la plus adaptée. On conçoit

donc, sur les bases de ce qui précède, l’intérêt à adopter un point de vue qui tienne à

la fois compte des contraintes imposées par la tâche et des connaissances et

ressources de l’individu. Plusieurs voies de recherche ont été empruntées.

L’une d’entre-elles a consisté à décrire les stratégies individuelles utilisées lors de la

résolution d’items de tests d’intelligence et à étudier l’évolution des choix

stratégiques avec l’apprentissage. Quantitative jusqu’alors, l’approche des bases

cognitives de l’intelligence s’est intéressée à des aspects plus qualitatifs du

traitement de l’information en tentant de mieux comprendre le rôle des choix

stratégiques et celui de la flexibilité de ces choix dans les différences de

performance aux tests (section D).

L’idée que les différences de performance aux tests d’intelligence renvoient, au

5/

6

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

62

62

63

63

1

/

63

100%