Une g n ralisation de l`algorithme JADE

1137

Dix-septième colloque GRETSI, Vannes, 13-17 septembre 1999

1138

Dix-septième colloque GRETSI, Vannes, 13-17 septembre 1999

1139

Dix-septième colloque GRETSI, Vannes, 13-17 septembre 1999

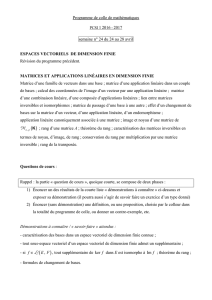

1 1.2 1.4 1.6 1.8 2 2.2 2.4 2.6 2.8 3

−2

−1

0

1

2

3

4

Cumulant Parameter

C3 and C4 for a PS signal

C3

C4

1 1.2 1.4 1.6 1.8 2 2.2 2.4 2.6 2.8 3

−35

−30

−25

−20

−15

−10

−5

0

Cumulants Parameter

Mean Index (dB)

JADE

eJADE

1 1.2 1.4 1.6 1.8 2 2.2 2.4 2.6 2.8 3

−35

−30

−25

−20

−15

−10

−5

0

Cumulants Parameter

STD Index (dB)

JADE

eJADE

1 1.2 1.4 1.6 1.8 2 2.2 2.4 2.6 2.8 3

−35

−30

−25

−20

−15

−10

−5

0

Cumulants Parameter

Mean Index (dB)

JADE

eJADE

1 1.2 1.4 1.6 1.8 2 2.2 2.4 2.6 2.8 3

−30

−25

−20

−15

−10

−5

0

Cumulants Parameter

STD Index (dB)

JADE

eJADE

1140

Dix-septième colloque GRETSI, Vannes, 13-17 septembre 1999

1

/

4

100%