Le cours - Playmaths

1 http://playmaths.free.fr

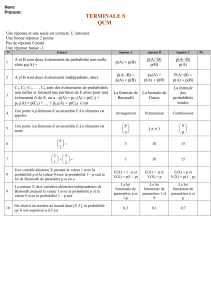

Probabilités

I. Vocabulaire

1) Exemple 1 :

Lançons un dé. A l’arrêt, sa face supérieure porte l’un des nombres 1, 2, 3, 4, 5 ou 6. Si le dé

est non truqué (on dit encore bien équilibré ou parfait), nous sommes incapables de prévoir

quelle face va apparaître. Nous sommes en présence d’une expérience aléatoire.

1, 2, 3, 4, 5 ou 6 sont les résultats ou les cas possibles ou les issues ou les éventualités.

L’ensemble des éventualités est l’univers

.

= {1, 2, 3, 4, 5, 6}

Un événement est une partie de l’univers.

Par exemple, l’événement « obtenir un nombre entier strictement supérieur à 4 » est

l’événement {5, 6}.

Le nombre d'éléments d'un événement A s'appelle son cardinal. On le note card A.

Card

= 6.

L’événement {4} (« obtenir 4 ») ne contient qu’une seule éventualité : c’est l’événement

élémentaire.

L’événement « obtenir 7 » est l’événement impossible ( C’est l’ensemble vide ; ).

L’événement « obtenir l’un des nombres 1, 2, 3, 4, 5, 6 » est l’événement certain ( C’est

l’univers

tout entier ).

Deux événements A et B sont dits incompatibles (ou disjoints) lorsqu’ils n’ont aucun élément

en commun, c'est-à-dire A

B =

A : « Obtenir un nombre pair » et B : « Obtenir 3 ou 5 » sont incompatibles.

L’événement contraire de A est le complémentaire de A dans

. ; on le note

A

.

Si A : « Obtenir un nombre pair », alors

A

:« Ne pas obtenir un nombre pair », c'est à dire

« Obtenir un nombre impair » et

A

= {1 ; 3 ; 5 }.

2) Exemples :

L’expérience aléatoire « lancer une pièce de monnaie » a deux issues : P et F ( Pile et Face).

L’univers est

= {P, F}.

Les événements élémentaires sont {P} et {F} ( « On obtient pile », « on obtient face »).

On lance deux pièces de monnaie :

= { PP ;PF ; FP ; FF }

On lance deux dés :

= {( i, j ) où 1 ≤ i ≤ 6 et 1 ≤ j ≤ 6 }

Ex

3) Loi des grands nombres

Lorsqu’on répète un grand nombre de fois une expérience aléatoire, la fréquence d’apparition

d’une éventualité tend vers une valeur « idéale » : on l’appelle probabilité de l’événement

élémentaire associé à l’éventualité considérée.

C’est un nombre compris entre 0 et 1. On le note P({a}), a étant l’éventualité observée.

Exemples :

On lance une pièce de monnaie. La probabilité d’obtenir « face » est 0,5.

On lance un dé. La probabilité d’obtenir le nombre 3 est égale à

Error!

. P({3}) =

Error!

.

II. Variable aléatoire et loi de probabilité

1) Variable aléatoire discrète

2 http://playmaths.free.fr

Définition :

Une variable aléatoire est une fonction X définie sur l’univers

et à valeurs dans Ë. On la

note X.

Exemple :

Une urne contient 10 boules indiscernables au toucher, l'une d'entre elles porte le numéro

10, deux portent le numéro 5, trois portent le numéro 2 et les autres portent le numéro 1.

On peut définir une variable aléatoire qui, à chaque tirage, associe le numéro obtenu.

Dans toutes les situations étudiées précédemment, la variable aléatoire X prend un nombre

fini de valeurs. On dit alors que X est une variable discrète.

2) Loi de probabilité d’une variable aléatoire

Définition :

Soit

l’univers d’une expérience aléatoire.

Définir une loi de probabilité P sur

= {x1 ; x2 ; ……. ; xn} , c’est associer, à chaque événement

élémentaire xi un nombre pi appartenant à l’intervalle [0 ; 1] tel que la somme des pi fasse 1.

Les nombres pi sont appelés probabilités. On note pi = P({xi})

On représente souvent la loi de probabilité sous forme d’un tableau de valeurs.

xi

x1

x2

…

xn

P(X = xi)

p1

p2

…

pn

Exemple:

Avec l’exemple précèdent, on a :

xi

10

5

2

1

P(X = xi)

10

1

10

2

10

3

10

4

Ex1-2-3… 9 p.302-304

3 http://playmaths.free.fr

III. Paramètres d’une loi de probabilité

1) Définitions :

On suppose que les issues x1, x2, … , xn sont des nombres réels et qu’une loi de probabilité

est définie sur E.

L’espérance mathématique de la loi de probabilité X est le nombre E(X) défini par

E(X) = p1x1 + p2x2 + …… + pnxn.=

n

1i iixp

Exemple :

Dans l’exemple précédent,

E(X) =

10

4

1

10

3

2

10

2

5

10

1

10

= 3

Rque : le calcul de l’espérance est un calcul de moyenne.

L’espérance est la moyenne de la série des valeurs xi pondérées par les probabilités pi.

La variance est le nombre V(X) défini par

V(X) = p1 (x1 – E(X))²+p2 (x2 - E(X))²+…… +pn (xn - E(X))² =

n

1i

2

i

2

i

n

1i

2

ii ))X(E(px))X(Ex(p

L’écart-type est le nombre

)X(V)X(

Exemple:

Dans l’exemple précédent :

xi

10

5

2

1

Total

P(X = xi)

10

1

10

2

10

3

10

4

xi2

100

25

4

1

pi xi2

10

100

10

50

10

12

10

4

10

166

V(X) =

10

166

- 3²=7,6

(X) =

76,26,7

Ex 10-11… p.303

2) Propriétés de l’espérance et de la variance:

Propriété :

Soit X la variable aléatoire définie sur l’univers d’une expérience aléatoire.

Soit a et b deux nombres réels.

On considère la variable aléatoire Y définie par Y = aX + b.

On a alors :

E(Y) = a E(X) + b

V(Y) = a² V(X)

(Y) =

a

(X)

4 http://playmaths.free.fr

Dem :

Soit X la variable aléatoire qui suit la loi de probabilité suivante :

xi

x1

x2

…

xn

P(X = xi)

p1

p2

…

pn

Alors la loi de probabilité de la variable aléatoire Y = aX+b est

yi

ax1+b

ax2+b

…

axn+b

P(Y = yi)

p1

p2

…

pn

E(Y) =

n

1i iiyp

=

n

1i ii )bax(p

=

n

1i iii bpxpa

= a

n

1i iixp

+b

n

1i i

p

= a E(X) + b

V(Y) =

n

1i

2

ii ))Y(Ey(p

=

n

1i

2

ii ))b)X(Ea(bax(p

=

n

1i

2

ii ))X(Eaax(p

=

n

1i

2

ii ))X(Ex²(ap

=

n

1i

2

ii ))X(Ex(p²a

= a²V(X)

...)Y(V)Y(

Ex 15-16 … p.304

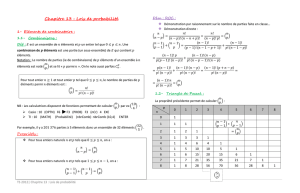

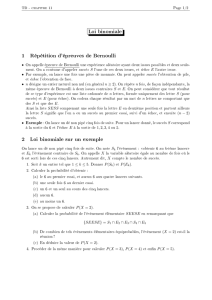

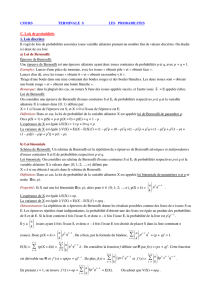

IV. Répétition d’expériences identiques et

indépendantes. Loi binomiale

1) Répétition d’expériences indépendantes

Définition :

Deux expériences aléatoires sont considérées comme identiques et indépendantes si elles

ont les mêmes issues et les mêmes probabilités pour chaque issue et si la réalisation de l’une

ne modifie pas les probabilités des issues de l’autre.

Exemple :

Lancer plusieurs fois de suite un dé et noter les résultats.

Tirer plusieurs fois de suite une boule dans un sac avec remise.

On représente généralement les issues de l’expérience considérée à l’aide d’un arbre

pondéré.

Propriété :

La probabilité d’une issue s’obtient en faisant le produit des probabilités inscrites sur le

chemin représentant cette issue.

Exemple :

5 http://playmaths.free.fr

Ex 21-22-23 p.305

QCM p.307

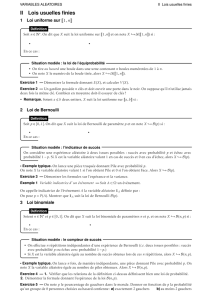

2) Epreuve de Bernoulli :

Définition :

Lorsque dans une expérience aléatoire, on ne s’intéresse qu’à la réalisation d’un certain

événement S, on dit que cette expérience est une épreuve de Bernoulli.

Si la probabilité du succès est p, on parle d’épreuve de Bernoulli de paramètre p.

Exemples :

Le jet d'une pièce de monnaie bien équilibrée constitue l'exemple le plus simple

d'épreuve de Bernoulli : la probabilité du succès («pile» par exemple) est 0,5 et celle de

l'échec («face» par conséquent) est également 0,5.

Mais le jet d'un dé classique peut également constituer un exemple d'épreuve de

Bernoulli, si l'on décide par exemple qu'un succès consiste à obtenir le 6 et que par

conséquent un échec consiste à ne pas obtenir le 6. La probabilité du succès est

6

1

et

celle de l'échec est

6

5

.

Remarque :

Si dans une épreuve de Bernoulli la probabilité du succès est p, la probabilité de l'échec est

1 - p.

Ex 1-2-4 p.332

3) Schéma de Bernoulli

Définition :

On appelle schéma de Bernoulli de paramètres n et p la répétition de n épreuves de

Bernoulli identiques et indépendantes de paramètre p.

Exemples :

Si l'on jette trois fois la même pièce de monnaie, on est en présence d'un schéma de

Bernoulli à 3 épreuves.

Une urne contient 3 boules noires et 5 blanches. Une expérience consiste à extraire

trois boules de cette urne et à noter leur couleur.

- Si le tirage des trois boules se fait avec remise, on est bien en présence d'un

schéma de Bernoulli à 3 épreuves, la probabilité d'un succès (obtenir une boule

blanche par exemple) étant

8

5

et celle de l'échec (obtenir une boule noire) étant

8

3

.

- Si par contre le tirage se fait sans remise, nous ne sommes plus en présence d'un

schéma de Bernoulli puisque les épreuves ne sont plus indépendantes les unes des

autres.

Ex 5 p.332

6

6

7

7

8

8

9

9

1

/

9

100%