Chapitre 3

Traitement et ´

evaluation des donn´

ees

statistiques

Sommaire

3.1 Intervalles de confiance ...................... 26

3.2 Aides statistiques au test d’hypothèse ............. 30

3.3 Analyse de variance ........................ 36

Les scientifiques utilisent l’analyse de données statistiques pour évaluer la qualité

des mesures expérimentales, tester différentes hypothèses et développer des modèles

pour décrire les résultats expérimentaux. Dans ce chapitre, nous examinons plusieurs des

applications les plus courantes du traitement des données statistiques. Ces applications

comprennent :

1. Définir un intervalle numérique autour de la moyenne d’un ensemble de résultats

répétés à l’intérieur desquels on peut s’attendre à ce que la moyenne de la popula-

tion se situe avec une certaine probabilité. Cet intervalle est appelé l’intervalle de

confiance. L’intervalle de confiance est lié à l’écart-type de la moyenne.

2. Déterminer le nombre de mesures répétées nécessaires pour s’assurer qu’une moyenne

expérimentale se situe dans une certaine plage avec un niveau de probabilité donné.

3. Déterminer à un niveau de probabilité donné si la précision de deux ensembles de

mesures est différente.

4. Comparer les moyennes de plus de deux échantillons pour déterminer si les dif-

férences dans les moyennes sont réelles ou le résultat d’une erreur aléatoire. Ce

processus est connu comme l’analyse de la variance.

25

Traitement et évaluation des données statistiques

3.1 Intervalles de confiance

Dans la plupart des analyses chimiques quantitatives, la valeur vraie de la moyenne µ

ne peut pas être déterminée car un grand nombre de mesures (se rapprochant de l’infini)

seraient nécessaires. Avec les statistiques, cependant, nous pouvons établir un intervalle

autour de la moyenne ¯xexpérimentalement déterminée à l’intérieur de laquelle la moyenne

de la population µdevrait se situer avec un certain degré de probabilité. Cet intervalle

est reconnu comme l’intervalle de confiance. Parfois, les limites de l’intervalle sont

appelées limites de confiance. Par exemple, on pourrait dire qu’il est 99% probable

que la vraie moyenne de la population pour un ensemble de mesures de potassium se

trouve dans l’intervalle 7,25 ±0,15% K. Ainsi, la probabilité que la moyenne se situe

dans l’intervalle de 7,10 à7,40% Kest de 99%.

La taille de l’intervalle de confiance, qui est calculée à partir de l’écart-type de l’échan-

tillon, dépend de la mesure avec laquelle l’écart type de l’échantillon sestime l’écart type

de la population σ. Si sest une bonne estimation de σ, l’intervalle de confiance peut être

significativement plus étroit que si l’estimation de σest basée sur seulement quelques

valeurs de mesure.

3.1.1 Détermination de l’intervalle de confiance lorsque σest

connu ou sest une bonne estimation de σ

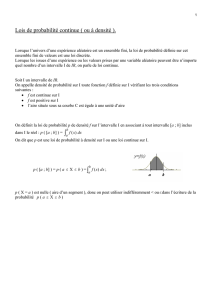

La Figure 3.1 montre une série de cinq courbes d’erreur normales. Dans chacun,

la fréquence relative est représentée en fonction de la quantité z(voir équation 2.7),

qui est l’écart par rapport à la moyenne, divisé par l’écart-type de la population. Les

zones ombrées dans chaque diagramme se situent entre les valeurs de −zet +zqui sont

indiquées à gauche et à droite des courbes. Les nombres sur les zones ombrées sont les

pourcentages des surfaces totales sous la courbe qui est incluse dans ces valeurs de z. Par

exemple, comme le montre la courbe (a), 50% de la surface sous n’importe quelle courbe

gaussienne est située entre −0,67σet +0,67σ. En passant aux courbes (b) et (c), nous

voyons que 80% de la superficie totale se situe entre −1,28σet +1,28σet 90% entre

−1,64σet +1,64σ.

Des relations comme celles-ci nous permettent de définir une gamme de valeurs autour

d’un résultat de mesure à l’intérieur duquel la vraie moyenne est susceptible de se situer

avec une certaine probabilité à condition d’avoir une estimation raisonnable de σ. Par

exemple, si nous avons un résultat xd’un ensemble de données avec un écart-type de σ,

nous pouvons supposer que 90 fois sur 100, la vraie moyenne µtombera dans l’intervalle

x±1,64σ(voir Figure 3.1c). La probabilité est appelée le niveau de confiance (NC).

Dans l’exemple de la Figure 3.1c, le niveau de confiance est de 90% et l’intervalle de

confiance est de −1,64σà+1,64σ. La probabilité qu’un résultat se situe en dehors de

l’intervalle de confiance est souvent appelée le niveau de signification.

Prof. A. Makan 26

Traitement et évaluation des données statistiques

Figure 3.1 – Surfaces au-dessous de la courbe Gaussienne pour différentes valeurs ±z

Si l’on fait une seule mesure xà partir d’une distribution de σconnue, on peut dire

que la vraie moyenne doit se situer dans l’intervalle x±zσ avec une probabilité dépendant

de z. Cette probabilité est de 90% pour z= 1,64, de 95% pour z= 1,96 et de 99% pour

z= 2,58, comme le montrent les Figures 3.1c, d et e. Nous trouvons une expression

générale pour l’intervalle de confiance (IC) de la vraie moyenne en mesurant une seule

valeur xet en réarrangeant l’équation 2.7 (souvenez-vous que zpeut prendre des valeurs

positives ou négatives). Ainsi,

IC pour µ =x±z σ (3.1)

Rarement, cependant, nous estimons la vraie moyenne à partir d’une seule mesure.

Au lieu de cela, nous utilisons la moyenne expérimentale ¯xde Nmesures comme une

meilleure estimation de µ. Dans ce cas, nous remplaçons xdans l’équation 3.1 par ¯xet

σpar l’écart-type de la moyenne, σ/√N, c’est-à-dire,

IC pour µ = ¯x±z σ

√N(3.2)

Les valeurs de zà divers niveaux de confiance se trouvent dans le Tableau 3.1, et la

taille relative de l’intervalle de confiance en fonction de Nest indiquée au Tableau 3.2.

L’équation 3.2 nous indique que l’intervalle de confiance pour une analyse peut être

réduit à la moitié en faisant la moyenne de quatre mesures. Seize mesures réduiront l’in-

Prof. A. Makan 27

Traitement et évaluation des données statistiques

Tableau 3.1 – Niveaux de confiance de dif-

férentes valeurs de z

Niveau de

confiance, %

z

50 0.67

68 1.00

80 1.28

90 1.64

95 1.96

95.4 2.00

99 2.58

99.7 3.00

99.9 3.29

Tableau 3.2 – Taille de l’intervalle de

confiance en fonction de la moyenne des

nombres de mesure

Moyenne des

nombres de

mesure

Taille relative

de l’intervalle

de confiance

1 1.00

2 0.71

3 0.58

4 0.50

5 0.45

6 0.41

10 0.32

tervalle d’un facteur de 4, et ainsi de suite. Nous atteignons rapidement un point de

rendements décroissants, cependant, en faisant la moyenne de plus de résultats. Norma-

lement, nous profitons du gain relativement important obtenu en faisant la moyenne de

deux à quatre mesures, mais nous pouvons rarement nous permettre le temps ou la quan-

tité d’échantillon requis pour obtenir des intervalles de confiance plus étroits grâce à des

mesures répétées supplémentaires.

Il est essentiel de garder à l’esprit à tout moment que les intervalles de confiance

basés sur l’équation 3.2 ne s’appliquent qu’en l’absence de biais et seulement si on peut

supposer que sest une bonne approximation de σ. Nous indiquerons que sest une bonne

estimation de σen utilisant le symbole s→σ(sproche de σ).

3.1.2 Détermination de l’intervalle de confiance lorsque σest

inconnu

Souvent, les limitations dans le temps ou dans la quantité d’échantillon disponible

nous empêchent de faire suffisamment de mesures pour supposer que sest une bonne

estimation de σ. Dans un tel cas, un seul ensemble de mesures répétées doit fournir

non seulement une moyenne, mais aussi une estimation de la précision. Comme indiqué

précédemment, scalculé à partir d’un petit ensemble de données peut être assez incertain.

Ainsi, les intervalles de confiance sont nécessairement plus larges lorsque nous devons

utiliser une valeur de sde petit échantillon comme notre estimation de σ.

Pour tenir compte de la variabilité de s, nous utilisons le paramètre statistique im-

portant t, qui est défini exactement de la même manière que z(équation 2.7), sauf que s

est substitué à σ. Pour une seule mesure du résultat x, on peut définir tcomme :

Prof. A. Makan 28

Traitement et évaluation des données statistiques

Tableau 3.3 – Valeurs de tpour différents nivaux de probabilité

Degré de

liberté

80% 90% 95% 99% 99,9%

1 3.08 6.31 12.7 63.7 637

2 1.89 2.92 4.30 9.92 31.6

3 1.64 2.35 3.18 5.84 12.9

4 1.53 2.13 2.78 4.60 8.61

5 1.48 2.02 2.57 4.03 6.87

6 1.44 1.94 2.45 3.71 5.96

7 1.42 1.90 2.36 3.50 5.41

8 1.40 1.86 2.31 3.36 5.04

9 1.38 1.83 2.26 3.25 4.78

10 1.37 1.81 2.23 3.17 4.59

15 1.34 1.75 2.13 2.95 4.07

20 1.32 1.73 2.09 2.84 3.85

40 1.30 1.68 2.02 2.70 3.55

60 1.30 1.67 2.00 2.62 3.46

∞1.28 1.64 1.96 2.58 3.29

t=x−µ

s(3.3)

Pour la moyenne de Nmesures,

t=¯x−µ

s/√N(3.4)

Comme zdans l’équation 3.1,tdépend du niveau de confiance désiré. Cependant, t

dépend aussi du nombre de degrés de liberté dans le calcul de s. Le Tableau 3.3 donne

des valeurs de tpour quelques degrés de liberté. Des tableaux plus détaillés se trouvent

dans divers manuels mathématiques et statistiques. Notez que ts’approche de zlorsque

le nombre de degrés de liberté devient grand.

L’intervalle de confiance pour la moyenne ¯xde Nmesures de réplicats peut être

calculée à partir de tpar l’équation 3.5, qui est similaire à l’équation 3.2 en utilisant z:

IC pour µ = ¯x±t s

√N(3.5)

Prof. A. Makan 29

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

1

/

17

100%