THEORIE ELEMENTAIRE DES PROBABILITES

La loi binomiale et la loi de Poisson

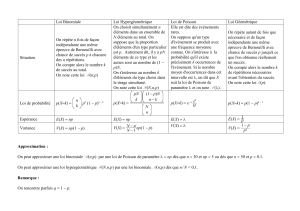

LOI BINOMIALE

Formulation

Soit une épreuve donnant lieu à un événement A suivant la probabilité P(A) = p, ou à la non

réalisation de l'événement A suivant la probabilité complémentaire P(non A) = 1 - p = q.

On définit alors la loi binomiale comme une loi discrète dont l'expression est donnée par :

)kn(kk

n

k)p1(pCP)kK(P −

−⋅⋅===

où n est le nombre d'expériences aléatoires identiques et stochastiquement indépendantes et k

est le nombre de fois où l'événement A est réalisé.

La loi binomiale donne alors la probabilité d'observer k fois la réalisation d'un événement

A au cours de n épreuves indépendantes (

n

k0

≤

≤

).

Cette loi est alors caractérisée par l'unique paramètre p.

Les valeurs successives du terme )kn(kk

n

)q(pC −

⋅⋅ pour k variant de 0 à n, correspondent aux

termes du développement du binôme et puisque (p + q) = 1, on a bien :

n

)qp( +

1PP

n

0k

k

0k

k∑∑ =

+

∞

=

==

D'où l'appellation de loi binomiale.

On peut également retrouver la loi binomiale en considérant la variable aléatoire K comme

une somme de n variables alternatives (ou variable de Bernoulli) indépendantes de même

paramètre p. La loi binomiale est alors aussi appelée loi d'alternatives répétée.

Domaine d'applications

Tirage dans une population infinie où une proportion p d'individus possède le

caractère auquel on s'intéresse.

Exemple : le nombre de jour de pluvieux dans un mois.

Si la population est finie, il faut remettre les individus tirés après chaque tirage pour

appliquer la loi binomiale.

Représentation de la loi

En faisant le rapport de deux probabilités successives, on obtient :

)p1(k

p)1kn(

P

P

1k

k

−

+

−

=

−

1

La loi binomiale et la loi de Poisson

on obtient ainsi une expression pour calculer les probabilités par récurrence :

1kk P

)p1(k

p)1kn(

P−

⋅

−

+

−

=

et il en résulte que

1)(npk si PP 1kk

+

⋅

<

>−

1)(npk si PP 1kk

+

⋅

== −

1)(npk si PP 1kk

+

⋅

>< −

0

0.05

0.1

0.15

0.2

0.25

0.3

0.35

12345678910

P

k

n = 10

k

p = 0,2

0

0.05

0.1

0.15

0.2

0.25

0.3

12345678910

P

k

n = 10

k

p = 0,5

0

0.05

0.1

0.15

0.2

0.25

0.3

0.35

0.4

0.45

12345678910

Pkn = 10

k

p = 0,9

• Donc si pour la plus forte valeur possible de k (c'est à dire k = n), on a encore

, alors la distribution est constamment croissante. Ça se produit lorsque

.

1)(npnk +⋅<=

)1n/(np +≥

• Inversement, si pour la première valeur de k (c'est à dire pour k=1), on a déjà

, alors la distribution est constamment décroissante. Ça se produit lorsque

.

1)(np1k +⋅>=

)1n/(1p +≤

• Dans tous les autres cas, on a une distribution en cloche, admettant un maximum.

On peut montrer que si n tend vers l'infini, la fréquence modale (valeur de k/n maximale)

tend vers la probabilité d'apparition de l'événement au cours d'une épreuve individuelle :

p.

Moments de la loi

En rappelant que la variable de la loi binomiale est la somme de n variables de Bernoulli

indépendantes on en déduit la moyenne, la variance et d'autres moments.

np)K(E = : moyenne

npq

2

K=σ : variance

on a aussi

)pq( npq

3−=

μ

2

La loi binomiale et la loi de Poisson

3npq)6pq-(1 npq

4

+

=

μ

On en déduit

npq/)pq(

2/3

2

3

1−=

μ

μ

=γ

npq/)npq3pq61(

2

2

4

2+−=

μ

μ

=γ

Les distributions binomiales sont donc symétriques lorsque p = q = 1/2.

Il apparaît que toute distribution binomiale est entièrement caractérisée par sa moyenne et sa

variance.

La fonction génératrice des moments s'écrit :

()

n

t

kqe p)t(m +=

Loi binomiale généralisée ou loi polynomiale

La loi binomiale peut être étendue au cas de h événements complémentaires A1, ..., Ah de

probabilités P1, ..., Ph telles que : ∑

=

=

h

1i

i1P

Soit K1, ..., Kh les h variables aléatoires représentant les nombres de réalisations de A1, ..., Ah

au cours de n expériences indépendantes identiques. Ces variables sont telles que

∑

=

=

h

1i

inK.

Alors on peut établir que la probabilité d'observer k1 fois A1 et ... et kh fois Ah est :

h

k

h

1

k

1

h

1

hh

11 P....P

!k!...k

n!

)kK et ... et kK(P ===

Il s'agit en fait d'une distribution à h – 1 dimensions, car la dernière variable aléatoire est

déduite de la relation

∑

=

=

h

1i

inK.

3

La loi binomiale et la loi de Poisson

LOI DE POISSON

Formulation

Pour définir la loi de Poisson, on part d'une loi binomiale dont on fait varier les paramètres p

et n de la façon suivante :

positive) constante (une mnp

0p

n

→

→

∞→

Dans ces condition on peut montrer que le terme knkK

n

qpC − tend vers m

k

e

!k

m−

Cette propriété appelée "théorème de poisson", montre que la loi et les distributions

binomiales se transforment, à la limite, en une loi et un ensemble de distributions dites de

Poisson exprimées par :

!k

m

eP)kK(P

k

m

k

−

===

et caractérisée par un seul paramètre m.

Domaine d'utilisation

En pratique, lorsque n est suffisamment grand et lorsque p est suffisamment petit,

toute distribution binomiale peut être remplacée sans erreur importante par une loi de

Poisson de paramètre m = np. L'emploi de ces distributions nécessite en effet moins de calculs.

Habituellement, l'approximation de la loi binomiale par la loi de Poisson est utilisée

lorsque n > 50 et lorsque le produit m = np < 5.

Cette loi est très utilisée pour décrire l'apparition d'événements en fonction du temps,

et en l'utilisation en liaison avec la loi exponentielle.

Représentation de la loi

En faisant le rapport sur on trouve la formule de récurrence :

k

P1k

P−

k

m

PP 1kk ⋅= −

4

La loi binomiale et la loi de Poisson

0

0.05

0.1

0.15

0.2

0.25

0.3

0.35

0.4

0.45

0.5

012345678910

m = 0,7

0

0.05

0.1

0.15

0.2

0.25

0.3

0.35

0.4

0.45

0.5

012345678910

m = 2,1

0

0.05

0.1

0.15

0.2

0.25

0.3

0.35

0.4

0.45

0.5

012345678910

m = 4,5

Moments et propriétés

La loi de Poisson décrit une loi binomiale en prenant np = m, or dans une loi binomiale le

produit np est égal à la moyenne de la variable. On en déduit que pour la loi de Poisson, le

paramètre m est la moyenne de la variable.

µ= m)K(E

=

on montre d'autre part que

m

2

K=σ

Si une variable aléatoire suit une loi de Poisson, alors la distribution de Poisson est caractérisé

par le paramètre m qui est égal à la fois à la moyenne et à la variable de la variable aléatoire.

On a aussi

mm3 et m 2

43 +=μ=μ

d'où

3m/1 et m/1 21 +=γ=γ

La fonction génératrice des moments s'écrit :

t

mem

kee)t(m −

=

Propriétés d'additivité

La somme de n variables indépendantes suivant des lois de Poisson de paramètres m1,

..., mn suit aussi une loi de Poisson de paramètre m = m1 + ... + mn.

5

1

/

5

100%