algebre1

Alg`ebre 1 : Calculs alg´ebriques & Alg`ebre

lin´eaire

1

−1

1 2−1−2(1,0)

(-2,1)

(0,1)

x

y

v

O

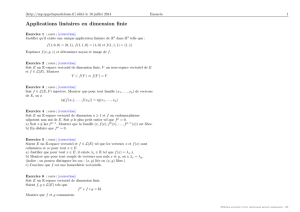

Illustration de la base canonique de R2. Les vecteurs bleu et orange sont les ´el´ements de cette base ; le vecteur

vert peut ˆetre exprim´e en fonction des autres vecteurs, et donc est lin´eairement d´ependant.

Sommaire

I´

El´ements de logique et de th´eorie des ensembles 1

1´

El´ements de logique 2

1.1 Proposition et connecteurs logiques . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 2

1.2 Quantificateurs . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 3

1.3 Raisonnement math´ematique . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 3

2´

El´ements de th´eorie des ensembles 4

2.1 Op´erations sur les ensembles . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 4

2.2 Applications . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 6

2.3 L’ensemble des entiers naturels . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 9

II Polynˆomes 11

3 G´en´eralit´es 12

3.1 D´efinitions et op´erations . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 12

3.2 Degr´e . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 13

3.3 D´eriv´ees d’un polynˆome et racines . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 13

3.3.1 D´eriv´ees . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 13

3.3.2 Racines d’un polynˆome . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 15

4 Arithm´etique dans K[X]16

4.1 Division euclidienne . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 16

4.2 Polynˆomes irr´eductibles et P GCD de 2 polynˆomes . . . . . . . . . . . . . . . . . . . . . . . . . . 16

4.3 D´ecomposition en facteurs irr´eductibles . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 17

4.3.1 Cas C[X] . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 17

4.3.2 Cas R[X] . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 17

III Espaces vectoriels 18

5 D´efinitions et exemples 19

5.1 E={0}. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 19

5.2 E=Kn, n ∈N∗. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 19

5.3 K[X] . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 20

5.4 L’ensemble des suites `a valeurs dans K. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 21

5.5 L’ensemble des applications de T`a valeurs dans K. . . . . . . . . . . . . . . . . . . . . . . . . . 21

6 Sous-espaces vectoriels 22

6.1 D´efinitions-exemples . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 22

6.2 Intersection et somme de sous-espaces vectoriels . . . . . . . . . . . . . . . . . . . . . . . . . . . . 23

6.3 Sous-espace vectoriel engendr´e par une famille finie de vecteurs . . . . . . . . . . . . . . . . . . . 24

7 Familles g´en´eratrices et libres 26

7.1 Familles g´en´eratrices . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 26

7.2 Familles libres . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 26

2

8 Bases et dimension 27

8.1 D´efinitions . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 27

8.2 Th´eor`emes fondamentaux . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 27

8.3 Cons´equences du th´eor`eme de la dimension . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 27

8.4 Applications . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 28

9 D´etermination pratique de la dimension d’un espace vectoriel 29

9.1 Rang d’une famille de vecteurs . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 29

9.2 Calcul du rang d’une famille finie . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 29

IV Applications lin´eaires et Matrices 30

10 Applications lin´eaires 31

10.1 D´efinitions, propri´et´es, exemples . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 31

10.2 Noyau et image d’une application lin´eaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 31

10.3 Homoth´eties, projections, sym´etries . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 32

10.3.1 Homoth´eties . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 32

10.3.2 Projections . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 33

10.3.3 Sym´etries . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 33

11 Matrices 35

11.1 D´efinitions, op´erations . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 35

11.2 Repr´esentation des applications lin´eaires . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 35

11.3 Matrices carr´ees . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 36

3

Premi`ere partie

´

El´ements de logique et de th´eorie des

ensembles

1

Chapitre 1

´

El´ements de logique

1.1 Proposition et connecteurs logiques

D´efinition : Une proposition est un ´enonc´e math´ematique (ou non) qui poss`ede l’une des valeurs de v´erit´e

suivante : vraie (V) ou fausse (F).

Exemples :

1. «Il existe des hommes immortels »F (par exp´erience).

2. «L’ensemble des nombres entiers naturels premiers est infini »V (d´emontrable math´ematiquement).

N´egation : Soit P une proposition.

P non(P)

V F

F V

non(P) contraire logique de (P).

Conjonction et : Soient P et Q deux propositions.

P Q P et Q

V V V

V F F

F V F

F F F

(P et Q) est V si P et Q sont simultan´ements V.

Disjonction ou :

P Q P ou Q

V V V

V F V

F V V

F F F

(P ou Q) est V si l’une des propositions est V.

Implication : ⇒

(P ⇒Q) est synonyme de (non(P) ou Q) .

P non(P) Q P ⇒Q

V F V V

V F F F

F V V V

F V F V

– Le F implique n’importe quoi.

– (P ⇒Q) est F uniquement lorsque P vraie et Q fausse.

(P ⇒Q) V si et seulement si on a : si P est vraie alors Q est vraie.

2

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

1

/

43

100%