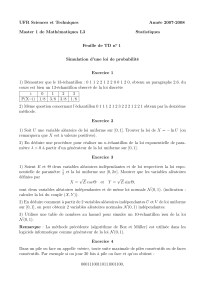

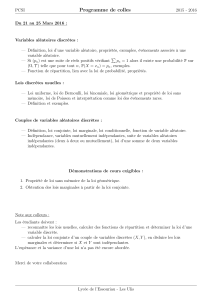

Vecteurs aléatoires

(Ω, P )XΩX(Ω)

X X2X

X(Ω)

X(Ω)

X Y Ω

(X, Y ) : Ω→R2

ω7→ X(ω), Y (ω)

X Y

PX,Y (X, Y )X Y

(x, y)∈X(Ω) ×Y(Ω)

PX,Y {(x, y)}=P(X, Y )=(x, y)=P(X=x)∩(Y=y)

X Y (X, Y )

X(Ω) = {x1, . . . , xn}Y(Ω) = {y1, . . . , ym}xiyj

X Y

X\Y y1y2· · · ym

x1PX,Y {(x1, y1)}PX,Y {(x1, y2)}· · · PX,Y {(x1, ym)}

x2

xnPX,Y {(xn, y1)}· · · PX,Y {(xn, ym)}

6X Y

(k, n)∈[[1,6]] ×[[2,12]] P(X=k)∩(Y=n)n k

(X, Y )

PX,Y X(Ω) ×Y(Ω)

(xk, yk)∈X(Ω) ×Y(Ω) PX,Y ({(x, y)} ∈ [0,1]

X

(x,y)∈X(Ω)×Y(Ω

PX,Y (x, y)=

n

X

i=1

m

X

j=1

P(X=xi∩Y=yj)

=

n

X

i=1

P(X=xi)=1

{Y=yj}j∈[[1, m]] Ω

(X, Y )PXPY

∀i∈[[1, n]] , P (X=xi) =

m

X

j=1

P(X=xi)∩(Y=yj)

∀j∈[[1, m]] , P (Y=yj) =

n

X

i=1

P(X=xi)∩(Y=yj)

i{X=xi}

{(X=xi)∩(Y=yj)}j∈[[1, m]]

PX,Y PXPY

(X, Y )

PX(xi)PY(yj)

X Y

Z= 7 −X X, Y Z {1,2,3,4,5,6}

(X, Y ) (X, Z)

123456

11

36

1

36

1

36

1

36

1

36

1

36

21

36

1

36

1

36

1

36

1

36

1

36

31

36

1

36

1

36

1

36

1

36

1

36

41

36

1

36

1

36

1

36

1

36

1

36

51

36

1

36

1

36

1

36

1

36

1

36

61

36

1

36

1

36

1

36

1

36

1

36

(X, Y )

123456

1000001

6

200001

60

30001

60 0

4001

6000

5 0 1

60000

61

600000

(X, Z)

X Y X

Z

x∈X(Ω) P(X=x)>0Y X =x

∀y∈Y(Ω), P (Y=y|X=x)

X λ > 0

p α

Y

Y X =n

Y λp

X Y (x, y)∈X(Ω) ×Y(Ω)

P(X=x∩Y=y) = P(X=x)P(Y=y)

(x, y)∈X(Ω) ×Y(Ω) P(X=x)>0

P(Y=y|X=x) = P(Y=y)

i∈[[1,6]]

P(Y=j|X=i) = 1

6=P(Y=j)∀j∈[[1,6]]

P(Z=j|X=i) = 1j= 7 −i

0j6= 7 −i

X Y

X Z X

Z

X Y

(x, y)∈X(Ω) ×Y(Ω)

PX,Y {(x, y)}=P(X=x)∩(Y=y)=P(X=x)P(Y=y)

X Y

Z

Z(ω) =

X(ω)X(ω)63.

Y(ω)X(ω)>3Y(ω)>3.

Y(ω)+3 X(ω)>3Y(ω)63.

(X, Y ) (X, Z)

X Z

X Y (A, B)⊂X(Ω) ×Y(Ω)

P(X, Y )∈A×B=P(X∈A)P(Y∈B)

X Y f g

X(Ω) Y(Ω) f(X)g(Y)

X Y N

X+Y

∀n∈N, P (X+Y=n) = X

i+j=n

P(X=i)P(Y=j)

=

n

X

i=0

P(X=i)P(Y=n−i)

{X+Y=n}=

n

[

i=0

{X=i∩Y=n−i}

P(X+Y=n) = P n

[

i=0

{X=i∩Y=n−i}!=

n

X

i=0

P(X=i∩Y=n−i)

=

n

X

i=0

P(X=i)P(Y=n−i)

X Y

S=X+Y7

P(S= 7) = P(X+Y= 7) =

7

X

i=0

P(X=i)P(Y= 7 −i)

=

6

X

i=1 1

6×1

6=6

36 =1

6

X Y B(p)B(n, p)

S=X+Y

X Y α β

S=X+Y

X1, X2, . . . , XnΩ

(α1, α2, . . . , αn)∈X1(Ω) ×X2(Ω) × · · · × Xn(Ω)

P n

\

i=1

(Xi=αi)!=

n

Y

i=1

P(Xi=αi)

X1, X2, . . . , Xn

(A1, . . . , An)∈ PX1(Ω)× · · · × PXn(Ω)(Xi∈Ai)

X1, . . . , Xnp∈[[1, n]] f g

X1(Ω) ×. . . ×Xp(Ω) Xp+1(Ω) ×. . . ×Xn(Ω)

f(X1, . . . , Xp)g(Xp+1,· · · , Xn)

X1, . . . , Xn

(X1+· · · +Xn−1)Xn

X1, . . . , XnB(p)p∈]0,1[ X1+· · · +Xn

B(n, p)

n∈N∗

p Xi1 0

X1+· · · +Xn

B(n, p)

X Y

E(X+Y) = E(X) + E(Y)

X Y

E(XY ) = X

16i6n

16j6m

xiyjP(X=xi)∩(Y=yj)

f(X, Y )=

XY

E(XY ) = X

(xi,yj)∈X(Ω)×Y(Ω)

xiyjP(X, Y )=(xi, yj)

X Y

E(XY ) =

6

X

i=1

6

X

j=1

ijP (X=i)∩(Y=j)

6

X

i=1

6

X

j=1

ij

36

=1

36

6

X

i=1

i

6

X

j=1

j=1

36 ×21 ×21 = 49

4

6

6

7

7

8

8

1

/

8

100%