Statistique Mathématique 2 (MATH-F

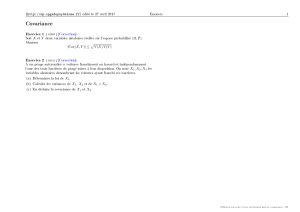

Statistique Mathématique 2 (MATH-F-309, Chapitre #1)

Thomas Verdebout

Université Libre de Bruxelles

2015/2016

Plan du cours

1. Vecteurs aléatoires.

2. Loi normale multivariée.

3. Inférence dans les modèles gaussiens.

4. Méthodes classiques de l’analyse multivariée.

5. Données directionelles.

6. Modèle linéaire.

Chapitre 1

Chapitre 1

1. Vecteurs aléatoires.

1.1. Définition, types de distributions.

1.2. Espérance et moments.

1.3. Indépendance.

1.4. Estimateurs usuels de µet Σ.

1.5. Modes de convergence, résultats limites.

1.6. Fonction caractéristique.

1.7. Jacobiens.

Définition

Soit (Ω,A,P)un espace de mesure.

Définition: un p-vecteur aléatoire (ou p-v.a.) X est une fonction

X: Ω →Rp

ω7→ X(ω) = X1(ω)

.

.

.

Xp(ω)= (X1(ω),...,Xp(ω))0

qui est mesurable, c’est-à-dire qui est telle que pour tout B ∈ Bp,

X−1(B) = {ω∈Ω|X(ω)∈B} ∈ A.

Terminologie: les composantes Xid’un v.a. X= (X1,...,Xp)0sont appelées les

marginales de X.

Les marginales sont elles-mêmes des v.a..

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

1

/

45

100%