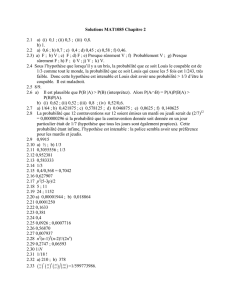

Un exemple introductifHistorique L`approche

π=

=, ...,

( = |π) = π(−π)−

∼(, π )

= ( ≥ |π)

= ( = |π) + ( = |π) + ... + ( = |π)

=X

=

≈.

α=.

χ

α=.

α

β

[ ; .]

π

π > π

α=.

α

(|)

(|)

:∼(,)

:∼(, π), π 6=

(|) ( |)

(|)

(|)

(|)

6

6

7

7

8

8

9

9

10

10

11

11

12

12

1

/

12

100%