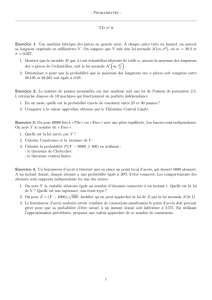

Probabilités Chapitre 10 Page 1 Probabilités. Chapitre 10. Les

___________________________

Probabilités Chapitre 10 Page 1

Probabilités. Chapitre 10.

Les convergences de suites de variables aléatoires.

Hypothèses : X, X

1

, X

2

,...,X

n

,... sont des variables aléatoires définies sur un même espace

probabilisé Ω.

Elles possèdent toutes une espérance mathématique et une variance.

I La convergence quadratique.

1. L’inégalité de Cauchy-Schwarz.

Désignons par σ et σ

n

les écarts-types respectifs de X et X

n

.

|COV(X, X

n

)| ≤ σ.σ

n

On obtient cette inégalité en écrivant que, le trinôme

V(αX + X

n

) = α

2

V(X) + 2αCOV(X, X

n

) + V(X

n

)

étant positif pour tout réel α, son discriminant est négatif.

Une conséquence de l’inégalité de Cauchy-Schwarz est :

(σ

n

– σ)

2

≤ V(X

n

– X)

Cette inégalité entraîne l’implication :

lim

n

→

+∞

V(X

n

– X) = 0 ⇒

lim

n

→

+∞

V(X

n

) = V(X).

La réciproque est fausse, comme le montre le contre-exemple suivant.

X

n

X 0 1

0 1

411

−

n 1

411

+

n

1 1

411

−

n 1

411

+

n

2. La convergence quadratique.

De l’égalité : E[(X

n

– X)

2

] = [E(X

n

– X)]

2

+ V(X

n

– X), il résulte que les propositions suivantes sont

équivalentes :

1

lim

n

→

+∞

E[(X

n

– X)

2

] = 0 ;

2

lim

n

→

+∞

E(X

n

) = E(X) et

lim

n

→

+∞

V(X

n

– X) = 0.

Lorsque ces propositions sont vraies, on dit :

la suite (X

n

)

n∈N*

de variables converge quadratiquement vers la variable X.

Dans ce cas :

lim

n

→

+∞

V(X

n

) = V(X).

___________________________

Probabilités Chapitre 10 Page 2

II La convergence en probabilité.

1 Définition.

La suite

(

)

*

X

n

n

N

∈

de variables converge en probabilité

vers la variable X si :

(

∀ε

> 0) (

lim

n→+∞

P ( |X

n

– X| > ε ) = 0)

2 Hiérarchie.

La convergence quadratique entraîne la convergence en probabilité.

La réciproque est fausse.

Démonstration (dans le cas de variables aléatoires absolument continues) :

On désigne par Y

n

la variable X

n

– X et par f

n

la densité de probabilité de Y

n

.

On suppose

lim

n

→

+∞

E[(Y

n

)

2

] = 0 et ε > 0.

[

]

∫∫ ∫

ε>ε≤

+==

tn

2

R t n

2

n

22

n

dt).t(f.tdt).t(f.tdt).t(f.t)Y(E

≥

∫

ε>tn

2

dt).t(f.t

≥

∫

ε>

ε

tn

2

dt).t(f

=

[

]

ε>ε

n

2

Yp.

( )

(

)

(

)

( )

( )

=ε

≤ε>

+∞→

0YElim

YE

YP

2

n

n

2

2

n

n

⇒

lim

n→+∞

P ( |Y

n

| > ε ) = 0

Voici un contre-exemple prouvant que la convergence en probabilité n’entraîne pas la convergence

quadratique : X

n

prenant la valeur 0 avec la probabilité 1 – 1/n et la valeur n avec la probabilité 1/n.

Quand n tend vers l’infini, X

n

tend vers 0 en probabilité mais pas en convergence quadratique.

3 L’inégalité de Bienaymé-Tchébycheff.

(Rappel)

Si E(X) = µ et V(X) = σ

2

, alors : (∀t > 0)(P ( |X – µ| > tσ ) ≤

1

2

t

)

Démonstration (dans le cas de variables aléatoires absolument continues) :

L’inégalité est vraie pour

σ

= 0 ; on suppose donc

σ

≠

0.

Désignons par f la densité de probabilité de X.

σ

2 =

(

)

x f x dx

R

−

∫

µ

2

. ( ). =

(

)

(

)

x f x dx x f x dx

x t x t

− + −

− ≤ − >

∫

∫

µ µ

µ σ µ σ

2 2

. ( ). . ( ).

≥

(

)

x f x dx

x t

−

− >

∫

µ

µ σ

2

. ( ). ≥

∫

σ>µ−

σ

tx

22

dx).x(ft

= t2σ2 P ( |X – µ| > tσ ) 1

t2σ2 P ( |X – µ| > tσ ) ≤ σ2

⇒

P ( |X – µ| > tσ ) ≤

1

2

t

Cette inégalité n’a pas d’intérêt numérique parce qu’elle est trop grossière.

Elle permet pourtant d’établir

la loi faible des grands nombres

.

___________________________

Probabilités Chapitre 10 Page 3

4 La loi faible des grands nombres.

Hypothèses et notations supplémentaires, valables seulement pour ce paragraphe :

Les X

n

sont 2 à 2 indépendantes, de même loi de probabilité,

de même espérance µ, de même variance σ

2

.

On désigne par X

n

la moyenne

X

X

X

n

n1 2

+

+

+

.

.

.

.

Rappel : X

n

a pour espérance mathématique µ et pour écart-type

σ

n

.

D’après l’inégalité de Bienaymé-Tchébycheff :

(∀ε > 0) ( P ( |X

n

– µ| > ε ) ≤

σ

ε

2

2

n

)

Cette inégalité entraîne

la convergence en probabilité de

X

n

vers la variable aléatoire certaine

µ

µµ

µ.

C’est

la

loi faible des grands nombres

.

A cause d’elle, le hasard peut avoir des manifestations

déterministes

.

On l’appelle « loi faible » par opposition à une « loi forte » selon laquelle partout sur Ω sauf peut-être sur

un ensemble de probabilité nulle : lim ( )

n

n

X

→

+∞

=ω µ.

III La convergence en loi.

Dans ce paragraphe, on désigne par Fn la fonction de répartition de Xn et par F celle de X.

1 Définition.

La suite

(

)

*

X

n

n

N

∈

de variables converge en loi vers la variable X si pour tout réel x où F est continue :

lim

(

)

nn

F

x

→+∞

= F(x).

2 Hiérarchie.

La convergence en probabilité entraîne la convergence en loi. La réciproque est fausse.

Démonstration.

Hypothèses et notations.

(

)

*

X

n

n

N

∈

converge en probabilité vers X.

x est un réel où F est continue ;

ε

est un réel strictement positif .

F étant continue en x, il existe un réel strictement positif

α

tel que : F(x +

α

) – F(x -

α

) <

ε

/2.

B

+

, B

-

, A

n

(n

∈

IN*) sont les événements ainsi définis :

B

+

= [ X

≤

x +

α

] ; B

-

= [ X

≤

x –

α

] ; A

n

= [X –

α

≤

X

n

≤

X +

α

] ; B

n

= [ X

n

≤

x ].

u

n

= P(A

n

).

___________________________

Probabilités Chapitre 10 Page 4

Séquence à compléter :

1) P( B

+

) = ; P( B

-

) = ; P( B

n

) = ;

2) pour tout événement C de Ω :

C = [C∩A

n

] ∪ [C∩A

n

] ; P(C) ≤ P(C∩A

n

) + P(C∩A

n

) ≤ P(C∩A

n

) + P(A

n

) ;

3) pour tout événement C de Ω : P(C) - ≤ P(C ∩ A

n

) ;

4) [ B

-

∩ A

n

⊂ B

n

]

⇒

[ ≤ P(B

-

∩ A

n

) ≤ P(B

n

) ] ;

5) [ B

n

∩ A

n

⊂ B

+

]

⇒

[ ≤ P(B

n

∩ A

n

) ≤ P(B

+

) ] ;

6) F(x – α) – F(x) – u

n

≤ F

n

(x) – F(x) ≤ F(x + α) – F(x) + u

n

;

7) – ε/2 – u

n

≤ ≤ ε/2 + u

n

;

8)

F x F x

n

( ) ( )−

≤ ε/2 + u

n

;

9) [

lim

nn

u

→+∞

= ]

⇒

[

(

)

(

)

∃ ∈ ∀ ∈n N n N

0

(n ≥ n

0

⇒ 0 ≤ ≤ ε/2) ] ;

10)

(

)

(

)

∃ ∈ ∀ ∈n N n N

0

(n ≥ n

0

⇒ ≤ ε) ;

11)

lim

(

)

(

)

nn

F

x

F

x

→+∞

=

.

(

)

*

X

n

n

N

∈

converge en loi vers X.

Le contre-exemple donné au paragraphe I.1 prouve que la convergence en loi n’entraîne pas la

convergence en probabilité.

La convergence en loi ne dépend que des distributions marginales

de X

n

et de X.

La convergence quadratique et la convergence en probabilité dépendent de leurs distributions

conjointes

par l’intermédiaire de la variable X

n

– X.

L’exercice 2 de la page 6 permet d’observer que la suite (X

n

)

n∈IN*

ainsi définie :

x 0 1

P(X

n

= x) 1

211

−

n 1

211

+

n

admet une limite en loi mais que, selon les cas, cette limite en loi est aussi limite en probabilité et limite

quadratique, ou n’est ni limite quadratique ni limite en probabilité.

___________________________

Probabilités Chapitre 10 Page 5

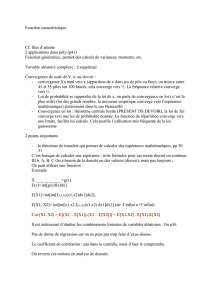

3

Exemples

.

Toutes les approximations que nous avons rencontrées sont fondées sur des convergences en loi.

Elles conservent l’espérance mathématique.

Voici un tableau qui les résume.

H

HH

H ( N, n, p ) est une loi hypergéométrique ; N est l’effectif de la population ; n est celui de l’échantillon

sans remise ; p est la probabilité de succès pour chaque individu de l’échantillon.

B

BB

B ( n, p ) est une loi binomiale ; n est l’effectif de l’échantillon avec remise ;

p est la probabilité de succès pour chaque individu de l’échantillon. q = 1-p ;

P

PP

P ( np ) est une loi de Poisson ; np est son paramètre. C’est, par exemple, le nombre moyen

d’occurrences d’un événement pendant une durée n, la fréquence moyenne étant p.

np est à la fois son espérance et sa variance.

P

PP

P ( m ) est une loi de Poisson de paramètre m (m>0) ; m est à la fois son espérance et sa variance.

N

NN

N ( np, npq ) est une loi normale d’espérance np et de variance npq.

N

NN

N ( m, m ) est une loi normale d’espérance m et de variance m.

Remarque : toutes ces chaînes d’approximations aboutissent à des lois normales.

4 Le théorème limite fondamental (théorème de Lindberg - Lévy).

Hypothèses, notations :

Les X

n

sont indépendantes, de même loi de probabilité,

de même espérance µ, de même variance σ

2

.

On désigne par X

n

la moyenne

X

X

X

n

n1 2

+

+

+

.

.

.

et par Tn la variable X

n

n

−

µ

σ.

Théorème limite fondamental (admis) :

(Tn)n∈IN* converge en loi vers une variable normale centrée réduite.

Conséquence : Quand n est grand (concrètement : n ≥ 30),

on peut approcher la loi de probabilité de X

n

par la loi normale

N

(µ,

2

n

σ

).

Le théorème limite fondamental explique l’importance des lois normales (ordinaires, habituelles, ...).

Il justifie le critère de Borel (Chapitre 7, introduction). Il justifie aussi les approximations normales de

variables binomiales ou de variables de Poisson.

H

HH

H

( N, n, p )

B

BB

B

( n, p )

P

PP

P

( m )

P

PP

P

( np )

N

NN

N

( m, m )

N

NN

N

( np, npq )

N > 10 n

n > 30

p < 0,1

np < 15

npq > 20

m > 20

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

1

/

14

100%