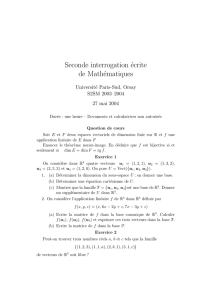

Compléments d`algèbre linéaire

Lycée Jules Ferry, Cannes Classe préparatoire TSI 2e année

Année 2016-2017 Mathématiques - D. Broizat

Chapitre 2

Compléments d’algèbre linéaire

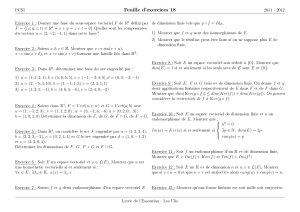

Table des matières

I Familles de vecteurs dans un espace vectoriel 1

1) Définition générale d’une famille . . . . . . . . . . . . . . . . . . . . . . 1

2) Familles génératrices d’un espace vectoriel . . . . . . . . . . . . . . . . 5

3) Familles liées, familles libres . . . . . . . . . . . . . . . . . . . . . . . . 12

4)Bases..................................... 17

5) Critère d’indépendance dans K[X]..................... 19

II Somme de sous-espaces vectoriels 24

1) Définition et structure . . . . . . . . . . . . . . . . . . . . . . . . . . . 24

2)Sommedirecte................................ 27

3) Sous-espaces supplémentaires . . . . . . . . . . . . . . . . . . . . . . . 32

III Compléments sur les applications linéaires 36

1) Action d’une appl. linéaire sur les familles de vecteurs . . . . . . . . . . 36

2) Projecteurs et symétries . . . . . . . . . . . . . . . . . . . . . . . . . . 43

3) Formes linéaires et hyperplans . . . . . . . . . . . . . . . . . . . . . . . 50

IV Changements de base 54

1)Rappels ................................... 54

2)Matricessemblables............................. 60

V Compléments sur les matrices 65

1) Base des matrices élémentaires . . . . . . . . . . . . . . . . . . . . . . . 65

2) Transposition, matrices symétriques, antisymétriques . . . . . . . . . . 67

3)Traced’unematrice............................. 72

4) Trace d’un endomorphisme . . . . . . . . . . . . . . . . . . . . . . . . . 75

1/78

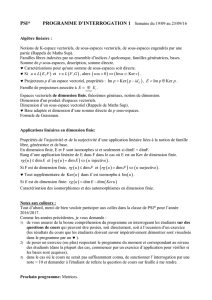

I Familles de vecteurs dans un espace vectoriel

On pose K=Rou Cet on considère un K-espace vectoriel, noté E.

1) Définition générale d’une famille

Définition 1 (Famille de vecteurs)

Une famille de vecteurs de Eindexée par un ensemble non vide I

.......................................................................

est une application x:I→E(à chaque i∈I, on associe un vecteur xi∈E).

...............................................................................

On la note (xi)i∈I, et Iest appelé ensemble des indices

......................................................... .

Attention : A la différence d’un ensemble, une famille peut contenir plusieurs fois

le même vecteur (c’est le cas si l’application xn’est pas injective).

Exemple (p-uplet)

Pour p∈N∗fixé, un p-uplet (x1, x2,··· , xp)(on dit aussi une "liste") est une famille

de vecteurs indexée par l’ensemble I={1,2,· · · , p}. Indexer par un ensemble fini I

revient à numéroter.

Exemple (Suite)

Une suite de vecteurs de E, notée (xn)n∈N, est une famille de vecteurs indexée par

I= N (ou une partie infinie de N).

2/78

Exemple (Une famille de fonctions)

On peut indexer une famille par un ensemble d’indices aussi gros que l’on veut :

par exemple, si on pose, pour tout λ∈R,fλ:x7→ eλx, on peut envisager la famille

(fλ)λ∈R(ici I= R). C’est une famille de vecteurs de l’espace vectoriel E=F(R,R)

(un espace de fonctions, donc).

Convention : Il existe une seule famille indexée par I=∅. On l’appelle famille vide.

Définition 2 (Sous-famille d’une famille de vecteurs)

Soit F= (xi)i∈Iune famille de vecteurs de E.On appelle sous-famille de F

...................................

toute famille F0de la forme F0= (xj)j∈J, où J⊂I

...................................................... .

Remarque

La famille vide est une sous-famille de n’importe quelle famille de vecteurs de E.

Définition 3 (Sur-famille)

Si Fet F0sont deux familles de vecteurs de E, alors on dit que Fest

.....................

une sur-famille de F0si F0est une sous-famille de F

............................................................

3/78

Rappel : Un ensemble Iest dit fini si il est vide ou s’il existe n∈N∗et une

.........................................

bijection entre {1,2,··· , n}et I

.....................................

Cet entier nest unique et s’appelle le cardinal de I; on le note Card(I)

..........................................

ou ]I ou encore |I|

......................., c’est le "nombre d’éléments" de I.

Définition 4 (Famille finie, cardinal d’une famille)

Une famille (xi)i∈Ide Eest dite finie si l’ensemble des indices Iest fini

.............................................................................

Dans ce cas, le cardinal de Iest appelé cardinal de la famille (xi)i∈I

...........................................................................

Remarque

La famille vide est finie, elle est de cardinal 0(et c’est la seule).

Une famille finie de cardinal n∈N∗peut toujours se réindexer par I={1,··· , n}

(ou I={0,··· , n −1}, etc.).

Attention : Le cardinal d’une famille finie n’est pas le nombre d’éléments dis-

tincts de cette famille (à la différence d’un ensemble). Par exemple, l’ensemble

{x, x, x}={x}est de cardinal 1, mais la famille (x, x, x)est de cardinal 3.

4/78

Remarque

Une famille, même finie, n’est pas nécessairement indexée par des entiers. Par exemple :

(Ra, Rb, Rc, Rd)∈E4est une famille de E de cardinal 4, indexée par l’ensemble I=

{a, b, c, d}.

Exemple

Si on considère x, y, z ∈E, et F= (x, y, y), alors F0= (x, y)est une sous-famille de

F, et F00 = (x, y, x, y, z)est une sur-famille de F.

En effet, si on pose F00 = (a1, a2, a3, a4, a5), on a

F00 = (ai)i∈I,F= (a1, a2, a4) = (ai)i∈J,F0= (a1, a2)=(ai)i∈K,

avec I={1,2,3,4,5},J={1,2,4}et K={1,2}(on a bien K⊂J⊂I).

5/78

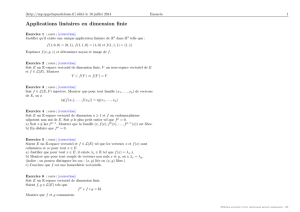

2) Familles génératrices d’un espace vectoriel

Définition 5 (Combinaison linéaire d’une famille de vecteurs)

Soit (xi)i∈Iune famille de vecteurs de E.

Une combinaison linéaire de la famille (xi)i∈Iest un vecteur x∈E

...........................................................................

de la forme x=X

j∈J

λjxj, où Jest un sous-ensemble fini de I

................................................................

et (λj)j∈Jest une famille finie de "scalaires" de K(réels ou complexes)

......................................................................... .

Convention : Une somme indexée par I=∅vaut 0E.

Donc, la seule combinaison linéaire de la famille vide est le vecteur nul 0E.

Attention : Une combinaison linéaire est toujours une somme finie : même si

la famille de vecteurs est infinie, on ne les utilise pas tous dans la combinaison !

Définition 6 (Ensemble des combinaisons linéaires d’une famille)

Soit (xi)i∈Iune famille de vecteurs de E.On note V ect((xi)i∈I)l’ensemble

....................................

des vecteurs qui sont combinaisons linéaires de la famille (xi)i∈I

.................................................................. .

6/78

Remarque

On a V ect(∅) = {0E}

.......... Si x∈E, alors V ect(x) = {λx, λ ∈K}=Kx.

........................

Proposition 7 (Engendrement d’un espace vectoriel à l’aide des C.L.)

Soit (xi)i∈Iune famille de vecteurs de E. Alors, :

(i) V ect((xi)i∈I)est un sous-espace vectoriel de E

................................................. ;

(ii) V ect((xi)i∈I)est le plus petit sous-espace vectoriel de Econtenant

..........................................................................

tous les vecteurs xi

........................

On dit que V ect((xi)i∈I)est le sous-espace engendré par (xi)i∈I

.......................................................

Preuve : Notons V=V ect((xi)i∈I).

(i) Montrons que Vest un sev de E:

•le vecteur nul 0Eest combinaison linéaire des (xi)i∈I(prendre tous les coef-

ficients nuls), donc 0E∈V.

•soit x, y ∈Vet λ∈K. Par définition de V, il existe deux sous-ensembles

finis de I, notés Jet K, et des familles finies de scalaires (αi)i∈J,(βi)i∈Ktels

que

x=X

i∈J

αixi, y =X

i∈K

βixi.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

1

/

41

100%