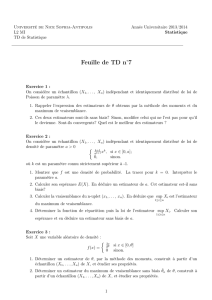

Une loi (8 points) 1 Variables Gaussiennes (12 points)

Licence MIASHS 2ème année Statistique et probabilité

Cours de Mr Rynkiewicz Université Paris 1

Interro2 B

Une loi (8 points)

On dispose d’un échantillon (X1,· · · , Xn)de taille nd’une variable aléatoire entière Xtelle que,

pour m∈N∗,i∈ {1,· · · , n}et 0≤x≤m:

P(Xi=x) = Cx

mpx(1 −p)m−x

mest une constante supposée connue et Cx

m=m!

(m−x)!x!.

1. Ecrire la vraisemblance de l’échantillon (X1,· · · , Xn). En déduire la log-vraisemblance de

l’échantillon (X1,· · · , Xn).

2. Calculer l’estimateur du maximum de vraisemblance ˆpde pen fonction de net m.

1 Variables Gaussiennes (12 points)

Soit (X1,· · · , Xn)un n-échantillon de variables gaussiennes telles que Xi∼ N (m, 1). On pose

Yi=Xi+Xi+1.

1. Pour i= 1,· · · , n−1, calculer l’espérance E(Yi)la variance V(Yi)et la covariance Cov(Yi, Yi+1).

2. Les variables Yi, i = 1,· · · , n −1sont elles identiquement distribuées ? Sont elles indépen-

dantes ?

3. On définit ¯

Y=1

n−1Pn−1

i=1 Yi, montrer que E(¯

Y) = 2met que V(¯

Y) = 4

n−1−2

(n−1)2.

4. On rappelle que toute combinaison linéaire de variables gaussienne indépendante est une

variable gaussienne. Donner la loi exacte de 1

2¯

Yen fonction de n.

5. On rappelle que si Z∼ N (0,1) alors P(|Z| ≤ 1.96) = 0.95. Donner un intervalle de confiance

à 95% pour m.

1

1

/

1

100%