Variables aléatoires , cadre continu

Chapitre 4

Variables aléatoires , cadre continu

Objectifs du chapitre

1. Introduire la notion de variable à densité.

2. Propriétés de la fonction de répartition d’une variable à densité.

3. Espérance, variance et écart type d’une variable à densité.

4. Lois usuelles de variables aléatoires à densité.

5. Couples de variables aléatoires à densité, lois jointes, indépendance.

Au chapitre précédent nous avons vu les variables aléatoires dans le cadre discret. L’univers Ωétait alors un ensemble

dénombrable et la tribu des évènements était en général l’ensemble des parties de Ω.

Dans ce chapitre nous travaillerons avec des univers non dénombrables, le plus souvent des intervalles de Rcomme [0,1]

ou des produits d’intervalles de Rcomme [0,1]×[0,1].

Si on prend Ω= [0,1]×[0,1], il n’existe pas de probabilité Pqui d’une part, attribue la même probabilité à deux

parties de [0,1]×[0,1]translatées l’une de l’autre et qui d’autre part soit telle que P([a,b]×[c,d]) soit égale à l’aire du

rectangle [a,b]×[c,d]. Ce sont pourtant des propriétés que l’on attend d’une probabilité uniforme. Par contre, une probabilité

Ppossédant ces propriétés peut être définie sur une tribu plus petite que P(Ω)appelée tribu des Boréliens. Nous l’avons

présentée au deuxième chapitre.

4.1 Variable aléatoire continue

Commençons par rappeller la définition d’une variable aléatoire.

Définition 4.1.1. On considère (Ω,A,P)un espace probabilisé. Une application

X:Ω→R

ω7→ X(ω)

est une variable aléatoire si pour tout intervalle Ide R, l’ensemble

X−1(I) = {ω∈Ω|X(ω)∈I}

est un évènement de A.

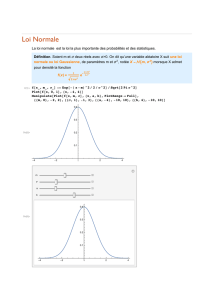

Définition 4.1.2 (Variable aléatoire continue).Soit (Ω,A,P)un espace probabilisé. Une variable aléatoire continue X est

une variable aléatoire qui n’est pas discrète : son image n’est pas une partie dénombrable de R.

Parmis les variables aléatoires continues nous allons nous intéresser aux variables aléatoires à densité.

1

4.2 Variable aléatoire à densité

Définition 4.2.1 (Variable aléatoire à densité).Soit Xune variable aléatoire définie sur un espace probabilisé (Ω,A,P).

On dit que Xest à densité si il existe une fonction continue par morceaux positive, intégrable sur Ret vérifiant pour tout

intervalle Ide R:

P(X∈I) = ZI

f(x)dx.

Par exemple :

P(X∈[a,b]) = Zb

a

f(x)dx

et

P(X∈[a,+∞[) = Z+∞

a

f(x)dx =lim

A→+∞ZA

a

f(x)dx.

Dans ce cas fest appelée densité de X.

Cas particulier à toujours vérifier

ZR

f(x)dx =P(X∈R) = 1.

Remarque 4.2.2. Si Xest une variable à densité alors la probabilité P(X=a), pour aune valeur quelconque, est nulle :

P(X=a) = P(X∈[a,a]) = Za

a

f(x)dx =0.

Exemple 4.2.3. (Loi uniforme sur [0,1]). Soit (Ω,A,P)un espace probabilisé. Une variable aléatoire Xsuit la loi uniforme

sur [0,1]si et seulement si pour tout intervalle Ide R

P(X∈I) = ZI∩[0,1]

1dx.

Intuitivement, la probabilité que Xappartienne à Iest d’autant plus grande que Iest grand.

La densité de Xest la fonction caractéristique de [0,1]notée 1[0,1].

Exemple 4.2.4 (Loi exponentielle).Soit (Ω,A,P)un espace probabilisé. Une variable aléatoire Xsuit une loi exponentielle

E(λ), si elle a pour densité de probabilité la fonction

f(x) = 0 si x<0

f(x) = λe−λxsi x≥0.

Pour tout intervalle Ide R

P(X∈I) = ZI∩R+λe−λxdx.

On vérifie que l’on a bien

P(X∈R) = Z+∞

0

λe−λxdx =lim

A→∞ZA

0

λe−λxdx =lim

A→+∞1−e−λA=1.

4.3 Fonction de répartition d’une variable aléatoire

Définition 4.3.1 (Fonction de répartition).Soit (Ω,A,P)un espace probabilisé et Xune variable aléatoire ayant une densité

fcontinue par morceaux sur Ret positive. La fonction de répartition de Xest naturellement définie pour tout x∈Rpar

F(x) = P(X≤x) = Zx

−∞

f(t)dt =lim

A→−∞Zx

A

f(t)dt.

2

Remarque 4.3.2. Pour tous réels aet bavec a<bnous avons

P(a≤X≤b) = F(b)−F(a).

Rappelons les propriétés essentielles de la fonction de répartition d’une variable aléatoire énoncées et prouvées au

chapitre précédent.

Proposition 4.3.3. Soit (Ω,A,P)un espace probabilisé. La fonction de répartition d’une variable aléatoire X a les pro-

priétés suivantes :

1. Elle est croissante.

2. Elle est continue à droite en tout point de R.

3. Elle est continue en un point x si et seulement si P(X=x) = 0.

4. Sa limite en −∞vaut 0

5. Sa limite en +∞vaut 1.

Notons que dans le cas à densité la fonction de répartition est continue car pour tout xnous avons observé ci-dessus

que P(X=x) = 0.

Dans le cas à densité la fonction de répartition a la propriété suivante

Proposition 4.3.4. Soit (Ω,A,P)un espace probabilisé. Soit X une variable aléatoire à densité f . La fonction de répartition

de la variable aléatoire X est dérivable en un point de continuité x de f et nous avons F0(x) = f(x).

Démonstration. Rappelons que la fonction densité fest continue par morceaux et positive telle que R+∞

0f(t)dt =1. Soit x0

un point de continuité de f. Montrons que FXest dérivable en x0de dérivée f(x0). Par définition il s’agit donc de montrer

que

lim

h→0

FX(x0+h)−FX(x0)

h=f(x0),

ou encore

lim

h→0[FX(x0+h)−FX(x0)] −h f (x0) = 0.

Fixons hréel, par la relation de Chasles nous avons

[Φ(x0+h)−Φ(x0)] −h f (x0) = Zx0+h

x0

f(t)dt −h f (x0) = Zx0+h

x0

[f(t)−f(x0)]dt.

On souhaite montrer que cette intégrale tend vers 0 quand htend vers 0. Ceci provient de la continuité de fen x0:

Pour ε>0 fixé, il existe ηavec 1 >η>0 tel que pour tout t∈[x0−η,x0+η]∩Ion ait |f(t)−f(x0)|≤ε.

Par conséquent pour |h|≤ηnous obtenons

[Φ(x0+h)−Φ(x0)] −h f (x0) = Zx0+h

x0

f(t)dt −h f (x0)≤Zx0+h

x0|f(t)−f(x0)|dt ≤εη ≤ε.

On obtient ainsi le résultat par définition de la limite.

Exemple 4.3.5 (Loi uniforme).La fonction de répartition d’une variable aléatoire de densité uniforme est

FX(x) =

0 si x≤0

xsi 0 ≤x≤1

1 si x≥1

.

On vérifie bien que cette fonction est dérivable en tout point x0où fest continue et qu’en un tel point F0(x0) = f(x0).

3

Exemple 4.3.6 (Loi exponentielle).La fonction de répartition d’une variable aléatoire suivant une loi exponentielle E(λ)

est

FX=0 si x≤0

1−e−λxsi x≥0.

On vérifie bien que cette fonction est dérivable en tout point x0où fest continue et qu’en un tel point F0(x0) = f(x0).

Exemple 4.3.7 (Loi d’une fonction de variable aléatoire).Soit Xune variable aléatoire admettant une densité fXet soit g

une fonction définie sur Rstrictement monotone et dérivable. La variable aléatoire Y=g(X)admet une densité fYdéfinie

par

fY(y) = fX(g−1(y))(g−1)0(y)si y∈g(R)

0 sinon

Démonstration. Par hypothèse la fonction gest bijective de Rsur g(R). Par application du théorème des valeurs intermédi-

aires g(R)est un intervalle ]α,β[de R. Supposons gstrictement croissante, le raisonnement sera analogue si gest strictement

décroissante. La dérivée de gest strictement positive. Notons que g−1est strictement croissante et dérivable à dérivée stricte-

ment positive.

Pour tout y∈]−∞,α],

P(Y≤y) = P(g(X)≤y≤α) = 0.

Pour tout y∈[β,+∞[,

P(Y≤y) = P(g(X)≤β≤y) = 1.

Dans ces deux cas fY(y) = 0.

Pour tout y∈g(R)nous avons

P(Y≤y) = P(X≤g−1(y)) = Zg−1(y)

−∞

fX(x)dx.

On effectue le changement de variable définie par x=g−1(z)et dx = (g−1)0(z)dz :

P(Y≤y) = Zy

α

fX(g−1(z))(g−1)0(z)dz =Zy

−∞

fY(z)dz,

ce qui montre bien le résultat souhaité.

4.4 Espérance d’une variable à densité

Définition 4.4.1 (Espérance).Soit (Ω,A,P)un espace probabilisé et Xvariable aléatoire à densité f. On dira que Xest de

classe L1si et seulement si la fonction x7→ |x|f(x)est intégrable sur Rc’est à dire

lim

A→−∞lim

B→+∞ZB

A|x|f(x)dx existe.

En ce cas, l’espérance de Xest définie par l’intégrale

E(X) = Z+∞

−∞

x f (x)dx.

Remarque 4.4.2. Comme dans le cas discret, l’espérance de Xpeut être vue comme la moyenne des valeurs xpondérées

par le poids infinitésimal f(x)dx. C’est pourquoi on dit aussi moyenne au lieu de l’espérance de X. Remarquons que si les

valeurs de Xsont comprises entre aet balors a≤E(X)≤b(cf théorème de transfert).

Exemple 4.4.3 (Espérance de la loi uniforme).Pour déterminer si la loi uniforme sur [0,1]a une espérance ou non et le cas

échéant la calculer, on considère l’intégrale

Z+∞

−∞|t|f(t)dt =Z1

0

tdt =1

2.

Ceci montre que la loi uniforme admet une espérance et que celle ci vaut

Z+∞

−∞

t f (t)dt =Z1

0

tdt =1

2.

4

Exemple 4.4.4 (Espérance de la loi exponentielle).Pour déterminer si la loi exponentielle de paramètre λ>0 a une espérance

ou non et le cas échéant la calculer, on considère l’intégrale

Z+∞

−∞|t|f(t)dt =lim

A→+∞ZA

0

tλe−λtdt =lim

A→+∞[−t.e−λt]A

0+ZA

0

e−λtdt=1

λ.

Ceci montre que la loi uniforme admet une espérance et que celle ci vaut

Z+∞

−∞

t f (t)dt =lim

A→+∞ZA

0

tλe−λtdt =lim

A→+∞[−t.e−λt]A

0+ZA

0

e−λtdt=1

λ.

Exemple 4.4.5 (La loi de Cauchy n’a pas d’espérance).En effet la densité d’une loi de Cauchy est la fonction f:t7→ 1

π(1+t2)

or la fonction t7→ t f (t)n’est pas intégrable au voisinage de l’infini car équivalente à la fonction t7→ 1

πt. Ceci montre que la

loi de Cauchy n’admet pas d’espérance.

On admettra le théorème suivant

Théorème 4.4.6 (Théorème de transfert).Soit X une variable aléatoire ayant une densité f et ϕ:R→Rune fonction alors

l’espérance de la variable ϕ(X)est

E(ϕ(X)) = ZR

ϕ(x)f(x)dx,

sous réserve que la fonction x 7→ |ϕ(x)|f(x)soit intégrable sur R.

Exemple 4.4.7 (Loi d’une fonction de variable aléatoire).Soit Xune variable aléatoire admettant une densité fXet soit g

une fonction définie sur Rstrictement croissante et dérivable. La fonction gest une bijection de Rsur un intervalle ]α,β[. La

variable aléatoire Y=g(X)admet une densité fYdéfinie par

fY(y) = fX(g−1(y))(g−1)0(y)si y∈g(R) =]α,β[

0 sinon

Supposons que Yest de la classe L1, par conséquent, son espérance est de la forme

E(Y) = Z∞

−∞

y fY(y)dy =Zβ

α

y fX(g−1(y))(g−1)0(y)dy.

En appliquant la formule de changement de variables avec y=g(x)nous obtenons la formule du théorème de transfert

E(Y) = Z∞

−∞

g(x)fX(x)dx.

On déduit du théorème de transfert la propriété suivante :

Proposition 4.4.8. Soit X une variable aléatoire à densité de classe L1. Pour tous réels a et b, la variable aléatoire aX +b

admet une moyenne et l’on a

E(aX +b) = aE(X) + b.

4.5 Variance et écart type d’une variable à densité

Définition 4.5.1 (Variable aléatoire à densité de classe L2).Soit (Ω,A,P)un espace probabilisé et Xvariable aléatoire de

densité f. On dira que Xest de classe L2si et seulement si X2est de classe L1c’est à dire si la fonction x7→ x2f(x)est

intégrable sur R.

Proposition 4.5.2. Si X est une variable aléatoire de classe L2, elle est aussi de classe L1.

5

6

6

7

7

8

8

9

9

10

10

11

11

1

/

11

100%