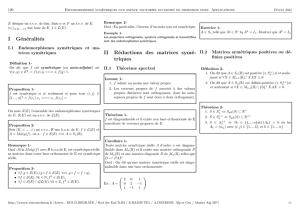

120

E, L(E)E GL (E)

E.

E, E∗E,

n= dim (E).

n≥1,Mn(R)n

GLn(R)Mn(R).

Id In

(E, h· | ·i)n≥1kxk=phx|xi

Rn

∀(x, y)∈Rn×Rn,hx|yi=tx·y=

n

X

k=1

xkyk

X E

X⊥={y∈E| ∀x∈X, hx|yi= 0}

F E {0},

F

F E

F E, E =F⊕F⊥.

Sn(R) = {A∈ Mn(R)|tA=A}n

∀A∈ Mn(R),∀(x, y)∈Rn×Rn,hAx |yi=x|tAy®

hAx |yi=t(Ax)y=txtAy =x|tAy®

A∈ Sn(R)⇔ ∀(x, y)∈Rn×Rn,hAx |yi=hx|Ayi

hAx |yi=hx|Ayix, y, hx|Ayi=hx|tAyi

h· | ·i Ay =tAy y,

A=tA.

` E, a ∈E

∀x∈E, ` (x) = hx|ai.

ϕ a ∈E ϕ (a)

∀x∈E, ϕ (a) (x) = hx|ai

h· | ·i ϕ(a)∈E∗,

h· | ·i ϕ a ϕ

hx|ai= 0 x∈E, a = 0

h· | ·i E E∗ϕ

`∈E∗a∈E ` =ϕ(a),

u∈ L(E),

u∗∈ L(E)

∀(x, y)∈E2,hu(x)|yi=hx|u∗(y)i

y∈E, x 7→ hu(x)|yi

E, u∗(y)∈Ehu(x)|yi=hx|u∗(y)ix∈E.

u∗E E

u∗. y, z E λ, µ

R, x ∈E

hu(x)|λy +µzi=λhu(x)|yi+µhu(x)|zi

=λhx|u∗(y)i+µhx|u∗(z)i

=hx|λu∗(y) + µu∗(z)i

λu∗(y) + µu∗(z) = u∗(λy +µz)u∗(λy +µz).

u∗u.

B= (ei)1≤i≤nE u

E A u∗BtA.

A= ((aij))1≤i,j≤nuB

u(ej) =

n

X

i=1

aijei(1 ≤j≤n)

i, j 1n

aij =hu(ej)|eii

A∗=¡¡a∗

ij¢¢1≤i,j≤nu∗B, i, j

1n

a∗

ij =hu∗(ej)|eii=hej|u(ei)i=aji

A∗=tA.

A= (aij)1≤i,j≤nu

i, j 1n

aij =hu(ej)|eii

aii =hu(ei)|eii

Tr (u) =

n

X

i=1 hu(ei)|eii

u

aij =aji =hu(ei)|eji

u, v L(E),

(u∗)∗=u.

(u◦v)∗=v∗◦u∗.

u∈GL (E), u∗∈GL (E) (u∗)−1= (u−1)∗.

ker (u∗) = (Im (u))⊥Im (u∗) = (ker (u))⊥.

rg (u∗) = rg (u).

u

E

x∈ker (u∗)z=u(y)∈Im (u),

hx|zi=hx|u(y)i=hu∗(x)|yi=h0|yi= 0

x∈(Im (u))⊥.ker (u∗)⊂(Im (u))⊥.

x∈(Im (u))⊥y∈E,

hu∗(x)|yi=hx|u(y)i= 0

u∗(x) = 0, x ∈ker (u∗).

ker (u∗) = (Im (u))⊥.

Im (u∗)⊂(ker (u))⊥

dim (Im (u∗)) = n−dim (ker (u∗)) = n−dim ³(Im (u))⊥´

= dim (Im (u)) = n−dim (ker (u)) = dim ³(ker (u))⊥´

Im (u∗) = (ker (u))⊥.

rg (u∗) = rg (u)

rg ( tA) = rg (A)

A.

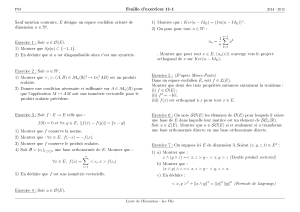

u∈ L(E)u∗=u.

S(E)E.

u∈ S (E)⇔u∗=u⇔ ∀(x, y)∈E2,hu(x)|yi=hx|u(y)i

S(E).

u∈ L(E)

E

BE u ∈ L(E), A

B.

u u∗=utA=A A ∈ Sn(R).

A∈ Sn(R), X x ∈EB,

x, y E

hu(x)|yi=t(AX)Y=tXtAY =tX(AY ) = hx|u(y)i

u∈ S (E).

A∈ Sn(R), u

S(Rn).

S(E)L(E)n(n+ 1)

2.

S(E)L(E)

Sn(R)u7→ A, A u

E

Sn(R)Mn(R)

n(n+ 1)

2, ϕ :Sn(R)→Rn(n+1)

2

∀A= ((aij))1≤i,j≤n∈ Sn(R), ϕ (A) = (aij)1≤i≤j≤n

(Eij)1≤i,j≤nMn(R)

Eij = ((δipδqj))1≤p,q≤n

δrs

A=X

1≤i,j≤n

aijEij =

n

X

i=1

aiiEii +X

1≤i<j≤n

(aijEij +ajiEji)

=

n

X

i=1

1

2aii (2Eii) + X

1≤i<j≤n

aij (Eij +Eji)

(Eij +Eji)1≤i≤j≤nSn(R).

dim (Sn(R)) = card (Eij +Eji)1≤i≤j≤n=n(n+ 1)

2.Sn(R)

n(n+ 1)

2.

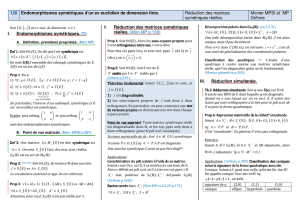

u∈ S (E), u +u∗, u∗u uu∗

S(E).hu∗ux |xi=ku(x)k2huu∗(x)|xi=ku∗(x)k2,

u∗u uu∗S+(E)

u∈ S (E), up∈ S (E)p v∗◦u◦v∈ S (E)

v∈ L(E).

A=µ1 1

1 2 ¶B=µ1 2

2 1 ¶S2(R)AB =µ3 3

5 4 ¶/∈ S2(R).

A=µa b

b c ¶A0=µa0b0

b0c0¶S2(R),

(1,2) (2,1) AA0b12 =ab0+bc0b21 =a0b+b0c

b12 6=b21.

u, v E,

u◦v u v

u, v

u◦v

u, v u ◦v x, y

E, hu◦v(x)|yi=hx|u◦v(y)i,hv(x)|u(y)i=hu(x)|v(y)i,

hu◦v(x)|yi=hv◦u(x)|yiu◦v(x) = v◦u(x)x∈Rn,

u◦v=v◦u.

u∈ S (E).ker (u) Im (u)

E= ker (u)⊥

⊕Im (u)

x∈ker (u)z=u(y)∈Im (u),

hx|zi=hx|u(y)i=hu(x)|yi=h0|yi= 0

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

1

/

22

100%