Méthodes numériques ST L 2 S4 Dr. MAMERI A. Dép. GM, FSSA, ULBM

1

Université Larbi Ben MHIDI Oum El Bouaghi

Faculté des Sciences et Sciences Appliquées pole Ain Beida

Département de Génie Mécanique

Premier cours en :

Méthodes Numériques

Conforme au programme de la 2eme année ST.

Par : Dr. MAMERI Abdelbaki

Méthodes numériques ST L 2 S4 Dr. MAMERI A. Dép. GM, FSSA, ULBM

2

Programme Méthodes numériques

Chapitre 1 : Résolution des équations non linéaires f(x)=0

1. Introduction générale,

2. Méthode de bissection,

3. Méthode des approximations successives (point fixe),

4. Méthode de Newton-Raphson.

Chapitre 2 : Interpolation polynomiale

1. Introduction générale,

2. Polynôme de Lagrange,

3. Polynômes de Newton.

Chapitre 3 : Intégration numérique

1. Introduction générale,

2. Méthode du trapèze,

3. Méthode de Simpson,

4. Formules de quadrature.

Chapitre 4 : Résolution des équations différentielles ordinaires (problème de la

condition initiale ou de Cauchy).

1. Introduction générale,

2. Méthode d’Euler,

3. Méthode d’Euler améliorée,

4. Méthode de Runge-Kutta d’ordre quatre.

Chapitre 5 : Méthode de résolution directe des systèmes d’équations linéaires

1. Introduction et définitions,

2. Méthode de Gauss et pivotation,

3. Méthode de factorisation LU,

4. Méthode de factorisation de Choeleski MMt,

5. Algorithme de Thomas (TDMA) pour les systèmes tri diagonales.

Chapitre 6 : Méthode de résolution approximative des systèmes d’équations

linaires

1. Introduction et définitions,

2. Méthode de Jacobi,

3. Méthode de Gauss-Seidel,

4. Utilisation de la relaxation.

Méthodes numériques ST L 2 S4 Dr. MAMERI A. Dép. GM, FSSA, ULBM

3

Chapitre I : Résolution numérique des équations non

linéaires à une seule variable

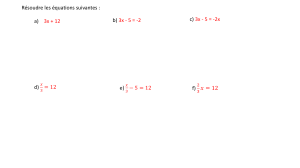

Dans ce chapitre on va étudier trois méthodes pour la résolution des équations

non linéaires à une variable aussi dites équations à variable transcendante. Comme

exemple de ces équations, on peut citer . Ces

équations ne possèdent pas une ou des racines exactes qui peuvent être calculées

directement, c’est pourquoi on fait recours aux méthodes numériques pour trouver

les solutions approchées de ces équations. Les racines calculées sont autant précises

que l’on veut surtout lorsqu’on dispose des moyens de calcul.

Ces méthodes numériques permettent seulement le calcul d’une seule racine

sur un intervalle bien choisi. Donc si l’équation possède plus d’une racine, il est

nécessaire de les localiser dans des intervalles choisis soigneusement et de faire le

calcul pour chaque racine à part.

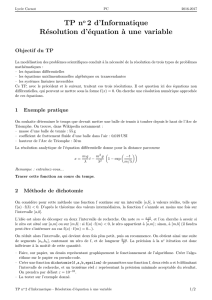

1 Localisation des racines d’une équation f(x)=0.

Soit une équation f(x)=0 dont on cherche la solution sur un intervalle [a,b], on

commence par un tracé grossier de la fonction sur l’intervalle donnée puis on isole

chaque racine dans un sous intervalle le plus étroit possible. La Fig. 1 montre le tracé

d’une fonction f qui coupe l’axe des x en trois points , c’est-à-dire que l’équation

f(x)=0 possède trois racines, on note les racines exates par

.

-2 -1 0123

-2

-1

0

1

2

3

a'

3

x

2

x

1

x

abb' a'' b''

f(x)

x

Fig. 1.1. Localisation des racines

Méthodes numériques ST L 2 S4 Dr. MAMERI A. Dép. GM, FSSA, ULBM

4

On remarque que la fonction est continue sur chaque sous intervalle, aussi chaque

sous intervalle :

• Englobe une seule racine tel que

.

• Vérifie la condition .

La forme de l’équation f(x)=0 peut etre compliquée, dans ce cas s’il est possible on

peut la décomposer en deux parties simples g(x)=h(x).

Par exemple , qui est assez compliqué pour le tracé, peut

être décomposée en :

Le tracé de g et h est très simple, la solution de f(x)=0 se situe à l’intersection de g

et h. Ensuite, on projete les points des intersection sur l’axe des x et on localise les

racines. On peut facilement vérifier les intervalles trouvées en calculant .

Exemple :

Prenons l’équation : localisant ses racines, à ce point on ne connait

pas le nombre de racines de cette équation. On trace la courbe de la fonction :

, les intersections de la courbe avec l’axe des x représentent

les racines de cette fonction.

0.0 0.5 1.0 1.5 2.0

-2

-1

0

1

2

2

x

f(x)

x

1

x

0.0 0.5 1.0 1.5 2.0

-2

-1

0

1

2

2

x

f(x)

x

1

x

f1(x)=ln(x)

f2(x)=x2-2

Fig. 1.2. Tracé de la fonction f Fig. 1.3. Tracés des fonction f1 et f2

On note que cette équations a deux racines (Fig. 2) qui appartiennent par exemple

aux intervalles [0.1,0.5] et [1,2]. On peut aussi rééerire la fonction f(x)=0 sous une

forme plus simple, par exemple : ou bien

Méthodes numériques ST L 2 S4 Dr. MAMERI A. Dép. GM, FSSA, ULBM

5

; avec et . Ensuite on trace ces deux fonctions

(Fig. 3), qui sont faciles sur les même axes, leurs intersections représentent les

racines de f(x)=0.

2 Méthode de bissection où de dichothomie

C’est la méthode la plus simple et qui nécessite le plus de calculs, elle est basée

sur le cas particulier (Théorème de Bolzano) du théorème des valeurs intermédiaires

qui dit que :

1. Si f(x) est continue sur l’intervalle [a,b],

2. Si f(a) et f(b) ne sont pas de même signe, il existe au moins un réel c compris

entre a et b tel que f(c) = 0 (car 0 est compris entre f(a) et f(b)).

2.1 Principe de la méthode

Une fois les racines sont localisées chacune dans un intervalle, pour

simplifier l’écriture soit par exemple [a,b] :

1. On divise l’intervalle en deux parties égales tel que

.

2. On obtient deux sous intervalles [a, ] et [ ,b] , la racine doit

obligatoirement appartenir à l’un d’eux. Pour vérifier, on calcule

et le produit qui est négatif c’est celui qui

correspond à l’intervalle qui contient la solution.

Notons le nouvel intervalle par tel que (Fig. 4):

012

-2

-1

0

1

2

3

b3- a3

b2- a2

b4

a4

a2

x

a1b1b2

a3b3

f(x)

x

x1x2

x3

b1- a1

Fig. 1.4. Illustration de la méthode de bissection

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

1

/

41

100%