Notes de cours - CPGE Dupuy de Lôme

Chapitre 11 : Produit scalaire – Notes de cours. - 1 -

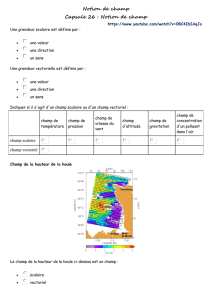

Produit scalaire.

Chapitre 11 : notes de cours.

Projections orthogonales.

• Projecteur orthogonal

• Supplémentaire orthogonal d’un sous-espace vectoriel de dimension finie, et expression de la projection

orthogonale sur un sous-espace vectoriel de dimension finie

• Distance d’un vecteur à un sous-espace vectoriel de dimension finie

• Inégalité de Bessel

Espaces euclidiens.

• Caractérisation matricielle des bases orthogonales ou orthonormales

• Expression matricielle du produit scalaire

• Représentation d’une forme linéaire à l’aide du produit scalaire, vecteur normal à un hyperplan d’un

espace euclidien

Automorphismes orthogonaux et matrices orthogonales.

• Endomorphisme orthogonal dans un espace vectoriel euclidien

• Bijectivité des endomorphismes orthogonaux en dimension finie, automorphismes orthogonaux

(isométries) et caractérisations des automorphismes orthogonaux, groupe (O(E),o)

• Matrice orthogonale, caractérisation des matrices orthogonales par leurs vecteurs lignes ou colonnes,

groupe (O(n),×)

• Automorphisme orthogonal et sous-espaces stables

• Isométries positives et négatives d’un espace vectoriel euclidien, groupes (SO(E),o) et (SO(n),×)

• Matrice de passage entre bases orthonormales

Réduction des endomorphismes symétriques, des matrices symétriques réelles.

• Endomorphisme symétrique

• Caractérisation matricielle des endomorphismes symétriques

• Valeurs propres d’une matrice symétrique réelle, d’un endomorphisme symétrique

• Orthogonalité des espaces propres d’un endomorphisme symétrique

• Théorème spectral : diagonalisabilité des endomorphismes symétriques

• Diagonalisabilité des matrices symétriques réelles

Espaces euclidiens de dimension 2 ou 3.

• Orientation d’un espace vectoriel, orientation induite par un sous-espace vectoriel, produit mixte

• Produit vectoriel de deux vecteurs en dimension 3, propriétés du produit vectoriel, expression du produit

vectoriel dans une base orthonormale directe, expression géométrique du produit vectoriel

• Eléments de O(2) : matrices orthogonales 2×2

• Automorphismes orthogonaux d’un espace vectoriel euclidien de dimension 2

• Produit de rotations, commutativité de SO(2) et SO(E), pour E de dimension 2

• Automorphismes orthogonaux d’un espace vectoriel euclidien de dimension 3

• Eléments de O(3) : matrices orthogonales 3×3

Chapitre 11 : Produit scalaire – Notes de cours. - 2 -

Produit scalaire.

Chapitre 11 : notes de cours.

Projections orthogonales.

Théorème 3.2 : expression de la projection orthogonale sur un sous-espace vectoriel de dimension

finie

Soit (E, (.|.)) un espace préhilbertien réel de dimension finie ou non.

Soit F un sous-espace vectoriel de E de dimension finie m.

Soit (e

1

, …, e

m

) une base orthonormale de F et p

F

la projection orthogonale de E sur F.

Alors pour tout vecteur x de E, on a :

∑

=

=m

iiiF exexp 1.)()(

.

Définition 3.2 et théorème 3.3 : distance d’un vecteur à un sous-espace vectoriel de dimension finie

Soit (E, (.|.)) un espace préhilbertien réel de dimension finie ou non et

.

la norme associée.

Soit F un sous-espace vectoriel de E de dimension finie m.

Pour un vecteur x de E, on appelle distance de x à F, notée

),( Fxd

, la quantité :

zxFxd

Fz

−=

∈

inf),(

.

Cette valeur est atteinte en un unique vecteur de F qui est

)(xp

F, la projection orthogonale de x sur F.

On a donc :

)(),( xpxFxd

F

−=

.

Exemple : calculer la projection puis la distance d’un vecteur de

4

à un hyperplan au choix

Soit H l’hyperplan de

4

(muni de son produit scalaire canonique) défini par l’équation :

0

=

+

+

+

tzyx

.

On peut proposer comme base orthogonale de H la famille (1,0,-1,0), (1,-2,1,0) et (1,1,1,-3).

Donc :

)0,1,0,1.(

2

1−=u

,

)0,1,2,1.(

6

1−=v

,

)3,1,1,1.(

3.2

1−=w

, forment une base orthonormale de H.

Le vecteur :

)4,3,2,1(

=

a

, a alors pour projection orthogonale sur H le vecteur :

)

2

3

,

2

1

,

2

1

,

2

3

().12321.(

3.2

1

).341.(

6

1

).31.(

2

1

)(' −−=−++++−+−== wvuapa

H

.

On peut remarquer qu’on a bien : a’ ∈ H, et : (a – a’) ∈ H

⊥

, puisque :

)

2

5

,

2

5

,

2

5

,

2

5

('=−aa

.

Enfin :

5)1,1,1,1(.

2

5

2

5

,

2

5

,

2

5

,

2

5

')(),( ==

=−=−= aaapaHad

H

.

Théorème 3.4 : inégalité de Bessel

Soit (E, (.|.)) un espace préhilbertien réel de dimension finie ou non et

.

la norme associée.

Soit F un sous-espace vectoriel de E de dimension finie m.

Soit (e

1

, …, e

m

) une base orthonormale de F.

Pour tout vecteur x de E, on a :

2

1

2

)( xxe

m

ii

≤

∑

=

.

Espaces euclidiens.

Théorème 4.3 : caractérisation matricielle des bases orthogonales ou orthonormales

Soit (E, (.|.)) un espace vectoriel euclidien de dimension n.

Soit : B = (e

i

), une base de E.

On note M la matrice du produit scalaire dans la base (e

i

) définie par : ∀ 1 ≤ i,j ≤ n,

)(

,

jiji

eem =

.

La matrice M est symétrique.

On a de plus les équivalences suivantes :

• (B est orthogonale) ⇔ (M est diagonale),

• (B est orthonormale) ⇔ (M = I

n

).

Chapitre 11 : Produit scalaire – Notes de cours. - 3 -

Théorème 4.4 : expression matricielle du produit scalaire

Soit (E, (.|.)) un espace vectoriel euclidien de dimension n.

Soit : B = (e

i

), une base de E.

Soient x et y des vecteurs de E, et X et Y les matrices colonnes de leurs coordonnées dans B.

Alors :

YMXyx

t

..)( =

.

Si B est orthonormale, on a de plus :

•

∑

=

== n

iii

tyxYXyx 1..)(

(forme canonique d’un produit scalaire dans une base orthonormale),

•

∑

=

=n

iii exex 1).(

,

•

∑∑ == == n

ii

n

iixexx 1

2

1

2

2)(

.

Théorèmes 4.7 et 4.8 : représentation d’une forme linéaire à l’aide du produit scalaire, vecteur

normal à un hyperplan

Soit (E, (.|.)) un espace vectoriel euclidien de dimension n.

Soit ϕ* une forme linéaire sur E.

Alors il existe un unique vecteur : a ∈ E, tel que : ∀ x ∈ E,

)()(* xax =

ϕ

.

De plus si H est un hyperplan de E, et : B = (e

1

, …, e

n

), une base orthonormale de E, alors une

équation de H dans B fournit un vecteur orthogonal à H, dit aussi vecteur normal à H.

Exemple :

Dans

4

muni de son produit scalaire canonique, le vecteur (1,1,1,1) est un vecteur normal à l’hyperplan H dont

une équation dans la base canonique de

4

est :

0

=

+

+

+

tzyx

.

Automorphismes orthogonaux et matrices orthogonales.

Définition 5.1, théorèmes 5.1 et 5.2 : endomorphisme orthogonal dans un espace vectoriel euclidien

Soit (E, (.|.)) un espace vectoriel euclidien,

.

la norme associée et : u ∈ L(E).

• On dit que u est un endomorphisme orthogonal de E si et seulement si u conserve la norme ou le

produit scalaire de E, c'est-à-dire : ∀ (x,y) ∈ E

2

,

)())()(( yxyuxu =

, ou : ∀ x ∈ E,

xxu =)(

.

Ces deux définitions sont bien équivalentes.

• Un endomorphisme orthogonal est bijectif et on parle d’automorphisme orthogonal.

• Les seules valeurs propres possibles d’un endomorphisme orthogonal sont ±1.

Définition 5.2 et théorème 5.3 : matrice orthogonale, caractérisation par les lignes ou les colonnes

Soit : n ≥ 1.

• On dit que : A ∈ M

n

(), est une matrice orthogonale si et seulement si :

n

t

IAA =.

, ou :

n

t

IAA =.

.

• Une matrice A de M

n

() est orthogonale si et seulement si ses colonnes, considérées comme des

vecteurs de

n

(ou ses lignes) forment une base orthonormale de

n

, pour le produit scalaire canonique

de

n

.

• Si : A ∈ M

n

(), est orthogonale, alors :

1)det(

±

=

A

(pas de réciproque).

Théorème 5.4 : caractérisations des automorphismes orthogonaux

Soit (E, (.|.)) un espace vectoriel euclidien,

.

la norme associée et : u ∈ L(E).

• u est un automorphisme orthogonal si et seulement si sa matrice dans une base orthonormale de E est

une matrice orthogonale.

• u est un automorphisme orthogonal si et seulement si l’image d’une base orthonormale de E par u est

une autre base orthonormale.

Théorème 5.5 : automorphisme orthogonal et sous-espaces vectoriels stables

Soit (E, (.|.)) un espace vectoriel euclidien.

Soient u un automorphisme orthogonal de E et F un sous-espace vectoriel de E, stable par u.

Chapitre 11 : Produit scalaire – Notes de cours. - 4 -

Alors F

⊥

est également stable par u.

Théorème 5.6 et définition 5.3 : les groupes (O(E),o), (O(n),

×

), (SO(E),o) et (SO(n),

×

)

Soit (E, (.|.)) un espace vectoriel euclidien de dimension n et

.

la norme associée.

• Alors l’ensemble des automorphismes orthogonaux de E, noté O(E), forme un groupe pour la loi o,

appelé groupe orthogonal de E et sous-groupe de (Gl(E),o).

• De même, l’ensemble O(n) des matrices orthogonales de M

n

(), forme un groupe pour la loi ×,

appelé groupe orthogonal d’ordre n, et sous-groupe de (Gl(n),×).

• Par ailleurs, les éléments de O(E) dont le déterminant vaut 1 forment un sous-groupe de O(E) appelé

Groupe spécial orthogonal de E, de même les matrices de O(n) dont le déterminant vaut 1 forment un

sous-groupe de O(n) appelé groupe spécial orthogonal d’ordre n.

• Enfin, si on fixe une base B de E, orthonormale, l’application de L(E) dans M

n

(), qui à un

endomorphisme u associe sa matrice dans la base B, induit un isomorphisme de groupes de (O(E),o)

dans (O(n),×).

Définition 5.4 : isométries d’un espace vectoriel euclidien, isométries positives et négatives

Soit (E, (.|.)) un espace vectoriel euclidien de dimension n et

.

la norme associée.

• Un automorphisme orthogonal de E est encore appelé isométrie de E.

• si u est orthogonal, alors :

1)det(

±

=

u

.

On dira que u est une isométrie positive de E si :

1)det(

+

=

u

, et négative de E si :

1)det(

−

=

u

.

Théorème 5.7 : matrice de passage entre bases orthonormales

Soit (E, (.|.)) un espace vectoriel euclidien et

.

la norme associée.

Soit B une base orthonormale de E et B’ une autre base de E.

Si on note P la matrice de passage de B à B’, alors B’ est orthonormale si et seulement si P est

orthogonale.

Réduction des endomorphismes symétriques, des matrices symétriques réelles.

Définition 7.1 et théorème 7.1 : endomorphisme symétrique et caractérisation matricielle

Soit (E, (.|.)) un espace vectoriel euclidien.

• On dit qu’un endomorphisme u de E est symétrique lorsque : ∀ (x,y) ∈ E

2

,

))(())(( yuxyxu =

.

• Un endomorphisme u de E est symétrique si et seulement si sa matrice représentative dans toute base

orthonormale de E est symétrique.

Théorème 7.2 : valeurs propres d’une matrice symétrique réelle, d’un endomorphisme symétrique

• Soit : A ∈ M

n

(), une matrice symétrique réelle, avec : n ≥ 1.

Alors A, considérée comme élément de M

n

(), est telle que toutes les racines de son polynôme

caractéristique sont réelles et donc a toutes ses valeurs propres réelles.

• De même, soit (E, (.|.)) un espace vectoriel euclidien, et soit : u ∈ L(E), symétrique.

Toutes les racines du polynôme caractéristique de u sont réelles.

Théorèmes 7.3 et 7.4 : (dit théorème spectral) diagonalisabilité des endomorphismes symétriques

Soit (E, (.|.)) un espace vectoriel euclidien, et soit : u ∈ L(E), symétrique.

• Si λ et µ sont des valeurs propres distinctes de u, les espaces propres associés E

λ

(u) et E

µ

(u) sont

orthogonaux.

• Il existe une base orthonormale de E dans laquelle l’endomorphisme u est diagonalisable.

• E est la somme directe orthogonale des sous-espaces propres de u.

Théorème 7.5 : diagonalisabilité des matrices symétriques réelles

Soit : A ∈ M

n

(), une matrice symétrique réelle, avec : n ≥ 1.

Alors A est diagonalisable et il est possible de la diagonaliser par l’intermédiaire d’une matrice

orthogonale.

Chapitre 11 : Produit scalaire – Notes de cours. - 5 -

Exemple : diagonaliser une matrice symétrique réelle 3

×

3 et constater les propriétés annoncées

Soit A la matrice :

=211

121

112

A

.

Les valeurs propres de A (obtenues par exemple avec χ

A

) sont 1 (valeur propre double) et 4 (simple).

L’espace propre associé à 1 est le plan de

3

d’équation :

0

=

+

+

zyx

, qui admet pour base orthonormale :

(e

1

, e

2

) = (

)0,1,1.(

2

1−

,

)2,1,1.(

6

1−

).

L’espace propre associé à 4 est la droite de

3

engendrée par : e

3

=

)1,1,1.(

3

1

.

Ces deux espaces propres sont bien supplémentaires orthogonaux pour le produit scalaire canonique de

3

.

De plus si on pose :

−

−=

3

1

6

2

0

3

1

6

1

2

13

1

6

1

2

1

P

, alors P est orthogonale (comme matrice de passage entre bases

orthonormales, de la base canonique de

3

à (e

1

,e

2

,e

3

)) et :

===

−

400

010

001

....

1

DPAPPAP

t

.

Remarque : si on pose :

−

−= 120

111

111

Q

, Q n’est pas orthogonale mais on a tout de même :

DQAQ =

−

.

1

.

Espaces euclidiens de dimension 2 ou 3.

Dans ce paragraphe, E désigne un espace euclidien de dimension 2 ou 3.

Définition 6.1 : orientation d’un espace vectoriel, orientation induite par un sous-espace vectoriel

• Une orientation de E correspond au choix d’une base de E décrétée comme directe.

Toute base de E est alors soit directe, soit indirecte, suivant que le déterminant de la matrice de

passage de cette nouvelle base à la base de référence est positif ou négatif.

• Si F est un sous-espace vectoriel de E (un plan ou une droite), orienter F permet alors de définir une

orientation induite dans tout sous-espace supplémentaire de F dans E de la façon suivante :

si B

F

est une base directe de F, une base d’un supplémentaire G de F sera directe si la concaténation

de B

F

et de B

G

est une base directe de E.

Exemple :

Soit

3

muni de son produit scalaire canonique et de son orientation canonique (la base canonique est directe).

Soit : ∆ = Vect(e

1

), avec : e

1

= (1,1,1)), et muni de l’orientation donnée par ce vecteur.

Alors : Π = Vect(e

2

,e

3

), où : (e

2

,e

3

) = ((1,1,0), (1,0,1)), est un supplémentaire de ∆ dans

3

(puisque la réunion des

deux bases de Π et de ∆ forme une base de

3

), et (e

2

,e

3

) est une base indirecte de Π dans l’orientation induite par

∆ car la matrice de passage P de la base canonique à (e

1

,e

2

,e

3

) vérifie :

1

001

111

011

101

011

111

)det( −=−==P

.

Remarques :

• Si on prend au départ une base orthonormale comme base directe et qu’on examine les autres bases

orthonormales de E, alors le déterminant de la matrice de passage vaut toujours ±1.

• Orienter une droite (dans le plan ou l’espace) correspond donc à la donnée d’un vecteur de norme 1.

• Orienter un plan dans

3

revient alors à choisir une base orthonormale du plan comme base directe,

6

6

7

7

8

8

1

/

8

100%

![[ alg bre ] 2011/2012 Oran 2eme devoir surveill ( 2eme ann e )](http://s1.studylibfr.com/store/data/008146156_1-20a7ad0fb2ddca5a298d6770aaecdd81-300x300.png)