Algèbre linéaire et bilinéaire – Notes de cours Cycle préparatoire 2 année

Cycle préparatoire 2ème année

Algèbre linéaire et bilinéaire – Notes de cours

Romain Dujol

2013 – 2014

Table des matières

0 Révisions d’algèbre linéaire 4

0.1 Espaces vectoriels . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 4

0.2 Sous-espace vectoriel . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 5

0.2.1 Somme de deux sous-espaces vectoriels . . . . . . . . . . . . . . . . . . . . . . . . . . 5

0.2.2 Famille de vecteurs . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 6

0.2.3 Espace vectoriel de dimension finie . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 7

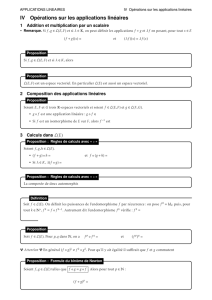

0.3 Applications linéaires . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 9

0.3.1 Application linéaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 9

0.3.2 Sous-espaces particuliers . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 9

Exercices . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 10

1 Réduction des endomorphismes 12

1.1 Élements propres . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 12

1.1.1 Valeur propre. Vecteur propre . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 12

1.1.2 Sous-espace propre . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 13

1.2 Polynôme caractéristique . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 14

1.2.1 Définition . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 14

1.2.2 Propriétés . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 15

1.3 Réduction des endomorphismes . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 16

1.3.1 Diagonalisation . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 16

1.3.2 Trigonalisation . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 18

Exercices . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 20

2 Réduction des endomorphismes, techniques avancées 22

2.1 Polynôme annulateur . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 22

2.1.1 Polynôme d’endomorphisme . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 22

2.1.2 Polynôme annulateur. Polynôme minimal . . . . . . . . . . . . . . . . . . . . . . . . . 25

2.2 Sous-espaces caractéristiques. Forme de JORDAN . . . . . . . . . . . . . . . . . . . . . . . . . 28

2.2.1 Sous-espace caractéristique . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 28

2.2.2 Forme de JORDAN . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 29

Exercices . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 31

Romain Dujol

1

3 Réduction des endomorphismes, applications 32

3.1 Puissances entières d’une matrice . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 32

3.1.1 Méthode par réduction d’endomorphisme . . . . . . . . . . . . . . . . . . . . . . . . 32

3.1.2 Méthode par division euclidienne . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 33

3.2 Suites récurrentes linéaires . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 34

3.2.1 Suites vectorielles récurrentes d’ordre un . . . . . . . . . . . . . . . . . . . . . . . . . 34

3.2.2 Suites récurrentes linéaires d’ordre supérieur . . . . . . . . . . . . . . . . . . . . . . 35

3.3 Systèmes différentiels linéaires . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 36

3.3.1 Méthode par réduction directe . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 36

3.3.2 Méthode par exponentielle . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 36

Exercices . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 39

4 Formes bilinéaires. Formes quadratiques 40

4.1 Forme bilinéaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 40

4.1.1 Définitions . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 40

4.1.2 Orthogonalité . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 42

4.1.3 Matrice d’une forme bilinéaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 43

4.2 Forme quadratique . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 46

4.2.1 Définitions . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 46

4.2.2 Orthogonalité . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 47

4.2.3 Matrice d’une forme quadratique . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 49

4.2.4 Réduction d’une forme quadratique . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 50

Exercices . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 54

5 Espaces euclidiens 58

5.1 Produit scalaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 58

5.1.1 Définition . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 58

5.1.2 Exemples fondamentaux . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 59

5.2 Orthogonalité . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 60

5.2.1 Définitions . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 60

5.2.2 Familles orthogonales . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 60

5.2.3 Procédé d’orthonormalisation de SCHMIDT . . . . . . . . . . . . . . . . . . . . . . . . 63

5.3 Théorème de projection . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 65

Exercices . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 68

6 Endomorphismes remarquables d’un espace euclidien 70

6.1 Endomorphismes orthogonaux. Matrices orthogonales . . . . . . . . . . . . . . . . . . . . 70

6.1.1 Endomorphismes orthogonaux . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 70

6.1.2 Matrices orthogonales . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 72

6.2 Endomorphismes autoadjoints . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 73

6.2.1 Adjoint d’un endomorphisme . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 73

Romain Dujol

2

6.2.2 Endomorphisme autoadjoint . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 74

6.2.3 Endomorphisme anti-autoadjoint . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 75

Exercices . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 76

7 Espaces préhilbertiens complexes 78

7.1 Forme sesquilinéaire. Produit scalaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 78

7.1.1 Forme sesquilinéaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 78

7.1.2 Forme sesquilinéaire hermitienne . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 79

7.1.3 Forme quadratique hermitienne . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 79

7.1.4 Produit scalaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 80

7.2 Endomorphismes remarquables d’un espace hermitien . . . . . . . . . . . . . . . . . . . . 81

7.2.1 Endomorphismes unitaires . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 81

7.2.2 Endomorphismes hermitiens et anti-hermitiens . . . . . . . . . . . . . . . . . . . . 81

7.3 Matrices remarquables . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 82

7.3.1 Matrice d’une forme sesquilinéaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 82

7.3.2 Matrices unitaires . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 82

7.3.3 Matrices hermitiennes et anti-hermitiennes . . . . . . . . . . . . . . . . . . . . . . . 82

Exercices . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 84

Romain Dujol

3

Chapitre 0

Révisions d’algèbre linéaire

0.1 Espaces vectoriels

Définition 0.1 (Espace vectoriel). Soit Kun corps commutatif. Un espace vectoriel sur Kou

K-espace vectoriel est un ensemble E muni :

– d’une loi de composition interne +telle que (E,+) est un groupe abélien ;

– d’une loi de composition externe ·:K×E→E

(λ,x)7→ λ·x

telle que :

1. ∀x∈E, 1K·x=x

2. ∀λ∈K,∀µ∈K,∀x∈E,λ·(µ·x) = (λµ)·x

3. ∀λ∈K,∀µ∈K,∀x∈E,(λ+µ)·x=λ·x+µ·x

4. ∀λ∈K,∀x∈E,∀y∈E,λ·(x+y) = λ·x+λ·y

Les éléments de E sont appelés des vecteurs. Les éléments de Ksont appelés des scalaires.

Remarque. Les propriétés 1 et 2 indiquent que ·est une action à gauche du groupe Ksur E.

Proposition 0.1. Soit Kun corps commutatif et E un K-espace vectoriel. Alors :

1. ∀λ∈K,λ·0E=0E

2. ∀x∈E, 0K·x=0E

3. ∀x∈E,(−1K)·x=−x

Proposition 0.2 (Exemples fondamentaux). Soit n un entier naturel non nul.

1. L’ensemble Kn=K×···×K(n fois) des n-uplets à valeurs dans Kest un K-espace vectoriel.

2. L’ensemble K[X]des polynômes à coefficients dans Kest un K-espace vectoriel

Romain Dujol

4

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

62

62

63

63

64

64

65

65

66

66

67

67

68

68

69

69

70

70

71

71

72

72

73

73

74

74

75

75

76

76

77

77

78

78

79

79

80

80

81

81

82

82

83

83

84

84

85

85

86

86

1

/

86

100%