Lois de probabilité usuelles 1 Variables aléatoires

Lois de probabilité usuelles

1 Variables aléatoires

Soit Ωl’univers d’une expérience aléatoire muni de la probabilité P.

Définition 1.1 (Variable aléatoire) Une variable aléatoire définie sur Ωassocie à chaque

issue, une valeur numérique. Les variables aléatoires que nous étudierons sont des applications

(des fonctions) de Ωdans R.

Par exemple, au jeu de pile ou face, on peut décider qu’obtenir pile rapporte 1 e, alors

qu’obtenir face fait perdre 1 e. On définit alors la variable aléatoire Xpar : X(pile) = 1 et

X(face) = −1, qui donne le gain en euros en fonction du résultat de l’expérience aléatoire.

Définitions et notations 1.2 ({X6x}, Fonction de répartition) Soit Xune variable

aléatoire définie sur Ω. L’ensemble des éléments de Ωdont l’image par Xest inférieure ou

égale au nombre réel xse note : {X6x}, et cet ensemble est un événement. La probabilité de

cet événement se note : P(X6x). La fonction de répartition de la variable aléatoire Xest la

fonction FX(parfois notée simplement : F) définie sur Rpar :

FX(x) = P(X6x).

2 Variables aléatoires discrètes

Définition 2.1 (Variable aléatoire discrète) Soit X: Ω →Rune variable aléatoire. On

dit que Xest une variable aléatoire discrète s’il n’y a pas plus d’images par Xque d’éléments

dans N.

Notations 2.2 ({X=xi},P(X=xi))Soit Xune variable aléatoire discrète. Soit {xi∈R|

i∈I}, avec I⊂N, l’ensemble des images par Xdes éléments de Ω. Pour tout idans I,

l’ensemble des antécédents de xipar X:{ω∈Ω|X(ω) = xi}est l’événement noté : {X=xi}.

La probabilité de l’événement {X=xi}se note : P(X=xi).

Définition 2.3 (Loi de probabilité d’une variable aléatoire discrète) Soit Xune va-

riable aléatoire discrète. Soit {xi∈R|i∈I}, avec I⊂N, l’ensemble des images par Xdes

éléments de Ω. La loi de probabilité de Xest l’ensemble des couples : (xi, P (X=xi)) pour

i∈I.

Définition et notation 2.4 (Espérance) Soit Xune variable aléatoire discrète prenant les

valeurs 1xi, pour i∈I⊂N. Dans le cas où In’est pas une partie finie de N, on exige

1. L’ensemble des images des éléments de Ωpar Xest : {xi∈R|i∈I⊂N}.

1

22 VARIABLES ALÉATOIRES DISCRÈTES

que Pi∈IP(X=xi)|xi|soit une série numérique convergente 2. L’espérance (ou : l’espérance

mathématique, ou encore : la moyenne) de la variable aléatoire Xse note E(X)et est définie

par :

E(X) = X

i∈I

P(X=xi)xi.

Que représente l’espérance d’une variable aléatoire? Pour tenter de cerner la signification de

l’espérance d’une variable, le théorème suivant (admis) sera d’un grand secours.

Théorème 2.1 (Loi faible des grands nombres) Soit n∈N r {0}. On considère une

même expérience aléatoire réalisée nfois dans les mêmes conditions. Soit Ωl’univers de l’ex-

périence aléatoire, et Pla probabilité dont Ωest muni. Soit X: Ω →Rune variable aléatoire

ayant pour espérance m. Pour k∈N∩[1, n], notons Xkla variable aléatoire égale à Xet

associée à la k-ième réalisation de l’expérience aléatoire.

Dans ces conditions, la suite des variables aléatoires Xn=1

nPn

k=1 Xkconverge en probabilité

vers m; c’est à dire, pour tout ε > 0,lim

n→+∞PXn−m6ε= 1.

Ce théorème indique que pour nassez grand, il est presque certain que Xnprend la valeur

m. En d’autres termes, on retrouve l’idée intuitive que plus l’expérience aléatoire est répétée

de façon identique, plus la moyenne des valeurs prises par Xlors de chaque répétition de

l’expérience se stabilise autour de l’espérance (appelée également : moyenne) de X. Ainsi,

en reprenant l’exemple figurant en page 1 du jeu de pile ou face, on a : E(X) = P(X=

−1) ·(−1) + P(X= 1) ·1 = −0,5 + 0,5 = 0 ; le “gain moyen par partie” est nul. Ce jeu de pile

ou face entre donc dans la catégorie des jeux équitables.

Définition et notation 2.5 (Variance) Soit Xune variable aléatoire discrète d’espérance

E(X)∈R, et prenant les valeurs xi,i∈I⊂N. Dans le cas où In’est pas une partie finie de

N, on exige que Pi∈IP(X=xi)x2

iconverge 3. La variance de X, notée V(X)ou σ2(X), est

définie par :

V(X) = X

i∈I

P(X=xi) (xi−E(X))2=EX2−(E(X))2.

Définition et notation 2.6 (Écart-type) Soit Xune variable aléatoire discrète de variance

V(X)∈R+. L’écart-type de X, notée σ(X), est défini par :

σ(X) = pV(X).

On rencontre parfois les notations σXou σpour l’écart-type.

Théorème 2.2 Avec les conditions de la définition 2.5, on a :

V(X) = X

i∈I

P(X=xi)x2

i−(E(X))2.

Définitions 2.7 (Variable aléatoire centrée, réduite) Soit Xune variable aléatoire dis-

crète. Si E(X) = 0, alors on dit que Xest une variable aléatoire centrée. Si σ(X) = 1, alors

on dit que Xest une variable aléatoire réduite. Si E(X) = 0 et σ(X) = 1, alors on dit que X

est une variable aléatoire centrée réduite.

2. Nous n’aurons, dans la pratique, pas à nous préoccuper d’étudier cette convergence. Cette contrainte

n’est présente dans la définition que pour que le cas : Iinfini, ne soit pas laissé de côté. Cette préoccupation

théorique ne devrait pas apparaître dans un sujet d’examen.

3. Voir la note 2

DUT Génie Biologique Année universitaire 2007/2008

3

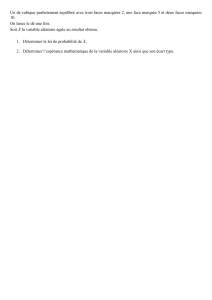

Exercice 2.1 Le jeu consiste à lancer simultanément deux dés à six faces numérotées de un à six.

Pour n’importe lequel des deux dés, toutes les faces ont la même probabilité d’être obtenues. Le

résultat du lancé est la somme des nombres apparus sur la face supérieure de chacun des dés.

La mise initiale d’un joueur est de αe.

Si le joueur obtient 2, 3, 4, 5 ou 6, alors il perd sa mise.

Si le joueur obtient 7 ou 8, alors il touche 9 e.

Si le joueur obtient un résultat supérieur ou égal à 9, alors il touche 18 e.

On note Xla variable aléatoire qui à chaque résultat de lancé associe la somme versée au joueur.

1. À l’aide d’un tableau à doubles entrées, déterminer quel est l’événement élémentaire le plus

probable (celui qui a la plus forte probabilité).

2. Que représente E(X)?

3. Quel doit être le montant de la mise pour que le jeu soit équitable? (Jeu équitable : espoir de

gain nul.)

3 Loi de Bernoulli

Définition 3.1 (Épreuve de Bernoulli) Une épreuve de Bernoulli est un épreuve à deux

issues, souvent appelées : « succès » et « échec ».

On suppose que la probabilité de l’événement : « un succès a été obtenu » vaut p; et donc, la

probabilité de l’événement contraire : « un échec a été obtenu » vaut q= 1 −p.

Définition et notation 3.2 (Loi de Bernoulli B(p))On considère une épreuve de Ber-

noulli. On suppose que la probabilité de l’événement : « un succès a été obtenu » vaut p;

et donc, la probabilité de l’événement contraire : « un échec a été obtenu » vaut q= 1 −p. Soit

Xla variable aléatoire qui associe la valeur 1à « un succès a été obtenu » et la valeur 0à

« un échec a été obtenu ». La variable aléatoire Xsuit alors la loi de Bernoulli de paramètre

p. Cette loi est notée : B(p).

Théorème 3.1 (Espérance) Soit Xune variable aléatoire suivant la loi de Bernoulli B(p).

On a : E(X) = p.

Théorème 3.2 (Variance) Soit Xune variable aléatoire suivant la loi de Bernoulli B(p).

On a : V(X) = p(1 −p).

4 Loi binomiale

Définition 4.1 (Schéma de Bernoulli) On considère une épreuve de Bernoulli. On effec-

tue, dans les mêmes conditions, nfois de suite cette épreuve (n∈N r {0}). Les nrépétitions

de l’épreuve sont indépendantes les unes des autres.

À quoi ressemble l’univers du schéma de Bernoulli décrit ci-dessus ? L’univers Ωest ici un

ensemble de n-uplets. Pour simplifier le problème supposons que l’expérience soit répétée trois

fois. « succès » est représenté par aet « échec » par b. Dans ce cas,

Ω = {(a, a, a),(a, a, b),(a, b, a),(b, a, a),(a, b, b),(b, a, b),(b, b, a),(b, b, b)}.

La notation (a, a, b)signifie que lors de la première expérience aléatoire, le résultat obtenu fut :

a, lors de la seconde, le résultat fut : a, et lors de la troisième, le résultat fut : b. Supposons

T. Cuesta IUT de Créteil

44 LOI BINOMIALE

que la probabilité d’obtenir asoit égale à pet que la probabilité d’obtenir bsoit égale à q.

Comme il n’y a que deux issues, on a : q= 1 −p. Les trois événements A: « le résultat

de la première épreuve est a», B: « le résultat de la deuxième épreuve est a» et C: « le

résultat de la troisième épreuve est b» sont indépendants. On en déduit que P({(a, a, b)}) =

P(A∩B∩C) = P(A)P(B)P(C) = pp(1 −p) = p2(1 −p). Comme il y a autant de triplets où a

apparaît deux fois que de sous-ensembles à deux éléments dans un ensemble à trois éléments,

on obtient que la probabilité d’obtenir exactement deux fois le résultat alorsque l’expérience

aléatoire est répétée trois fois vaut : 3

2p2(1 −p).

Théorème 4.1 On considère une épreuve ayant deux issues : aet b. La probabilité d’obtenir a

comme résultat de l’expérience aléatoire est p. La probabilité d’obtenir best q= 1−p. On répète

nfois cette épreuve dans les conditions du schéma de Bernoulli. Soit Xla variable aléatoire

comptabilisant le nombre de réalisations de {a}au cours des nrépétitions de l’épreuve. On a

alors, pour tout entier naturel 4k:

P(X=k) = n

kpk(1 −p)n−k.

Démonstration 4.1 La probabilité d’obtenir alors des kpremières répétitions de l’épreuve, puis blors des

n−ksuivantes est, puisque les répétitions sont indépendantes les unes des autres, pk(1 −p)n−k. Comme

il y a autant de n-uplets où aapparaît exactement kfois que de sous-ensembles à kéléments dans un

ensemble à néléments, on en déduit le théorème.

Définition et notation 4.2 (Loi binomiale B(n, p))La variable aléatoire Xdu théorème

4.1 a pour loi de probabilité la loi binomiale de paramètres net p. Le premier paramètre : n, est

le nombre de répétitions de l’épreuve à deux issues ; le second paramètre : p, est la probabilité

d’obtenir acomme résultat de l’épreuve à deux issues. La loi binomiale de paramètres net p

se note : B(n, p).

Théorème 4.2 (Espérance) L’espérance de la variable aléatoire X, suivant la loi binomiale

B(n, p), est :

E(X) = np.

Démonstration 4.2 Par définition, on a :

E(X) =

n

X

k=0

kn

kpk(1 −p)n−k=

n

X

k=1

kn

kpk(1 −p)n−k.

Or, pour k6= 0 (et donc n6= 0),

kn

k=kn!

k!(n−k)! =n(n−1)!

(k−1)!(n−1−(k−1))! =nn−1

k−1.

On en déduit :

E(X) =np

n

X

k=1 n−1

k−1pk−1(1 −p)n−1−(k−1)

=np

n−1

X

i=0 n−1

ipi(1 −p)n−1−i=np(p+ 1 −p)n−1=np.

4. On rappelle que si k > n, alors n

k= 0.

DUT Génie Biologique Année universitaire 2007/2008

5

Théorème 4.3 (Variance) La variance 5de la variable aléatoire X, suivant la loi de proba-

bilité B(n, p), est :

V(X) = np(1 −p).

Démonstration 4.3 La variance de Xest donnée 6par :

V(X) =

n

X

k=0

k2Ck

npk(1 −p)n−k−(E(X))2=

n

X

k=1

k2Ck

npk(1 −p)n−k−(np)2.

D’après la démonstration 4.2, on a :

n

X

k=1

k2Ck

npk(1 −p)n−k=np

n

X

k=1

kCk−1

n−1pk−1(1 −p)n−1−(k−1)

=np

n−1

X

i=0

(i+ 1)Ci

n−1pi(1 −p)n−1−i

=np n−1

X

i=0

iCi

n−1pi(1 −p)n−1−i+

n−1

X

i=0

Ci

n−1pi(1 −p)n−1−i!

=np (n−1)p+ (p+ (1 −p))n−1

=np(np −p+ 1) = (np)2+np(1 −p)

D’où : V(X) = np(1 −p).

Exercice 4.1 BTS Comptabilité gestion, session 2000, exercice 2

Dans une entreprise, un stage de formation à l’utilisation d’un nouveau logiciel de gestion a été suivi

par 25 % du personnel. Ainsi la probabilité qu’une personne choisie au hasard dans l’entreprise ait

suivi ce stage est p= 0,25.

Les parties A et B peuvent être traitées de façon indépendante.

Partie A

On choisit au hasard npersonnes de cette entreprise. On suppose que l’effectif est suffisamment

important pour assimiler ce choix à un tirage avec remise.

1. Dans cette question, n= 10.

On note Xla variable aléatoire qui, à tout ensemble de 10 personnes ainsi choisies, associe le

nombre de personnes ayant suivi le stage.

(a) Expliquer pourquoi Xsuit une loi binomiale. Indiquer les paramètres de cette loi.

(b) Déterminer, à 10−2près, la probabilité des événements suivants :

E1: « Parmi 10 personnes choisies au hasard, exactement 2 personnes ont suivi le stage » ;

E2: « Parmi 10 personnes choisies au hasard, au plus une personne a suivi le stage ».

2. Dans cette question, n= 500.

On note Yla variable aléatoire qui, à tout ensemble de 500 personnes choisies, associe le nombre

de personnes ayant suivi le stage. On admet que la variable aléatoire Ysuit la loi binomiale de

paramètres n= 500 et p= 0,25.

(a) Déterminer l’espérance mathématique de la variable aléatoire Y.

En donner une interprétation.

Déterminer une valeur approchée, arrondie à 10−1près, de l’écart-type de la variable

aléatoire Y.

5. La variance de la variable aléatoire Xsuivant la loi B(n, p)n’est pas donnée dans le formulaire ; c’est

l’écart-type qui est donné par σ(X) = √npq, avec q= 1 −p.

6. On rappelle que Ck

n=n

k.

T. Cuesta IUT de Créteil

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

1

/

19

100%