Cours

2.

COMPARAISON DE

DEUX GROUPES

•Il existe des tests spécifiques pour

•comparer des proportions

•comparer des moyennes

•Données par paires ou non

•Nécessite éventuellement de comparer

préalablement les variances

•Des conditions d’applications doivent être respectées

pour réaliser les tests

•2 échantillons aléatoires simples indépendants (pas

de correspondances entre les valeurs des 2

groupes)

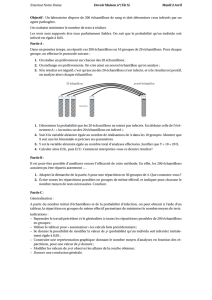

•Pour chaque groupe d’effectif ni on a xi succès, et

donc une proportion pi = xi/ni

•Test de l’hypothèse nulle p1 = p2

•Condition : xi et (ni - xi) ≥ 5

•On peut avoir à calculer les xi à partir de pi et ni

Comparaison de 2 proportions

•Estimation combinée de p1 et p2, notée p̄

•p̄ = (x1 + x2)/(n1 + n2)

•et q̄ = 1 - p̄

•Calcul de la statistique test z

•z = (p1 - p2)/√(p̄.q̄/n1 + p̄.q̄/n2)

•Sous H0, z suit une loi Normale (table de Student

avec un nombre infini ("grand") de ddl)

•On peut calculer l’intervalle de confiance de p1 - p2

•Quand il ne s’agit pas de proportions :

•2 groupes d’observations indépendantes : 2 échantillons

pouvant être

•Indépendants

•Appariés

•H0 : Les 2 groupes sont issus de la même population,

avec donc la même moyenne

•2 étapes :

•Comparaison des variances

•Comparaison des moyennes

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

1

/

28

100%