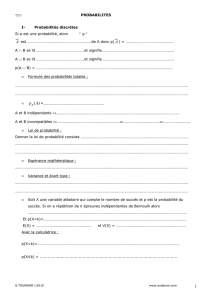

A et B

Probabilités :

axiomes et formules

Cours ‘ Interprétation de la preuve ’

(3b)

Peut-on se passer de calculs de probabilités en

sciences forensiques ?

La réponse est claire : non, pour deux raisons.

Le calcul des probabilités a des applications directes

(il suffit de citer la génétique des populations).

(1) C’est la base théorique nécessaire au scientifique

qui, dans l’estimation, identifie des modèles

probabilistes et,

(2) dans les tests, en compare plusieurs pour en choisir

un.

La notion de probabilité

La vision fréquentiste repose sur la loi des grands nombres,

établie pour la première fois par J. Bernoulli en 1713, fournit

une définition ‘pratique’ de la notion de probabilité.

Une seule expérience ne suffisant pas pour évaluer la

probabilité d’un événement on va répéter un très grand nombre

de fois l’expérience.

Cette loi stipule que si on répète un grand nombre nde fois une

épreuve, la fréquence favec laquelle on observe la survenue

d’un événement tend (quand nginfini) vers une limite qui est

définie comme probabilité de cet événement.

Ainsi du lancer d’un dé :la probabilité d ’observer la face 6 est

la limite du rapport no. de 6 obtenus / no. d ’essais = f

La notion de probabilité : un exemple

Par exemple, en lançant un nombre nde fois une

pièce ‘parfaite’ de monnaie, la fréquence fde ’pile’

tendra vers 1/2 au fur et à mesure que n

augmentera.

Dessiner l’exemple

La notion de probabilité : un exemple

N. tosses N. heads in n tosses Frequency

10 6 0.60000

100 52 0.52000

1000 463 0.46300

10000 4908 0.49080

100000 49573 0.49573

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

1

/

36

100%