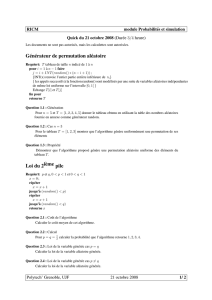

ECS 922. Convergence et approximation de lois

ECS 922. Convergence et approximation de lois

I Convergence en probabilit´e

1. In´egalit´e de Markov

Th´eor`eme :

Si Xest une variable al´eatoire discr`ete ou `a densit´e qui admet un moment d’ordre 2, alors :

∀ε > 0, P (|X|>ε)6E(X2)

ε2

Id´ee de la d´emonstration :

Cas d’une variable discr`ete :X(Ω) = {xi/i ∈I}o`u Iest un intervalle de Z.

Posons J={i∈I/ |xi|>ε}et remarquons que P(|X|>ε) = X

i∈J

P(X=xi).

E(X2) = X

i∈I

x2

iP(X=xi)>X

i∈J

x2

iP(X=xi)>X

i∈J

ε2P(X=xi) = ε2P(|X|>ε)

d’o`u l’in´egalit´e de Markov.

Cas d’une variable `a densit´e : Soit fune densit´e de X.

E(X2) = Z+∞

−∞

t2f(t) dt=Z−ε

−∞

t2f(t) dt+Z+ε

−ε

t2f(t) dt+Z+∞

ε

t2f(t) dt

donc E(X2)>Z−ε

−∞

t2f(t) dt+Z+∞

ε

t2f(t) dt>Z−ε

−∞

ε2f(t) dt+Z+∞

ε

ε2f(t) dt

ou encore E(X2)>ε2P¡(X6−ε)∪(X>ε)¢=ε2P(|X|>ε)

d’o`u l’in´egalit´e de Markov.

2. In´egalit´e de Bienaym´e-Tchebychev

Th´eor`eme :

Si Xest une variable al´eatoire qui admet une variance :

∀ε > 0, P (|X−E(X)|>ε)6V(X)

ε2

ou encore:

∀ε > 0, P (|X−E(X)|< ε)>1−V(X)

ε2

Id´ee de la d´emonstration : On obtient la premi`ere in´egalit´e en appliquant l’in´egalit´e de Markov

`a la variable al´eatoire X−E(X). La seconde s’en d´eduit par passage `a l’´ev´enement contraire.

3. Convergence en probabilit´e

D´efinition :

Soit (Xn)n>1une suite de variables al´eatoires sur (Ω,A, P ) et Xune variable al´eatoire sur

(Ω,A, P ).

On dit que la suite (Xn) converge en probabilit´e vers Xet on note Xn−→

PXsi :

∀ε > 0,lim

n→+∞P(|Xn−X|>ε) = 0

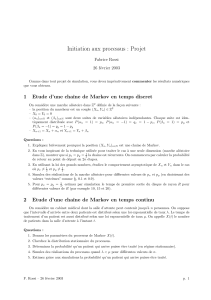

4. Loi faible des grands nombres.

Proposition : (Loi faible des grands nombres.)

Soit (Xn)n∈Nune suite de variables al´eatoires ind´ependantes admettant toutes une mˆeme

esp´erance met une mˆeme variance σ2. Alors, la suite (Xn) d´efinie par Xn=1

n

n

X

i=1

Xiconverge

en probabilit´e vers la variable certaine ´egale `a m.

Autrement dit : ∀ε > 0 lim

n→+∞P(m−ε61

n

n

X

i=1

Xi6m+ε) = 1

Id´ee de la d´emonstration : On applique l’in´egalit´e de Bienaym´e-Tchebychev `a la variable al´eatoire

Xndont l’esp´erance est met la variance 1

nσ2.

Exemple important: Si les Xisuivent la loi de Bernoulli de param`etre pet sont ind´ependantes,

on a:

lim

n→∞ Pﯯ¯¯

1

n

n

X

i=1

Xi−p¯¯¯¯¯

6ε!= 1

ce qui justifie la notion intuitive de probabilit´e : hhla probabilit´e d’un ´ev´enement est la limite de

sa fr´equence lorsque l’on r´ep`ete ind´efiniment l’exp´erience al´eatoire ii .

II Convergence en loi.

1. D´efinition et caract´erisations

On va noter syst´ematiquement FTla fonction de r´epartition d’une variable al´eatoire T.

D´efinition : On dit qu’une suite (Xn) de variables al´eatoires converge en loi vers une variable

al´eatoire Xsi:

pour tout r´eel xen lequel FXest continue, lim

n→∞ FXn(x) = FX(x)

Th´eor`eme : La suite (Xn)n∈N∗converge en loi vers Xsi et seulement si: quel que soit l’intervalle

Ide Rdont chacune des bornes finies est un point de continuit´e de FX,

lim

n→+∞P(Xn∈I) = P(X∈I)

Corollaire(Convergence en loi d’une suite de variables al´eatoires `a valeurs dans N.)

Soit (Xn) une suite de variables al´eatoires `a valeurs dans N(ceci signifie que, pour tout entier

naturel n,Xn(Ω) ⊂N).

Soit Xune variable al´eatoire `a valeurs dans N.

La suite (Xn) converge en loi vers Xsi et seulement si

∀k∈Nlim

n→∞ P(Xn=k) = P(X=k)

2. Convergence de la loi binomiale vers la loi de Poisson.

Proposition : Soit λ∈R∗

+. Soit (Xn)n>λ une suite de variables al´eatoires telles que Xn→

B(n, λ/n). Alors, la suite (Xn) converge en loi vers une variable al´eatoire Xsuivant la loi P(λ).

Remarque : Xnet Xont mˆeme esp´erance.

Id´ee de la d´emonstration : L’essentiel est de ne pas perdre de vue que λet ksont fixes et que

c’est nqui tend vers l’infini. Pour tout entier naturel k, on a pour tout n>k:

P(Xn=k) = ¡n

k¢µλ

n¶kµ1−λ

n¶n−k

=λk

k!

n(n−1) . . . (n−k+ 1)

nk

1

(1 −λ

n)kµ1−λ

n¶n

mais n(n−1) . . . (n−k+ 1) ∼

n→∞ nk

et lim

n→∞(1 −λ

n)k) = 1 et ln µµ1−λ

n¶n¶=nln(1 −λ

n)∼

n→∞ n(−λ

n) = −λ

donc lim

n→∞ P(Xn=k) = e−λλk

k!, ce qu’il fallait d´emontrer.

Application `a l’approximation d’une loi binomiale par une loi de Poisson.

On consid`ere que si n>30, p60.1 et np < 15, on peut faire l’approximation de la loi B(n, p)

par la loi P(np).

2

Ceci signifie que si X → B(n, p), et si Y → P(np), on a, pour tout entier naturel k:

P(X=k)'P(Y=k).

3. Exercice : Convergence de la loi hyperg´eom´etrique vers la loi binomiale.

Proposition : Soit p∈]0,1[ et n∈N∗. Soit (Ni) une suite strictement croissante d’entiers naturels

telle que : ∀i∈NNi.p ∈N.

Soit (Xi) une suite de variables al´eatoires telles que, pour tout i:Xi→ H(Ni, n, p)

Alors, la suite (Xi) converge en loi vers une variable al´eatoire Xsuivant la loi B(n, p).

Remarque : Xnet Xont mˆeme esp´erance.

Id´ee de la d´emonstration : Mˆeme principe que la pr´ec´edente. Soit kun entier naturel. Notons N

au lieu de Ni.P(Xi=k) = ³N p

k´³N q

n−k´

³N

n´s’´ecrit aussi:

P(Xi=k) = n!

k!(n−k)!

˙

((Np)(Np −1) ···(N p −k+ 1)][(Nq)(Nq −1) ···(Nq −n+k+ 1)]

N(N−1) ···(N−n+ 1)

qui a pour limite ¡n

k¢pkqn−k.

Application `a l’approximation d’une loi hyperg´eom´etrique par une loi binomiale.

On consid`ere que si N>10n, on peut faire l’approximation de la loi H(N, n, p) par la loi B(n, p).

Ceci signifie que si X → H(N, n, p), et si Y → B(n, p), on a, pour tout entier naturel k:

P(X=k)'P(Y=k).

4. Th´eor`eme de la limite centr´ee.

Th´eor`eme : (admis)

Si (Xn) est une suite de variables al´eatoires ind´ependantes et de mˆeme loi de probabilit´e qui

admettent une esp´erance et une variance, alors la variable centr´ee r´eduite S∗

nassoci´ee `a

Sn=

n

X

k=1

Xk

converge en loi vers une variable suivant la loi normale centr´ee r´eduite.

Cela signifie que, si a < b : lim

n→+∞P(a6S∗

n6b) = Zb

a

1

√2πexp(−t2

2) dt.

5. Exercice : Convergence de la loi binomiale vers la loi normale

Proposition : Soit p∈]0,1[, fix´e. Soit (Sn)n∈N∗une suite de variables al´eatoires telle que, pour

tout entier naturel n,Sn→ B(n, p). Alors, la suite (S∗

n) des variables centr´ees r´eduites associ´ees

aux Snconverge en loi vers une variable suivant la loi normale centr´ee r´eduite.

Id´ee de la d´emonstration : Consid´erons une suite (Xn) de variables ind´ependantes sur (Ω,B, P )

suivant toutes la loi de Bernoulli de param`etre p.Sn=X1+··· +Xnv´erifie les hypoth`eses de

ce th´eor`eme et on peut appliquer `a la suite (Xn) le th´eor`eme de la limite centr´ee, qui donne la

conclusion.

Application `a l’approximation de loi binomiale par la loi normale.

On consid`ere que si n>30, np >15 et npq > 5, on peut faire l’approximation de la loi B(n, p)

par la loi N(np, npq). Plus pr´ecis´ement, si X → B(n, p) et Y → N(np, npq),

P(X=k)'

P(k−0.5< Y 6k+ 0.5) si k∈[[1, n −1]]

P(Y60.5) si k= 0

P(Y > n −0.5) si k=n

Remarque : Xet Yont mˆeme esp´erance et mˆeme variance.

3

1

/

3

100%