Analyse en Composantes Principales Laboratoire d`Analyse

Yannick Mavita Mukwanga

Laboratoire d’Analyse – Recherche en Economie Quantitative

92

Analyse en Composantes Principales

Laboratoire

d’

Analyse

–

Recherche

en

Economie Quantitative

One Pager

Décembre 2013

Vol. 8 – Num. 010

Copyright © Laréq 2013

http://www.lareq.com

Analyse en Composantes Principales

Yannick Mavita Mukwanga

« Pour les meilleurs ou les pires, les mathématiques sont devenues l’outil privilégié de

l’analyse économique contemporaine. »

Carl P. Simon & Lawrence Blume

Résumé

Ce papier présente un outil de l’analyse multivariée, l’analyse en composantes principales. Pour

ce faire, il nous a paru impérieux de rappeler certaines notions mathématiques, notamment le

vecteur et la matrice, avant de procéder à l’exposé de la méthode en cause.

Mots – clé : vecteur, matrice, analyse en composantes principales

Abstract

This paper focuses on the study of principal component analysis. So, first, we recall the

concepts of vectors and matrices, and then proceed to the presentation of the method PCA.

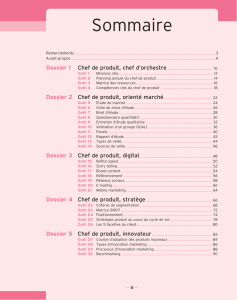

Introduction

Résumer l’information pour une série de données permet à un analyste de passer du complexe au simple

et de fournir une interprétation plus plausible. C’est sous cet angle que l’Analyse en composantes

principales (ACP), s’insérant parmi les méthodes de la statistique multivariée, consiste à transformer des

variables liées entre elles en nouvelles variables décorrélées les unes des autres [composantes

principales ou axes principaux]. Cette approche permet ainsi de réduire le nombre de variables et de

rendre la présentation de l’information plus aisée.

En parallèle, il y a lieu de noter que la méthode ACP est intrinsèquement l’œuvre de Karl Pearson. Elle a

été présentée dès 1901 dans un article portant sur la recherche de la « droite du meilleur ajustement ».

Dans ce cadre, l’auteur s’est, notamment, proposé de décrire et de résumer l’information contenue dans

les variables, et non à chercher l’explication d’une variable par d’autres comme dans la régression.

Toutefois, il sied de noter que le développement et la formalisation de l’ACP sont attribués à l’économiste

et statisticien américain Harold Hotelling, d’où le nom de la transformée de Hotelling.

Etant donné que le but de ce papier est de proposer une présentation plus simplifiée de l’ACP, la

structure suivante a été retenue, la section première s’attèle à l’analyse des éléments de calculs vectoriel

et matriciel, et la section deuxième, à l’exposé de la méthode ACP.

Yannick Mavita Mukwanga

Laboratoire d’Analyse – Recherche en Economie Quantitative

93

I. Eléments de calculs vectoriel et matriciel

Cette section rappelle quelques concepts basiques et fondamentaux sur les calculs vectoriel et matriciel.

Pour une présentation plus rigoureuse, nous désignons Tombola et Tsasa (2013).

Par définition, un vecteur est un segment de droite orienté, appartenant dans un espace à dimensions.

Pour deux dimensions, l’espace se confond au plan. Et l’ensemble de tous les vecteurs forme l’espace

vectoriel E1.

Quatre éléments classiques caractérisent généralisent un vecteur, à noter :

le point d’application : l’origine du vecteur ;

la direction : le support du vecteur ;

le sens : généralement indiqué par une flèche lors de la représentation graphique du vecteur ;

le module : la longueur du vecteur. On l’appelle également intensité, norme. Il est noté

pour un vecteurconsidéré, et se calcule comme suit.

=

où = (x1, x2, …, xn)

Pour une norme égale à l’unité,, le vecteur est dit unitaire.

Note : tout vecteur peut devenir unitaire en divisant seulement chacune de ses composantes par sa

norme

Quelques opérations dans un espace vectoriel E

) E2 E (loi interne)

(, K X E, E (loi externe)

Propriétés ou règles de calcul dans espace vectoriel E

E

K , . 0 = 0

K et E

K et (v, u) E2

(, ) K2 et E ,

Notion de la distance

Soit deux points A(x1, X2, …, xn) et B(y1, y2, …, yn), la distance entre ces deux points est donnée par :

Trois propriétés gouvernent la notion de la distance :

d(A, B) = d(B, A), la symétrie;

d(A, A) = , la distance d’un point vers un même point est nulle ;

d(A, B) d(A, C) + d(B, C), l’inégalité triangulaire.

1 Voir une définition plus rigoureuse dans Tombola – Tsasa (2013, p. 95).

Yannick Mavita Mukwanga

Laboratoire d’Analyse – Recherche en Economie Quantitative

94

Intéressons – nous à présent à l’analyse matricielle. Une matrice est un tableau rectangulaire de

nombres, formé de lignes et colonnes. Le format (m, n) indique la dimension de la matrice et

est l’élément de la matrice située à l’intersection de ligne et de la colonne.

Ainsi, une matrice à m lignes et n colonnes, à coefficients dans un corps K est toute application de [1, m]

X [1, n] dans K.

De manière générale, on peut noter une telle matrice nommée A comme suit :

A =

Vecteur ligne et vecteur colonne, si m = 1 la matrice A devient un vecteur ligne et si n = 1 la matrice

A devient un vecteur colonne [cette forme du vecteur sera largement utilisée dans la méthode ACP].1

Li = et Cj =

désignent respectivement le vecteur ligne et le vecteur colonne.

Matrice carrée, si m = n, la matrice A devient une matrice carrée et appelée matrice d’ordre n.

A =

où a11, a22, … , ann sont coefficients diagonaux de A.

Matrice diagonale, on appelle une matrice diagonale une matrice carrée dont tous les éléments non

diagonaux sont nuls. C’est – à – dire

A =

Matrice identité, on appelle une matrice identité d’ordre n une matrice diagonale dont tous les

éléments diagonaux sont égaux à l’unité.

In =

Matrice symétrique, on appelle une matrice symétrique une matrice carrée dont les éléments sont égaux

deux à deux perpendiculairement par rapport à la diagonale principale.

A =

Opérations sur les matrices

Transposition de la matrice, soit une matrice A de dimension on appelle transposée de A la matrice

notée At de dimension 2

Addition matricielle, tout d’abord, on doit retenir qu’on ne peut additionner que deux matrices de même

dimension. Et pour additionner deux matrices A et B, on additionne les éléments de mêmes indices.

Propriété: l’addition matricielle est commutative [A + B = B + A].

1 Cette définition du vecteur montre que la notion du vecteur est un cas particulier de la matrice.

2 La transposition implique de manière plus simple que les lignes de A deviennent les colonnes de At et les

colonnes des lignes.

Yannick Mavita Mukwanga

Laboratoire d’Analyse – Recherche en Economie Quantitative

95

Multiplication d’une matrice par un scalaire, pour multiplier une matrice par un scalaire, on multiplie

chaque élément de la matrice par ce scalaire.

Soit A, une matrice de dimension

Multiplication deux matrices, ce produit n’est possible que si le nombre de colonnes de la première

matrice [A (m, n)] est égal au nombre de lignes de la deuxième matrice [B (p, r)].

.

Propriété : le produit matriciel est non commutatif.

Valeurs et vecteurs propres d’une matrice carrée

Valeur propre. Soient A une matrice carrée, In, une matrice identité et un paramètre réel. On appelle

valeur propre , le zéro du polynôme caractéristique noté :

.

Vecteur propre. On appelle vecteur propre associé à la valeur propre , le vecteur E tel que :

.

Note : à une valeur propre est liée une famille de vecteurs propres.

II. Exposition de la méthode de l’ACP

Pourquoi ce choix sur l’ACP ?

Historiquement, l’ACP est la première méthode d’analyse des données. Et par ailleurs, à ce jour, ,

l’analyse des données utilise principalement les méthodes d’analyse factorielle. Celles – ci consistent à

réduire les données initiales afin de les représenter graphiquement dans un espace à faibles dimensions

[généralement deux]. Parmi ces méthodes, on peut aussi citer l’analyse factorielle des correspondances

[AFC], la classification automatique, l’analyse discriminante.

Le recours à ces méthodes est venu de la déception lors de l’utilisation de la statistique descriptive

traditionnelle [moyenne, écart – type, etc.] qui livre une description sommaire des données, et se

montrant incapable de fournir les informations telles que les proximités, les combinaisons.

Par ailleurs, notre intérêt sur l’ACP se justifie non seulement du point de vue de l’histoire, mais aussi du

fait que la quasi – totalité de méthodes de l’analyse factorielle fait recours à l’ACP.

Nature et présentation des données

Les données soumises à l’ACP doivent être quantitatives, c’est – à – dire mesurables ou comptables

[comme le poids, l’âge, le nombre de cours, le Produit intérieur brut (PIB), etc.].

L’ACP consiste à réduire un problème à variables et individus à des axes principaux [généralement

deux] permettant de grouper les individus ou les variables selon ces axes.

Note : l’indépendance de ces deux axes principaux.

Yannick Mavita Mukwanga

Laboratoire d’Analyse – Recherche en Economie Quantitative

96

Le problème se présente initialement comme suit :

Construction de la matrice centrée

ou centrée réduite1 M’

Soit, un ensemble de variables aléatoires (X1, X2, … , Xn) connues à partir d’un échantillon de P

réalisations conjointes de ces variables. Cette situation peut être décrite dans une matrice M à lignes et

colonnes.

M =

Soit, le vecteur (, …, ) le centre de gravité2 du nuage des points et centrons la matrice M sur le

centre de gravité.

=

Cette matrice M peut être réduite, selon le modèle, en divisant chaque élément de la matrice

par

l’écart – type respectif. D’où la matrice centrée réduite M’ :

M’ =

Dans la pratique, la matrice M’ est la plus utilisée.

Note : une variable à forte variance va tirer tout l’effet de l’ACP vers elle, si on ne réduit pas le nuage. Et

une variable qui n’est un bruit [variable non significative] va se retrouver avec une variance apparente

égale à une variable significative.

Construction de la matrice d’inertie W

La méthode de l’ACP, dans le même style que l’estimation de la droite d’ajustement par les moindres

carrés ordinaires [MCO], consiste à trouver un axe [issu de la combinaison linéaire de toutes les

variables Xn] tel que le nuage des points autour de cet axe soit minimal. Ce qu’on appelle en physique

minimiser l’inertie du nuage autour de . Cet axe dirigé par un vecteur unitaire qui n’est rien d’autre que

le vecteur propre unitaire de la matrice d’inertie.

1 Le choix de réduire ou pas la matrice M dépend du choix du modèle considéré.

2 En physique, le centre de gravité [notion introduite par Isaac Newton] est le point d’application, l’origine, de la

résultante de toutes les forces de pesanteur.

X1

X2 …

Xj …

Xn

1

2

…

i

…

p

X11

X21

…

Xi1

…

Xp1

X21 …

X22 …

…

Xi2…

…

Xp2

X1j …

X2j…

…

Xij …

…

Xpj …

X1n

X2n

…

Xin

…

Xpn

Individus

Variables1

6

6

7

7

8

8

9

9

1

/

9

100%