Raisonnement probabiliste

1

1

IFT-17587

Concepts avancés pour systèmes intelligents

Luc Lamontagne

Raisonnement

probabiliste

2

Plan

Réseaux bayésiens

Inférence dans les réseaux bayésiens

Inférence exacte

Inférence approximative

3

Contexte

Jusqu’à maintenant, nous avons

principalement étudié des techniques pour

des environnements déterministes

Que faire lorsque l’environnement est non

déterministe?

Observabilité partielle

Information bruitée

Comportement stochastique

Environnement complexe…

Envir__ε…mentInférence

Agent

Effecteurs

Capteur

percepts

actions

4

Quel type d’agent?

Un agent doit pouvoir gérer :

L’incertitude lié à l’environnement Æprobabilité

La qualité de ses décisions Æutilité

Capteurs

Comment le monde

est maintenant?

Quelle action dois-je

faire maintenant?

Effecteurs

Agent

Envir___ε…ment

État

Comment le monde évolue?

Quel est l’impact de mes actions? Comment sera le monde

si je fais l’action A?

À quel point je vais être

satisfait dans un tel état?

Utilité

2

5

Agent basé sur l’utilité

Théorie de la décision (ch.16-17)

Raisonnement incertain (ch.13-14)

6

Raisonnement incertain :

Réseaux bayésiens

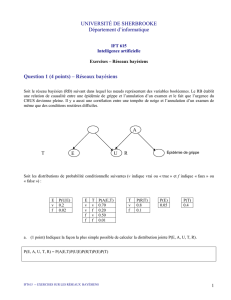

Dans cette section, nous étudions les réseaux bayésiens

Basés sur les probabilités – un formalisme éprouvé

Permettent de représenter les dépendances entre les variables

Donnent une spécification concise des distributions de

probabilités conjointes.

Attaque

Visible

Armé Proche

Audible

Niveau_énergie

Dangereux

7

Réseaux bayésiens :

Notions de probabilité

Révision des concepts de probabilité au chapitre 13

Règle du produit

Règle de bayes

Distributions de probabilités conjointes P(x,y,z)

Utile pour faire des inférences

Mais peuvent être difficile à calculer en pratique (grande taille)

Conditionnement

Indépendance et indépendance conditionnelle

Permettent de réduire les calculs reliés à ces distributions.

()

()

()

()

()

aPabPbPbaPbaP ==,

()

(

)

(

)

()

bP

aPbaP

baP =

()

()

()

∑

=

z

zPzYPYP

()

()

XPYXP =

()()()

YPXPYXP =,

8

Réseaux bayésiens :

Syntaxe

Réseau bayésien

Un graphe orienté acyclique

Chaque nœud annoté d’une table de probabilités

conditionnelles.

Plus spécifiquement, il contient:

Un ensemble de variables aléatoires

Un ensemble de liens orientés connectant deux nœuds.

S’il y a un lien du nœud Xvers Y, on dit que Xest le parent de Y.

Chaque nœud a une distribution de probabilité conditionnelle

P(Xi| Parents(Xi))

qui quantifie l’effet du parent sur le nœud.

Carie

MalDeDents SondeAccroche

0.15F

0.6V

P(MD)Carie

0.2F

0.7V

P(SA)Carie

0.02

P(Carie)

3

9

Syntaxe des réseaux bayésiens :

Exemple du dentiste

Indépendance :

Météo est indépendante des autres variables

Indépendance conditionnelle :

MalDeDents et SondeAccroche le sont sachant Carie.

Il n’y a aucun lien direct entre MalDeDents et SondeAccroche.

Météo Carie

MalDeDents SondeAccroche

10

Syntaxe des réseaux bayésiens :

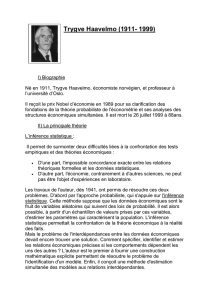

Exemple de l’alarme

Vous avez un nouveau système d’alarme à la maison :

Il sonne lorsqu’il y a un cambriolage (Burglary)

Il sonne parfois lorsqu’il y a un tremblement de terre (Earthquake)

Vous avez deux voisins qui vous appellent au bureau s’ils

entendent l’alarme.

John appelle tout le temps quand il entend l’alarme, mais parfois il

confond le téléphone avec l’alarme (JohnCalls).

Mary aime écouter de la musique forte et parfois elle n’entend pas

l’alarme (MaryCalls).

Sachant qui a appelé :

Quelle est la probabilité qu’il y ait un cambriolage ?

11

Syntaxe des réseaux bayésiens :

Exemple de l’alarme

12

Syntaxe des réseaux bayésiens :

Exemple de l’alarme

La topologie du réseau reflète un ensemble de

relations d’indépendances conditionnelles

Bulgary et Earthquake affectent directement la

probabilité de déclenchement d’une alarme

Le fait que John ou Mary appelle ne dépend que de

l’alarme.

John et Mary ne perçoivent pas directement le cambriolage

Ils ne perçoivent pas les tremblements de terre mineurs

Ils ne se consultent pas avant d’appeler

4

13

Syntaxe des réseaux bayésiens :

Exemple de l’alarme

14

Syntaxe des réseaux bayésiens :

Spécification concise

Table de probabilités conditionnelles (TPC)

Pour une variable booléenne Xi avec kparents booléens

Elle contient 2krangés.

Chaque rangée a une probabilité ppour Xi= Vrai

La valeur pour Xi= Faux est 1 – p

Si on borne le nombre maximal de parents à k

Alors le réseau demande O(n2k)nombres.

Linéaire en n, au lieu de O(2n)pour une table complète

Pour notre exemple

On a besoin de 10 valeur au lieu de 25= 32 pour la table

complète de probabilité conjointe.

15

Réseaux bayésiens :

Sémantique

Un réseau définit la distribution conjointe complète de

probabilités

Correspond au produit des distributions conditionnelles locales :

Exemple:

16

Réseaux bayésiens :

Construction

Il faut une méthode garantissant qu’une série

d’indépendances conditionnelles vérifiées localement

induise la sémantique globale requise

Choisir un ordre sur les variables

Choisir un ordre sur les variables X

X1

1,

, …

…,

,X

Xn

n

Pour

Pour i = 1

i = 1 à

àn

n Faire

Faire

-

-Ajouter

Ajouter X

Xi

iau r

au ré

éseau

seau

-

-S

Sé

électionner ses parents dans

lectionner ses parents dans X

X1

1,

,…

…,

, X

Xi

i-

-1

1tels que

tels que

P

P(

(X

Xi

i |

| Parents

Parents(

(X

Xi

i)) =

)) = P

P(

(X

Xi

i |

| X

X1

1,

, …

…,

,X

Xi

i-

-1

1)

)

Fin Pour

Fin Pour

Il est préférable d’avoir un modèle causal

• C’est-à-dire qu’il est mieux d’ajouter la cause « racine » en premier

• Et ensuite les variables qui sont influencées par la cause

5

17

Réseaux bayésiens :

Exemple

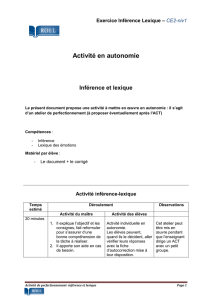

Supposons que l’on choisit l’ordre B, E, A, M, J

MaryCalls JohnCalls

Alarm

Bulgary Earthquake

18

Réseaux bayésiens :

Exemple

Supposons que l’on choisit le mauvais ordre M, J, A, B, E

MaryCalls

JohnCalls

Alarm

Bulgary

Earthquake

P(J|M) = P(J)?

P(A|J,M) = P(A|J)?

P(A|J,M) = P(A|M)?

P(B|A,J,M) = P(B|A) ?

P(B|A,J,M) = P(B) ?

P(E|B,A,J,M) = P(E|A) ?

P(E|B,A,J,M) = P(E|A,B) ?

Non

Non

Non

Non

Non

Non

Non

Non

Non

Non

Oui

Oui

Oui

Oui

On obtient un réseaux plus complexe avec

des probabilités plus difficiles à déterminer.

19

Réseaux bayésiens :

Sémantique

Sémantique locale :

chaque nœud est

conditionnellement

indépendant des nœuds

qui ne sont pas ses

descendants étant

donné ses parents.

20

Réseaux bayésiens :

Sémantique

Chaque nœud est indépendant des autres sachant sa

couverture de Markov (Markov Blanket)

Parent + Enfants + Parents des enfants.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

1

/

16

100%