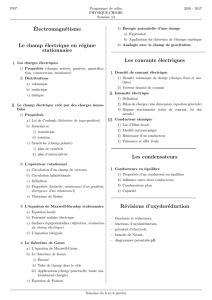

Compléments1

N Z

(Xi)i>1p>1 (X1,...Xp)

(X2,...Xp+1)

(Xi)i∈Zp>1 (X−p,...Xp)

(X−p+1,...Xp+1)

N

(Xk,...Xp)∼(Xk+l,...Xp+l)k6p l > 0

l= 1 (X1,...Xp)∼(X2,...Xp+1)

(Xk,...Xp−1)∼(Xk+1,...Xp)l= 1

RNN

RNB∞C

{(x1,...xn)∈A}A∈B(Rn)

(Xi)i>1∼(Xi+1)i>1:

P(RN,B∞)

L1(P)

C∞

C

B∞

L1C

B∞C∞

L1(Rd, P )P

(Xi)i>1ϕ Yk=ϕ(Xk, Xk+1, . . . )

(Xi)i∈ZYk=ψ(...,Xk−1, Xk, Xk+1, . . . )

A∈B∞Yk= 1(Xk,Xk+1,... )∈A

C

ϕ ϕ

ϕ[−n, n] 1/n

ψ

ϕ

limi→∞ XiPi>12−iXi

(Xn)n>0α

<1

Yn=

∞

X

j=0

αjXn−j=αYn−1+Xn

Y

Yn=

p

X

k=1

akYn−k+εn+

q

X

k=1

bkεn−k,

εnN(0, σ2)ak, bkσ

Zn=

Yn

Yn−p+1

, ηn=

εn

εn−q

, A =

a1a2. . . ap

1 0 . . . 0

0. . . 1 0

, B =

1b1. . . bq

0 0 . . . 0

0. . . 0 0

Zn=AZn−1+Bηn

p= 1, q = 0

Zn=Bηn+ABηn−1+A2Bηn−2+. . . ,

e

Zn= (Zn, εn,...εn−q+1)e

Zn=e

Ae

Zn−1+e

Bεn.

X= (Xi)i>1Y X

Y=f(X)

f(X) = X3+ 2 cos(X7)

T T Y X

T f(X) = X4+ 2 cos(X8).

T Y Y T

T L1

xiL1

Y= lim Xi

Y= 1Xi

Y= lim 1

n

n

X

i=1

Xi.

T Y =Y

Xn

ξΩ = [0,1] 1

log 2

dx

1+x

ξ=1

X1+1

X2+· · ·

.

X ξ ξ

T ξ =1

X2+1

X3+· · ·

=ξ−1−[ξ−1],

ξ ξ−1−[ξ−1]

x v x v

V(x) cos(x)

W(x, v) = 1

2mkvk2+V(x)y= (x, v)

m˙yt=md

dt xt

vt=mvt

−∇V(xt).

W(yt) = W(y0)a∈RE={y:W(y)6a}

a yt(y)y0=y t

Tt:y07→ ytE f

d

dt ZE

f(yt(y)) dy = 0,d

dt ZE

f(xt(x, v), vt(x, v)) dxdv = 0.

yny0E E[f(yn)] = E[f(y1)]

yiy1ϕ(y1. . . yp)

y1y0

f E t = 0

t06= 0 g(y) = f(yt0(y))

d

dt ZE

f(yt(y)) dy |t=t0=d

ds ZE

g(ys(y)) dy |s=0

g f

XiY=f(X)Y=T Y

PB∞

T1A= 1AA

A A

T1A

f P (T f =f)=1 {ω:a < Y < b}

Y

Y

Xkf

E[|f(X1)]|<∞

1

n

n

X

k=1

f(Xk)−→ E[f(X1)]

L1

p{(Xk+1,...Xk+p)}k>0

f

E[|f(X1,...Xp)]|<∞

1

n

n

X

k=1

f(Xk+1,...Xk+p)L1

−→ E[f(X1,...Xp)].

XkRdf∈C∞(Rpd)

1

n

n

X

k=1

f(Xk+1,...Xk+p)L1

−→ E[f(X1,...Xp)]

Y=ϕ(X1, X2, . . . )

1

n

n

X

k=1

TkYL1

−→ E[Y]

T L1(P)Y7→ 1

nPn

k=1 TkY−E[Y]

62YB∞

L1(P)f∈C∞(Rpd)L1(P)

λ ξ [0,1] Xn=ξ+nλ

X1,...Xn

ξ f ξ L2([0,1])

f(x) = X

k

cke2iπkx, ck=Z1

0

f(x)e−2iπkxdx.

e2iπkT ξ =e2iπk(ξ+λ)T f

T f(ξ) = X

k

cke2iπkλe2iπkξ.

f=T f

ck= 0 k6= 0 f

(Xn)n>1Yn=ϕ(Xn, Xn+1, . . . )n>1

(Xn)n∈ZYn=ψ(...,Xn−1, Xn, Xn+1, . . . )

Xn

E1 E1, E2 E2

Xnπ

1

n

n

X

k=1

f(Xk)L1

−→ π(f)

f p (Xk+1,...Xk+p)

6

6

7

7

8

8

1

/

8

100%