TS - DEVOIR N°1 A RENDRE LE VENDREDI 15 SEPTEMBRE 2006

I. Langage des parties d’un ensemble

E désigne un ensemble et A et B désignent deux parties (ou sous-ensembles) de E.

On écrit : A E et B E (A est contenu, ou est inclus, dans E ; idem pour B).

Partition

Les parties A1, A2, …, Ap, constituent

une partition de E si elles sont deux à deux

disjointes et si leur réunion est égale à E.

Alors, quelle que soit la partie B de E,

B = (B A1)(B A1)…(B Ap),

les parties (B Ai), pour 1 i p, étant disjointes deux à deux.

Remarque : Cette définition suppose donc non vides les parties A1, A2, …, Ap.

Produit cartésien d’ensembles

Soit deux ensembles E et F. On appelle produit cartésien de E et de F l’ensemble

EF = {(x, y) / x E et y F}.

Cette définition s’étend au produit cartésien de plus de deux ensembles.

Cardinal d’un ensemble fini

On note In = {k, k IN / 1 k n}. Donc In est une partie de IN.

On convient d’écrire I0 = .

Soit un ensemble E. S’il existe une bijection d’un ensemble In sur E, on dit que E est un

ensemble fini. L’entier naturel n est appelé cardinal de E ou nombre des éléments de E.

On note : n = card E.

DENOMBREMENTS - PROBABILITES

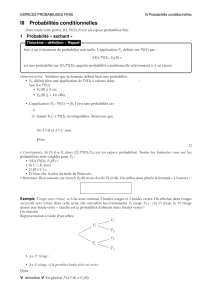

Réunion de A et B

AB

Intersection de A et B

A B

Complémentaire de A

A

A et B disjoints

A B =

E

A

B

AB

E

AB

B

A

E

A

A

E

A

B

A1

A2

A3

A4

A5

A6

A7

A8

E

E désignant un ensemble fini et A1, A2, …, Ap des parties de E constituant une partition

de E, alors : card E = card A1 + card A2 + … + card Ap.

E et F désignant deux ensembles finis leur produit cartésien EF est un ensemble fini et

card EF = (card E) (card F).

Exemple : Le tableau donnant les résultats du lancer de deux dés.

II. Vocabulaire probabiliste

A. Univers – Exemples

On envisage une expérience aléatoire comportant un nombre fini d’issues. On désigne par

l’ensemble de ces issues : = {1, 2, … , r}.

est appelé l’univers associé à cette expérience.

On appelle événement toute partie A de . Un événement réduit à une seule issue {i} est

un événement élémentaire.

Si A et B désignent deux événements de , l’événement AB est réalisé si l’un au moins

des événements A et B est réalisé.

L’événement AB est réalisé si les événements A et B sont tous les deux réalisés.

Exemple : On considère l’ensemble des entiers de 20 à 40. On choisit l’un de ces nombres

au hasard. A est l’événement : « le nombre est multiple de 3 », B l’événement : « le nombre

est multiple de 2 » et C : « le nombre est multiple de 6 ».

Ainsi C = AB.

L’événement AB est l’événement : « le nombre est multiple de 2 ou de 3 ».

B. Loi de probabilité

On définit sur l’ensemble une loi de probabilité P en se donnant une suite de nombres

(p1, p2, … , pr) , chacun de ces nombres pi étant associé à une issue i, on note encore

pi = P(i), et vérifiant :

pour tout i ( 1 i n), pi 0 et

1 p

ri

1i i

.

La probabilité d’un événement A est la somme de toutes les probabilités des issues

appartenant à A. On convient que P() = 0.

Exemple : Lorsqu’on prélève au hasard une boule dans une urne contenant trois boules

rouges, deux boules bleues et une boule jaune, si l’on considère les trois issues R (rouge), B

(bleue) et J (jaune), plusieurs choix des pi remplissent les conditions précédentes, mais le

modèle choisi n’est bon que lorsque les fréquences statistiques fi se rapprochent des pi,

quand le nombre d’expériences devient grand.

L’intuition conduit au modèle ci-contre

Propriétés

Exemple : Dans une classe, 30% suivent le cours d’allemand (A), 40% celui d’espagnol (E),

et 60% celui d’allemand ou d’espagnol.

Quelle est la probabilité qu’un élève suive les cours d’allemand ou d’espagnol ?

Loi équirépartie

Soit P = (p1, p2, … , pr) une loi de probabilité sur un univers = {1, 2, … , r}.

On dit que la loi P est équirépartie sur (ou qu’il y a équiprobabilité) si tous les pi sont

égaux.

Dans ce cas (fréquent), on a, pour chaque issue, P(i) = pi =

n

1

card

1

. Et, pour tout

événement A, P(A) =

possibles cas de nombre favorables cas de nombre

cardA card

.

Exemple 1 : On reprend l’exemple précédent. Calculer P(A), P(B), P(C), P(AB), P(AB),

P(AC) et P(AC).

Exemple 2 : On extrait une carte au hasard d’un jeu de 32 cartes. Quelle est la probabilité de

l’événement C : « la carte n’est ni un roi, ni un cœur » ?

III. Conditionnement et indépendance

A. Probabilité conditionnelle

Définition : Soit A un événement de l’ensemble des issues, tel que P(A) 0.

On définit sur une nouvelle probabilité, notée PA, en posant, pour tout

événement B,

PA(B) =

P(A)B)P(A

.

PA est appelée probabilité conditionnelle sachant que A est réalisé.

On note encore PA(B) = P(B/A) qui se lit « probabilité de B sachant A ».

issue i

R

B

J

probabilité pi

2

1

3

1

6

1

parties de

vocabulaire des événements

propriété

A

A quelconque

0 P(A) 1

,

événement certain, impossible

P() = 1 P() = 0

AB =

A et B sont incompatibles

P(AB) = P(A) + P(B)

A

événement contraire de A

P(

A

) = 1 – P(A)

A, B

événements quelconques

P(AB) = P(A) + P(B) – P(AB)

Remarque : On admet que PA est une probabilité.

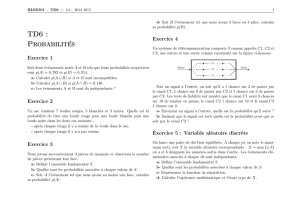

Il peut être commode de représenter l’épreuve par un arbre, en indiquant sur les branches de

premier niveau les probabilités de A et de

A

, puis sur les branches de deuxième niveau les

probabilités conditionnelles.

Exemple : Une urne contient trois boules rouges et deux boules vertes. On tire deux boules

au hasard, successivement et sans remise.

A est l’événement : « La première boule tirée est rouge » ;

B est l’événement : « La deuxième boule tirée est rouge ».

Théorème : Etant donné deux événements quelconques A et B relatifs à une même

épreuve : P(BA) = P(A) PA(B) ;

La démonstration découle directement de la définition d’une probabilité conditionnelle.

Exemple : En reprenant l’exemple, quelle est la probabilité d’obtenir deux boules rouges ?

P(BA) = P(A) PA(B) P(BA) =

10

3

2

1

5

3

.

B. Formule des probabilités totales

Théorème : Soit A1, A2, …, Ak, des événements de probabilité non nulle, réalisant une

partition de l’univers . Alors, pour tout événement B de ce même univers,

P(B) = P(A1B) + P(A2B) + … + P(AkB),

avec, pour 1 k,

P(AB) = P(A)

A

P

(B).

Démonstration

Les événements A1, A2, …, Ak désignant une partition de l’univers

, toute partie B de cet

univers s’écrit : B = (B

A1)

(B

A2)

…

(B

Ak), les parties (B

A

) étant disjointes

deux à deux. Donc P(B) = P(A1

B) + P(A2

B) + … + P(Ak

B).

Enfin, par définition d’une probabilité conditionnelle,

B

A

B

B

A

B

3/5

2/5

1/2

1/2

3/4

1/4

).()()(

)( )(

)(

APBPBAP

AP BAP

BP AA

Remarque : Un arbre de probabilités comporte des nœuds et des branches.

On applique les règles suivantes :

la somme des probabilités marquées sur des branches issues d’un même nœud est égale à 1,

la probabilité d’un événement qui correspond à un chemin est le produit des probabilités

inscrites sur les branches de ce chemin,

la probabilité d’un événement est la somme des probabilités des branches aboutissant à cet

événement.

Exemple : On considère trois urnes respectivement notées U1, U2 et U3. L’urne U1 contient

une boule rouge et cinq boules jaunes, l’urne U2 contient trois boules rouges et une boule

jaune, l’urne U3 contient une boule rouge et deux boules jaunes.

On choisit une urne au hasard et on tire une boule de cette urne.

Quelle est la probabilité que la boule tirée soit rouge ?

On note U1 l’événement : « l’urne choisie est U1 » ; on définit de même U2 et U3.

On note R et J les événements respectifs « la boule tirée est rouge » et « la boule tirée est

jaune ».

Le déroulement de cette expérience peut être schématisé dans un arbre (de gauche à droite ou

de haut en bas) constitué de tous les chemins possibles :

R

U1

J

R

U2

J

R

U3

J

La probabilité d’un chemin est le produit des probabilités marquées sur ses branches. Ainsi

P(U1R) =

6

1

3

1

, ce que traduit l’égalité P(U1R) = P(U1) P(R/U1).

La probabilité d’un événement est la somme des probabilités des chemins qui conduisent à

cet événement. Ainsi

P(R) =

6

1

3

1

+

4

3

3

1

+

3

1

3

1

=

12

5

, ce que traduit la formule des probabilités totales.

C. Indépendance

Définition : On dit de deux événements A et B qu’ils sont indépendants lorsque

P(AB) = P(A)P(B).

Cela revient à dire que, si P(A) 0, P(B/A) = P(B).

1/3

1/3

1/6

5/6

3/4

1/4

1/3

2/3

1/3

6

6

7

7

8

8

1

/

8

100%