Aide Mémoire de Calcul Différentiel

Aide Mémoire de Calcul Différentiel

1 Rappels sur les espaces normés

boule ouverte de centre aet de rayon rdef

⇐⇒ B(a, r) = {x∈E| kx−ak< r}

boule fermé de centre aet de rayon rdef

⇐⇒ B(a, r) = {x∈E| kx−ak6r}

Ωouvert def

⇐⇒ ∀x∈Ω,∃r > 0|B(x, r)⊂Ω

Afermé def

⇐⇒ E\Aouvert

⇐⇒ ∀xn∈A−→ xalors x∈A

V(a) : Vvoisinage de adef

⇐⇒ ∃r > 0, B(a, r)⊂V

Aborné def

⇐⇒ ∃x∈E, ∃r > 0|A⊂B(x, r)

suite convergente def

⇐⇒ ∀ε > 0,∃n0∈N|n>n0⇒ kxn−xk< ε

suite de Cauchy def

⇐⇒ ∀ε > 0,∃n0∈N|n, m >n0⇒ kxn−xmk< ε

suite convergente =⇒suite de Cauchy

espace de Banach (complet) def

⇐⇒ suite de Cauchy = suite convergente

k·k et k·k0équivalentes def

⇐⇒ ∃a > 0, b > 0| ∀x∈E, akxk6kxk06bkxk

f:E→Fcontinue en adef

⇐⇒ ∀ε > 0,∃δ > 0 : kx−akE6δ⇒ kf(x)−f(a)kF6ε

⇐⇒ ∀ε > 0,∃δ > 0,∀x∈B(a, δ), f (x)∈B(f(a), ε)

fcontinue ⇐⇒ Bfermé alors f−1(B)fermé

⇐⇒ Bouvert alors f−1(B)ouvert

⇐⇒ ∀xn−→ xalorsf(xn)−→ f(x)

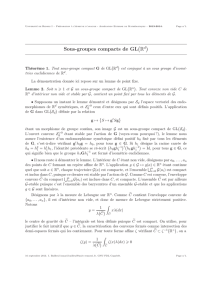

compact def

⇐⇒ sous-recouvrement fini d’ouverts

⇐⇒ ∀ suite, ∃sous-suite convergente

=⇒fermé + borné

=⇒de Banach (complet)

Ffermé ⊂Kcompact =⇒Fcompact

Kcompact et fcontinue =⇒f(K)compact et fbornée et atteint ses bornes

1

dimensions infinies (cas général) dimensions finies

exemples : C0([0; 1],R)∼ R∞,P[X]exemples : Rn,Mn×m(R)

normes équivalentes

espace de Banach (complet) si suite de Cauchy = suite convergente

suite de Cauchy = suite convergente

compact = sous-recouvrement fini d’ouverts compact ⇐⇒ fermé + borné

compact ⇐⇒ sous-suite convergente

compact =⇒fermé + borné

linéaire + continue ⇔linéaire + bornée linéaire =⇒continue

sur B(0; 1)

Théorème du point fixe

f:E→Eavec E, espace de Banach

kf(x)−f(y)k6αkx−yk(0 < α < 1) =⇒f(a) = aunique

Applications linéaires continues : L(E, F )

|||f||| =kfkL(E,F )= supkxkE61kf(x)kF

si flinéaire : fcontinue sur E⇔fcontinue en un point

⇔fest bornée sur B(0; 1)

⇔ ∃M>0tel que kf(x)kF6MkxkE(avec M=|||f|||)

f∈ L(E, F ) =⇒ kf(x)kF6|||f|||kxkE

2 Synthèse sur les applications différentiables

f(a+h)−f(a) = linéaire, continue en h+négligeable en h

différentielle : f0(a)∈ L(E, F )

f(a+h)−f(a) = [f0(a)](h)ou f0(a)h+o(h)

(calcul différentiel) =(algèbre linéaire) +(majorations de normes)

x7→ f0(a)(x−a) + f(a): équation de la tangente à fen a= approximation affine

Rappels

f=o

a(g)⇐⇒ f(x)

g(x)

x→a

−−−→ 0f=O

a(g)⇐⇒ lim

x→a

f(x)

g(x)borné

f(h) = o(h)⇐⇒ kf(h)k

khk

khk→0

−−−−→ 0

2

g∈ L(R,R)⇐⇒ ∃λ∈R| ∀x∈R, g(x) = λx

g∈ L(Rn,Rm)⇐⇒ ∃Mg∈Mn×m(R)| ∀x∈Rn, g(x) = Mgx

⇒f0(a)∈ L(Rn,Rm)≡f0(a)∈Mn×m(R)

2.1 Propriétés

•fdifférentiable =⇒fcontinue

•f∈ L(E, F ) =⇒f0(a) = f

•fconstante =⇒f0(a)=0

•(λf)0(a) = λf0(a)

•(f+g)0(a) = f0(a) + g0(a)

•(g◦f)0(a) = g0(f(a)) ◦f0(a)

•l(x) = B(f(x), g(x)) =⇒l0(a)h=B(f0(a)h, g(a)) + B(f(a), g0(a)h)

ex : l(x) = f(x)×g(x) = B(f(x), g(x)) avec B(x, y) = x×y

⇒l0(a)h=f0(a)h×g(a) + f(a)×g0(a)h

2.2 Théorème d’accroissements finis

fdifférentiable sur [a, b]⇒ kf(b)−f(a)kF6 sup

x∈[a,b]

|||f0(x)|||!kb−akE

fdifférentiable sur un connexe ⇒ kf(x)−f(y)kF6sup

a∈connexe

|||f0(a)|||kx−ykE

|||f0(a)||| =kf0(a)kL(E,F )= supkxkE61kf0(a)(x)kF

2.3 Cas f:Rn→Rm

fdifférentiable ⇒δifexistent :δif(a) = f0(a)ei

fdifférentiable :δifexistent

fdifférentiable ⇐δifexistent et sont continues

f0(a)h=Xδif(a)hi

2.4 Continûment différentiable

f∈C1=fdifférentiable

f0continue ⇔δifexistent et sont continues (cas Rn→Rm)

f0(x) : E→F

h7→ f0(x)h6=f0:U→ L(E, F )

x7→ f0(x)

fdifférentiable sur U ⇒f0(a)continue (et linéaire) ∀a∈E

6=f0continue

3

2.5 Matrice Jacobienne de f:Rn→Rmen x

Jf(x) =

∂1f1(x). . . ∂nf1(x)

.

.

..

.

..

.

.

∂1fm(x). . . ∂nfm(x)

=

∇f1(x)T

.

.

.

∇fm(x)T

= (J1f(x). . . Jmf(x))

L(Rn,Rm)≡Mn×m(R)

x∈Rnf0(x)≡Jf(x)

x, y ∈Rn, f0(x)y=Jf (x)y∈Rm

2.6 Gradient de f:Rn→Ren x

∇f(x) = Jf(x)T=

∂1f(x)

.

.

.

∂nf(x)

f0(x)h=∂1f(x). . . ∂nf(x)

h1

.

.

.

hn

=h∇f(x), hi

f(a+h)−f(a) = h∇f(x), hi+o(h)

Rappels

Injectif, Surjectif, Bijectif

finjectif ⇔f(x) = f(y)⇒x=y

si flinéaire : finjectif ⇔(f(x) = 0 ⇒x= 0) ⇔ker f={0}

fsurjectif ⇔ ∀y, ∃x|f(x) = y

∀f:E→F⇒f:E→f(E)surjectif

fbijectif ⇔finversible

⇔finjectif et surjectif

⇔ ∀y, ∃!x|f(x) = y

f∈ L(Rn,Rm)inversible et d’inverse continue ⇔det Jf (x)6= 0

Inversion de matrice

A−1=1

det AcomAT

avec comAij = (−1)i+jdet(Aprivée de la i-ème ligne et de la j-ième colonne)

a b

c d −1

=1

ac −bd d−b

−c a

4

3 Différentielles secondes, formules de Taylor

3.1 f00(a)différentielle seconde de fen a

f0(a+h) = f0(a) + f00(a)h+o(h)dans L(E, F )

f00(a)=(f0)0(a)∈ L(E, L(E, F )) ≡ L(E×E, F )) = application bilinéaire continue

3.2 Théorème de Schwarz

fde classe C2⇒f00(a)est symétrique

3.3 Cas f:Rn→R

f00(x)(h, k) =

n

X

j=1

n

X

i=1

∂2f

∂xj∂xi

(x)kihj

Matrice hessienne de f(carrée et symétrique)

∇2f(x) =

∂2f

∂x2

1

(x)· · · ∂2f

∂xn∂x1(x)

.

.

..

.

.

∂2f

∂x1∂xn(x)· · · ∂2f

∂x2

n(x)

3.4 Formule de Taylor

f:E→F f(a+h) = f(a) + f0(a)h+1

2f00(a)(h, h) + o(h2)

f:Rn→Rf(a+h) = f(a) + h∇f(a), hi+1

2h∇2f(a)h, hi+o(h2)

3.5 Ensemble convexe / Fonction convexe

C⊂Rnconvexe ⇐⇒ ∀x, y ∈C, ∀α∈[0,1], αx + (1 −α)y∈C

f:C⊂Rn→Rconvexe ⇐⇒ ∀α∈[0,1], f(αx+(1−α)y)6αf(x)+(1−α)f(y)

3.6 Propriétés

fconvexe =⇒λf convexe (λ > 0)

fet gconvexes =⇒(f+g)et max(f, g)convexes

3.7 M∈Mn(R)matrice symétrique

Mest définie positive Mest semi-définie positive

⇐⇒ ∀x∈Rn\{0}, xTMx > 0⇐⇒ ∀x∈Rn, xTM x >0

⇐⇒ toutes valeurs propres >0⇐⇒ toutes valeurs propres >0

n=2

⇐⇒ det(M)>0

tra(M)>0

n=2

⇐⇒ det(M)>0

tra(M)>0

5

6

6

7

7

1

/

7

100%