Formulaire de Probabilités et Statistique

Table des matières

Table des matières

1 Dénombrement 5

2 Calculs utiles 9

3 Espaces probabilisés et probabilités 11

4 Probabilités conditionnelles et indépendance 15

5 Variables aléatoires réelles (var) discrètes 18

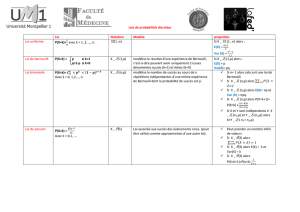

6 Lois discrètes usuelles 22

7 Modélisation 25

8 Couples de var discrètes 27

9 Vecteurs de var discrètes 32

10 Convergences de suites de var discrètes 35

11 Calcul intégral 36

12 Variables aléatoires réelles à densité 40

13 Lois à densité usuelles 45

14 Retour sur la loi normale 49

15 Couples de var à densité 52

16 Vecteurs de var à densité 59

17 Convergences de suites de var ; généralité 64

18 Introduction à l’estimation paramétrique 66

C. Chesneau 3

Table des matières

19 Intervalles de confiance 69

20 Tests de conformité 70

∼Note ∼

Ce document présente les principales formules brutes abordées dans le cours Probabilités et

Statistique du L3 de l’université de Caen. Notes importantes :

◦On suppose acquis les concepts de base sur les ensembles. Par exemple, voir :

http://www.math.unicaen.fr/~chesneau/notions-de-base.pdf

◦Des points techniques ont volontairement été omis ; f,g,h,gidésignent des fonctions sur

Rou R2. . . ou Rnselon le contexte ; lorsqu’une quantité est introduite (dérivé, somme,

intégrale, espérance, variance . . . ), il est supposé que celle-ci existe.

Je vous invite à me contacter pour tout commentaire :

Quelques ressources en lien avec ce cours :

◦Probabilités de Stéphane Ducay :

http://www.lamfa.u-picardie.fr/ducay/Accueil.html

◦Introduction aux Probabilités de Arnaud Guyader :

http://www.lsta.lab.upmc.fr/modules/resources/download/labsta/Pages/Guyader/IntroProba.

pdf

◦Éléments de cours de Probabilités de Jean-François Marckert :

http://eric.univ-lyon2.fr/~ricco/cours/cours/La_regression_dans_la_pratique.pdf

◦Probabilités et Statistiques de Alain Yger :

https://www.math.u-bordeaux.fr/~ayger/Proba6031.pdf

◦Cours de Théorie des probabilités de Bruno Saussereau :

http://bsauss.perso.math.cnrs.fr/CTU-1314-SAUSSEREAU-THEORIE-DES-PROBABILITES.pdf

Bonne lecture !

C. Chesneau 4

1 Dénombrement

1 Dénombrement

Vocabulaires :

Notations Vocabulaire

∅ensemble vide

Ωensemble plein

{ω}singleton de Ω

Apartie de Ω

ω∈A ω appartient à A

Acomplémentaire de Adans Ω

Notations Vocabulaire

A∪Bréunion de Aet B

A∩Bintersection de Aet B

A−Bintersection de Aet B

A∩B=∅Aet Bsont disjoints

A⊆B A est inclus dans B

A×Bproduit cartésien de Aet B

Exemple :

Ensemble Définition A={a, b},B={b, c},Ω = {a, b, c}

A{x∈Ω; x6∈ A} {c}

A∪B{x∈Ω; x∈Aou x∈B} {a, b, c}

A∩B{x∈Ω; x∈Aet x∈B} {b}

A−B{x∈Ω; x∈Aet x6∈ B} {a}

A×B{(x, y); x∈Aet y∈B} {(a, b),(a, c),(b, b),(b, c)}

Opérations :

(A∪B)∩C= (A∩C)∪(B∩C),(A∩B)∪C= (A∪C)∩(B∪C),

n

[

k=1

Ak!∩B=

n

[

k=1

(Ak∩B), n

\

k=1

Ak!∪B=

n

\

k=1

(Ak∪B).

C. Chesneau 5

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

62

62

63

63

64

64

65

65

66

66

67

67

68

68

69

69

70

70

71

71

72

72

73

73

74

74

75

75

76

76

77

77

78

78

79

79

80

80

1

/

80

100%