Espace géographique

L'analyse factorielle : ses contraintes mathématiques et ses limites

en géographie

André Dauphiné

Abstract

Factor analysis : its mathematical restrictions and its limitations in geography. — Factor analyses are used by the geographer to

discover hidden structures, and to achieve an objectivity which is difficult to attain with classical techniques. But the use of these

techniques is dependent on a long series of mathematical restraints and limitations peculiar to geography. New, less restrictive

models appear every year, facilitating the elimination of obstacles, but before proposing models, the geographer must be

acquainted with the imperfection of these techniques.

Résumé

Les analyses factorielles sont un moyen pour le géographe de découvrir des structures cachées, et de parvenir à une objectivité

difficilement atteinte par les techniques classiques. Mais l'emploi de ces techniques est soumis à une longue série de

contraintes mathématiques, et de limites propres à la science géographique. De nouveaux modèles moins contraignants

apparaissent chaque année, faisant disparaître des obstacles, mais avant de proposer des modèles factoriels, le géographe-

utilisateur doit connaître les imperfections de ces techniques.

Citer ce document / Cite this document :

Dauphiné André. L'analyse factorielle : ses contraintes mathématiques et ses limites en géographie. In: Espace géographique,

tome 2, n°1, 1973. pp. 74-80;

doi : https://doi.org/10.3406/spgeo.1973.1382

https://www.persee.fr/doc/spgeo_0046-2497_1973_num_2_1_1382

Fichier pdf généré le 03/01/2019

L'Espace

géographique,

n°

1,

1973,

74-80.

Doin,

8,

place

de

l'Odéon,

Paris-VIe.

Méthodes

d'analyse

L'ANALYSE

FACTORIELLE

:

SES

CONTRAINTES

MATHÉMATIQUES

ET

SES

LIMITES

EN

GÉOGRAPHIE

André

DA

UPHINÉ

Laboratoire

Raoul

Blanchard,

Université

de

Nice

RESUME.

Les

analyses

factorielles

sont

un

moyen

pour

le

géographe

de

découvrir

des

structures

cachées,

et

de

parvenir

à

une

objectivité

difficilement

atteinte

par

les

techniques

classiques.

Mais

l'emploi

de

ces

techniques

est

soumis

à

une

longue

série

de

contraintes

mathématiques,

et

de

limites

propres

à

la

science

géographique.

De

nouveaux

modèles

moins

contraignants

apparaissent

chaque

année,

faisant

disparaître

des

obstacles,

mais

avant

de

proposer

des

modèles

factoriels,

le

géographe-utilisateur

doit

connaître

les

imperfections

de

ces

techniques.

ABSTRACT.

Factor

analysis

:

its

mathematical

restrictions

and

its

limitations

in

geography.

—

Factor

analyses

are

used

by

the

geographer

to

discover

hidden

structures,

and

to

achieve

an

objectivity

which

is

difficult

to

attain

with

classical

techniques.

But

the

use

of

these

techniques

is

dependent

on

a

long

series

of

mathematical

restraints

and

limitations

peculiar

to

geography.

New,

less

restrictive

models

appear

every

year,

facilitating

the

elimination

of

obstacles,

but

before

proposing

models,

the

geographer

must

be

acquainted

with

the

imperfection

of

these

techniques.

L'auteur

de

cette

note

technique

et

méthodologique

(1)

pense

que

la

géographie

est

une

science,

position

nullement

originale

que

de

nombreux

géographes

ont

prise

avant

nous

(2).

Les

techniques

mathématiques

sont

un

des

moyens

les

plus

sûrs

d'atteindre

ce

but,

même

si

d'autres

existent

parallèlement,

en

particulier

l'exploitation

cartographique.

Accuser

les

géographes

«

quantitatifs

»,

dénomination

impropre,

de

scientistes,

c'est

en

réalité

ignorer

que

les

statistiques

descriptives

et

inductives

ont

pour

fondement

la

théorie

des

probabilités;

probabilisme

et

scientisme

ou

déterminisme

sont

deux

philosophies

du

monde

qui

s'excluent

mutuellement.

Cette

prise

de

position

nous

semble

nécessaire,

car

les

observations

que

nous

formulons

à

l'

encontre

de

l'analyse

factorielle

(3)

ne

doivent

pas

cacher

son

utilité,

ni

conduire

à

une

condamnation

hâtive

des

techniques

mathématiques.

Ce

dont

souffre

le

géographe,

ce

n'est

pas

d'employer

les

statistiques,

mais

de

mal

les

connaître

:

«

dans

l'état

actuel

des

choses,

sa

formation

est

nulle

en

ce

domaine

»

(R.

Brunet

[3])

;

et,

pire

encore,

de

les

utiliser

après

un

survol

trop

rapide.

Les

exemples

à

citer

sont

nombreux,

mais

le

rôle

de

censeur

ne

nous

intéresse

nullement.

La

première

démarche

rationnelle

est

de

s'initier

à

l'analyse

mathématique.

I.

LES

FAUSSES

CONTRAINTES

DU

MODELE

FACTORIEL.

Avant

d'aborder

l'examen

détaillé

des

contraintes

réelles,

il

faut,

sinon

rejeter,

du

moins

préciser

deux

critiques

souvent

émises.

Selon

certains

chercheurs,

l'analyse

factorielle,

et

parfois

même

de

simples

paramètres

statistiques,

sont

trop

complexes.

La

science,

(1)

Nous

remercions

vivement

M.

Novi,

mathématicien

sociologue

à

l'UER

Lettres

et

Sciences

humaines

de

Nice,

des

remarques

qu'il

nous

a

aimablement

communiqués.

(2)

Cf.

J.

Tricart

:

«

La

géographie

est

une

science

»

(repris

par

A.

Meynier

[1],

p.

126).

Les

nombres

entre

crochets

renvoient

à

la

bibliographie.

(3)

II

existe

en

réalité

de

nombreux

modèles

d'analyse

factorielle.

Voir,

pour

les

plus

récents,

L.

Lebart

et

J.

P.

FÉ-

nelon

[23].

L'analyse

factorielle

75

est-il

besoin

de

le

rappeler,

n'est

pas

une

tâche

aisée,

et

de

tels

aveux

sont

des

signes

de

faiblesse.

Plus

intéressantes

sont

les

citations

qui

soulignent

que

les

techniques

mathématiques

ne

sont

pas

explicatives.

De

telles

affirmations

reposent

sur

une

conception

schématique

de

l'explication

en

géographie.

Il

existe

en

effet

deux

questions

explicatives

que

le

géographe

a

le

devoir

d'élucider,

le

comment

et

le

pourquoi.

La

majorité

de

nos

confrères

scientifiques

sont

satisfaits

après

avoir

répondu

à

la

question

comment,

mais

une

des

originalités

du

géographe

est

son

désir

de

découvrir

le

pourquoi

d'une

structure

spatiale.

L'analyse

mathématique

permet

de

répondre

rationnellement

au

comment

d'un

fait,

première

étape

indispensable

de

l'explication;

et

le

géographe

ne

peut

pas

répondre

à

la

question

pourquoi

avant

d'avoir

élucidé

le

comment

d'une

série

d'états..

Il

est

dans

l'obligation

d'ordonner

le

réel,

démarche

qui

consiste

essentiellement

à

établir

un

modèle

mathématique

plus

ou

moins

complexe.

Il

est

donc

partiellement

vrai

de

prétendre

que

les

statistiques

et

autres

techniques

mathématiques

ne

permettent

pas

de

découvrir

le

pourquoi

d'un

fait

géographique.

Ces

quelques

remarques

sont

succinctes,

et

donc

trop

abruptes.

L'explication

dépend

de

l'intelligence

du

géographe,

mais

l'esprit

ne

formule

que

des

hypothèses,

et

leur

vérification

nécessite

l'emploi

des

mathématiques.

Soit

l'exemple

précis

des

précipitations

méditerranéennes

en

France

:

les

géographes

avancent,

comme

explication,

la

présence

en

altitude

d'une

goutte

ou

d'une

vallée

froide,

idée

qui

demeure

une

hypothèse

aussi

longtemps

qu'on

ne

démontre

pas

l'existence

de

liens

entre

les

pluies

et

ce

type

de

situation,

démonstration

que

l'on

peut

faire

avec

le

test

du

x2;

rien

n'interdit,

en

effet,

de

penser

qu'une

telle

situation

en

altitude

se

présente

sans

que

tombent

des

précipitations.

La

géographie

est

ainsi

encombrée

d'hypothèses

non

démontrées,

qui

sont

admises

comme

autant

de

lois.

Ces

remarques

n'entraînent

aucun

jugement

de

valeur,

précisons-le,

sur

la

justesse

de

ces

hypothèses;

mais

une

telle

démarche

ne

peut

pas

prétendre

être

scientifique.

Ces

contraintes

mineures

écartées,

d'autres

existent,

qui

paraissent

plus

profondes.

II.

LES

CONTRAINTES

MATHÉMATIQUES

DE

L'ANALYSE

FACTORIELLE.

Les

techniques

multivariées

sont

nombreuses.

Pour

ne

pas

troubler

les

géographes,

nous

identifions

analyse

multivariée

et

analyse

factorielle,

ce

que

refusent

les

mathématiciens.

Pour

eux,

l'analyse

multivariée

correspond

à

l'introduction

de

«

variables-tests

»

pour

étudier

la

relation

entre

des

variables

indépendantes

et

une

variable

dépendante.

L'analyse

factorielle

siste

à

dégager

des

facteurs

qualifiés

«

explicatifs

»

d'une

batterie

de

variables

quelconques.

Les

solutions

proposées

par

les

mathématiciens

varient,

comme

en

témoigne

le

gros

ouvrage

de

Horst

[4].

Nous

admettons

implicitement

dans

cette

réflexion

que

sont

connues

l'analyse

en

composantes

principales,

notamment

celle

de

Hotelling,

l'analyse

des

correspondances

mise

au

point

par

Shepard

aux

Etats-Unis

et

Ben-

zécri

en

France,

et

enfin

l'analyse

factorielle

dite

classique

de

Spearman,

améliorée

par

les

recherches

de

Thurstone.

1.

Contraintes

sur

la

matrice

des

données.

Dès

la

phase

initiale

de

la

confection

de

la

matrice

des

observations,

tableau

où

les

lignes

correspondent

aux

espaces

étudiés,

et

où

les

attributs

retenus

figurent

dans

les

colonnes,

des

contraintes

apparaissent,

mal

connues

et

souvent

négligées.

Il

est

recommandé

de

ne

pas

mélanger

dans

la

matrice

initiale

des

variables

quantitatives

et

des

variables

qualitatives

classées

par

la

technique

des

rangs.

Duband,

dans

son

modèle

factoriel,

mis

au

point

pour

prévoir

les

hauteurs

de

pluies

recueillies

sur

un

bassin

versant,

a

volontairement

limité

le

nombre

des

variables,

refusant

de

mélanger

données

cardinales

et

ordinales

[5].

Les

solutions

à

ce

problème

sont

bien

connues

et

nous

n'insisterons

pas.

L'analyse

des

correspondances

est

un

modèle

mathématique

qui

permet

d'analyser

les

caractères

qualitatifs

et

ordinaux.

Une

seconde

solution

consiste

à

classer

les

observations

et

calculer

les

coefficients

de

rangs

de

Sperman

pour

une

analyse

en

composantes

principales

suivant

le

modèle

de

Hotelling.

Cette

seconde

formule

s'accompagne

cependant

d'une

perte

d'information.

Enfin,

quand

on

retient

seulement

une

ou

deux

variables

qualitatives,

il

est

souhaitable

de

faire

une

analyse

en

donnant

la

valeur

0

à

ces

variables,

puis

de

procéder

à

un

deuxième

traitement

avec

la

valeur

1,

et

de

comparer

les

résultats.

Souvent,

les

valeurs

que

prennent

les

attributs

sont

très

dissemblables.

Dans

une

étude

urbaine

par

exemple,

le

nombre

d'usines

est

comptabilisé

en

dizaines,

mais

la

population

active

en

milliers.

Chaque

fois

qu'une

telle

disharmonie

est

constatée,

il

faut

présenter

une

matrice

des

variables

centrées

:

X'^Xi

—

X

ou,

mieux

encore,

de

variables

réduites

ou

centrées-

norme

es

:

XT

=

(X,

—

X)/cr,

où

X

est

la

moyenne,

cx

l'écart-type.

En

effet,

quand

les

valeurs

des

variables

sont

trop

différentes,

des

erreurs

graves,

dites

de

chute,

peuvent

apparaître

en

cours

de

traitement,

et

il

est

donc

nécessaire

de

standardiser

les

variables

initiales.

76

A.

Dauphiné

Une

troisième

contrainte,

souvent

négligée,

doit

être

respectée

:

la

matrice

des

données

ne

doit

pas

contenir

de

rapport.

Cette

limitation

n'est

pas

imperative,

mais

les

quotients

sont

des

êtres

mathématiques

dont

le

comportement

est

mal

élucidé.

Il

est

préférable

d'introduire

dans

le

tableau

d'observation

les

deux

variables

que

sont

le

numérateur

et

le

dénominateur

d'un

rapport.

Par

exemple,

pour

une

analyse

multivariée

d'une

structure

agricole,

les

mathématiciens

recommandent

d'intégrer

le

nombre

d'hectolitres

de

lait

recueilli

et

le

nombre

de

vaches

laitières,

plutôt

que

de

présenter

les

rendements

laitiers,

qui

sont

un

quotient.

Le

géographe,

grâce

à

l'emploi

efficace

de

l'ordinateur,

peut

définir

de

nouveaux

indicateurs

géographiques

en

établissant

des

rapports,

mais

il

est

dangereux

de

les

faire

intervenir

dans

une

analyse

multivariée.

2.

Les

contraintes

sur

la

matrice

de

corrélation.

Le

schéma

général

de

l'analyse

factorielle

consiste

à

résoudre

l'équation

matricielle

RV

=

XV,

où

R

est

la

matrice

de

corrélation.

Cette

matrice

contient

les

coefficients

de

corrélation

de

Bravais-Pearson.

Ceux-

ci

n'ont

un

sens

mathématique

que

pour

les

relations

linéaires,

c'est-à-dire

quand

les

variables

ont

une

loi

de

distribution

fréquentielle

normale

ou

gaus-

sienne.

Si

des

paramètres

géographiques

s'ordonnent

bien

ainsi,

en

fait

«

on

sait

aujourd'hui

que

bien

rares

sont

les

distributions

géographiques

qui

obéissent

à

cette

loi

de

normalité

»

(Racine

et

Lemay

[6]).

Cette

constatation

s'avère

exacte

non

seulement

en

géographie

humaine

mais

aussi

en

géographie

physique.

Deux

variables

peuvent

être

«

totalement

»

dépendantes,

et

si

elles

ne

sont

pas

gaussiennes

le

coefficient

de

corrélation

pourra

être

voisin

de

0,

semblant

indiquer

une

indépendance

presque

parfaite.

Il

est

logique

de

penser

que,

tous

les

calculs

effectués

à

partir

d'une

telle

matrice

de

corrélation

seront

inexacts.

En

fait,

l'estimation

d'un

coefficient

de

corrélation

linéaire

n'est

possible

que

si

les

trois

conditions

suivantes

existent

:

les

deux

variables

Xj

et

X2

doivent

être

aléatoires;

les

distributions

marginales

et

liées

de

ces

variables

doivent

être

normales;

elles

doivent

respecter

le

principe

d'homoscédasticité,

c'est-à-dire

que

les

variances

des

distributions

liées

doivent

être

égales,

généralement

à

1.

De

telles

conditions

doivent

être

vérifiées

avant

le

passage

en

ordinateur

de

la

matrice

des

données.

Pour

résoudre

cet

obstacle,

deux

catégories

de

solutions

existantes

à

retenir

:

rendre

les

distributions

normales,

ou

effectuer

les

calculs

à

partir

d'une

autre

matrice

de

corrélation.

Dans

le

premier

cas,

il

existe

à

notre

connaissance

deux

procédés

:

l'anamorphose,

et

la

transformation

des

variables

en

utilisant

des

puissances

fractionnaires.

Le

problème

est

en

fait

plus

complexe

(4).

Ce

n'est

pas,

semble-t-il,

parce

qu'on

normalise

les

distributions

marginales,

que

l'on

normalise

la

distribution

bivariée,

à

savoir

qu'on

rend

elliptique

le

nuage

de

points.

Cette

réserve

faite

pour

deux

variables

est

a

fortiori

plus

vraie

dans

un

espace

à

n

dimensions,

qui

est

caractéristique

des

analyses

factorielles.

L'anamorphose

est

une

technique

et

nous

proposons,

pour

l'expliciter,

quelques

distributions.

Soit

une

variable

obéissant

à

une

loi

logarithmique

simple;

le

géographe

peut

normaliser

la

distribution

en

définissant

de

nouvelles

valeurs

XJ

telles

que

X<

=

log

X*.

Dans

son

étude

sur

les

structures

commerciales

de

Chicago,

Berry

normalise

ainsi

ses

dix

variables

en

prenant

comme

valeur

leur

logarithme

[7].

Cette

solution

n'est

d'ailleurs

possible

que

si

Xj

>

0.

Pour

X{

<

0,

il

faut

prendre

:

X*

=

log

(Xo

-f

XJ

,

en

donnant

à

Xo

une

valeur

telle

que

le

logarithme

ait

un

sens.

Cette

transformation

logarithmique

n'est

pas

universelle,

car

de

nombreuses

variables

obéissent

à

des

lois

plus

complexes.

Au

cours

de

travaux

personnels,

nous

avons

découvert

des

éléments

du

complexe

géographique

s'ordonnant

suivant

la

loi

~K

=

a/(b-\-t),

fonction

qui

s'applique

sans

doute

à

de

nombreux

paroxysmes

(5).

Les

statisticiens

américains

Draper

et

Smith

ont

démontré

que

cette

technique

d'anamorphose

est

parfois

impossible,

certaines

distributions

ne

pouvant

pas

être

ramenées

à

une

loi

de

Gauss

[8].

Un

second

procédé

consiste

à

transformer

les

variables

en

utilisant

des

puissances

fractionnaires.

Nous

ne

pouvons

pas

présenter

en

détail

cette

technique

dans

le

cadre

de

cet

article.

Elle

a

pour

but

essentiel

de

normaliser

une

distribution

dissymétrique.

Pour

vérifier

les

résultats,

le

chercheur

calcule

les

coefficients

[31

et

P2

de

Pearson,

qui

sont

des

tests.

En

effet

pour

une

distribution

gaussienne

on

obtient

:

31

=

0

32

=

3

Cependant,

ces

deux

coefficients

sont

susceptibles

de

fortes

fluctuations

d'échantillonnage.

Ils

ne

peuvent

donc

être

calculés

que

sur

des

séries

comprenant

au

moins

50

valeurs

d'une

variable,

ce

qui

n'est

pas

toujours

possible

dans

certaines

analyses

multivariées.

Un

second

groupe

de

solutions

consiste

à

remplacer

la

matrice

des

coefficients

de

corrélation

de

Pearson

par

une

autre

matrice

contenant

des

paramètres

de

corrélation

plus

généraux.

Parmi

les

différents

coefficients

existant

dans

la

littérature

mathématique,

deux

semblent

intéressants.

Le

premier

est

le

coefficient

de

corrélation

de

rang

de

Spearman.

R,

=

1

-

6ZD2

N(N2

-

ou,

mieux

encore,

le

rapport

de

corrélation

2(X,.

-X)2

(4)

Les

remarques

suivantes

sont

de

M.

Novi.

(5)

Cette

liste

n'est

nullement

limitative

:

citons

encore

X'

=

VX

etX'

=

o

sin

y/X.

L'analyse

factorielle

77

Citons

en

outre

le

coefficient

élaboré

par

Kendall

qui,

à

l'inverse

du

coefficient

de

Spearman,

se

généralise

pour

le

calcul

des

corrélations

partielles.

L'étude

de

Héraux

et

Novi

(6)

est

une

analyse

en

composantes

principales

de

Hotelling

avec

une

matrice

de

corrélation

renfermant

les

coefficients

de

rang

de

Spearman.

Le

rapport

de

corrélation

est

très

général,

et

il

permet

de

déterminer

les

relations

non

linéaires.

Il

est

parfois

employé

comme

test

pour

vérifier

si

une

relation

est

parfaitement

linéaire.

Quand

la

corrélation

est

linéaire

on

obtient

:

Vy/x

=

±

Ry/x

Malheureusement

le

calcul

d'une

matrice

de

rapports

de

corrélation

pose

de

nombreux

problèmes

techniques

pour

le

programmeur,

particulièrement

en

FORTRAN.

D'autre

part,

pour

déterminer

une

courbe

et

non

plus

une

droite,

il

faut

disposer

d'au

moins

trois

points,

soit

cent

cinquante

valeurs

d'un

attribut,

ce

qui

est

rarement

possible.

En

effet,

le

rapport

de

corrélation

n'a

de

sens

que

pour

un

quotient

classes-

données

de

1/50

(Grisollet,

[9]).

Un

dernier

paramètre

de corrélation

permettrait,

peut-on

penser,

de

résoudre

cette

difficulté

:

l'indice

général

de

corrélation,

qui

est

indépendant

des

distributions

théoriques

des

variables

:

~V

2

(Y,-

-

Y)2

2

(Yf

-Y)2

où

le

numérateur

est

la

variance

des

résidus

et

le

dénominateur

est

la

variance

des

Yf.

Mais

un

tel

coefficient

est

difficilement

calculable,

car

il

faut

déterminer

les

résidus

et

donc

passer

par

un

modèle

de

régression.

Ces

trois

solutions

décrites

succinctement

sont

imparfaites,

et

elles

apparaissent

dans

peu

d'ouvrages

mathématiques.

N'ayant

nullement

l'ambition

de

remplacer

les

mathématiciens

chevronnés,

nous

les

proposons

comme

sujets

de

réflexion

et

hypothèses

de

travail,

mais

des

études

approfondies

peuvent

conduire

à

leur

rejet.

3.

Les

différents

modèles

d'analyse

multivariée.

Face

à

ces

conditions

tyranniques

pour

le

géographe,

et

dans

l'attente

de

modèles

d'analyse

factorielle

non

linéaire,

la

prudence

doit

être

la

règle,

et

ceci

d'autant

plus

que

les

modèles

ne

sont

pas

tous

équivalents.

L'analyse

en

facteurs

communs

de

Thurstone

ou

Burt

est

la

moins

utile

pour

le

géographe.

Sur

le

plan

mathématique,

on

démontre

que,

si

une

solution

existe,

il

y

en

a

une

infinité.

Avec

un

tel

outil,

les

hypo-

(6)

P.

Héraux

et

M.

Novi,

Application

de

l'analyse

factorielle

à

l'étude

de

l'idéologie.

thèses

doivent

obligatoirement

précéder

l'analyse,

qui

devient

ainsi

une

mise

à

l'épreuve.

En

fait,

cette

technique

nous

paraît

très

entachée

de

subjectivité,

et

nous

ne

doutons

pas

que

certains

géographes

parviennent

à

démontrer

ainsi

la

validité

de

n'importe

laquelle

des

hypothèses

formulées

au

départ.

D'autre

part,

ce

modèle

classique

est

le

plus

restrictif,

si

bien

que

son

emploi

est

très

limité.

L'analyse

en

composantes

principales

de

Pearson

ou

Hotelling

est

plus

simple.

La

solution

factorielle

existe

toujours

et

elle

est

unique.

Ce

modèle

est

purement

descriptif

selon

de

nombreux

auteurs,

ce

dont

nous

doutons,

car

toute

réduction

ordonnée

est

un

acte

rationnel

et

qui

dirige

l'explication.

Certains,

du

fait

de

ce

rôle

modeste

accordé

à

cette

technique,

pensent

que

la

condition

de

normalité

n'est

pas

gênante.

Rappelons

que

les

facteurs

sont

les

vecteurs

propres

de

la

matrice

des

corrélations,

correspondant

aux

plus

grandes

valeurs

propres.

Si

la

matrice

des

corrélations

contient

les

coefficients

de

Bravais

-Pearson,

nous

ne

voyons

pas

ce

qui

peut

justifier

la

non-observance

de

la

contrainte

de

normalité.

Il

est

logiquement

préférable

d'élaborer

une

matrice

de corrélation de

rang.

Ce

dernier

choix

présente

un

autre

avantage

important:

connaissant

le

nombre

d'attributs

p

et

le

nombre

d'observations

n,

il

est

possible

de

savoir

avec

précision

quand

doit

s'arrêter

l'extraction

des

facteurs,

alors

que,

dans

l'analyse

classique,

on

retient

le

seuil

5

%

ou

6

%

suivant

les

auteurs.

L'analyse

des

correspondances

est

le

modèle

le

moins

restrictif,

car

elle

ne

distingue

pas

les

variables

et

les

observations.

Cette

remarque

est

fondamentale,

car

«

l'obligation

»

de

normalité

disparaît;

mais,

surtout,

il

est

possible

d'établir

une

factorisation

dans

les

deux

espaces

vectoriels

Rw

et

Rp,

et

il

existe

des

relations

étroites

entre

les

deux

groupes

de

facteurs,

permettant

de

résoudre,

au

moins

partiellement,

le

problème

de

l'auto-corrélation

spatiale.

Il

existe

une

autre

technique

d'analyse

multivariée,

la

régression

multiple.

Peu

prisée,

notamment

en

France,

elle

présente

cependant

trois

avantages

sérieux.

Les

traitements-calculs

sont

plus

simples,

caractère

non

négligeable,

à

moins

que

le

snobisme

ne

s'empare

du

géographe

et

que

seuls

les

outils

sophistiqués

ne

lui

paraissent

dignes

d'attention,

même

s'ils

sont

imparfaits.

D'autre

part,

l'hypothèse

de

normalité

est

levée.

En

effet,

le

géographe

peut

élaborer

pas

à

pas,

en

vérifiant

sur

des

papiers

fonctionnels

d'échelles

diverses,

un

modèle

précis,

qu'il

teste

dans

un

second

temps.

Ce

déroulement

pragmatique

des

opérations,

plus

lent,

permet

d'éviter

les

erreurs

grossières

qui

pullulent

dans

les

analyses

factorielles

actuellement

présentées.

Le

troisième

intérêt

est

d'ordre

épistémologique.

Les

multiples

techniques

factorielles,

qualifiées

à

tort

d'uniquement

descriptives,

sont

déjà

explicatives,

car

elles

permettent

de

mettre

à

jour

des

structures

cachées,

des

ordres

qui

sont

une

réponse

à

la

question

comment.

Mais

elles

ne

sont

pas

aptes

à

répondre

à

la

question

pourquoi.

6

6

7

7

8

8

1

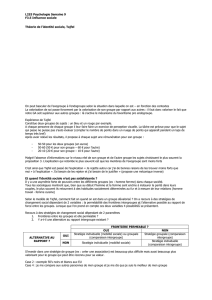

/

8

100%