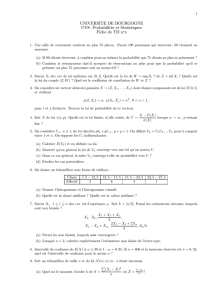

Statistique paramétrique

X1, . . . , Xn

•Xiα a

•(1 −α)N(0,1)

X1=a1+Y1(1 −1)1∼ B(α)Y1∼ N (0,1)

(δa+λ)⊗n

dPX1,...,Xn

d(δa+λ)⊗n(x1, . . . , xn) =

n

Y

i=1

(αIa(xi) + (1 −α)(1 −Ia(xi))φ(xi))

φN(0,1)

Yi

Yi=1i

0i

Y∗

i

m σ2i

Yi=1Y∗

i≥0

0Y∗

i<0

ΦN(0,1) YiΦ

m σ2

X1X2

λ1λ2X1X2

X∼ E(λ)⇔ ∀x > 0, P (X > x) = exp(−λx)

t

Z

n S1, . . . , Sn

Z1, . . . , Zn

λ1λ2

λ1λ2

θ > 0

fθ(x) = cθ(1 + x)e−θx1[0,+∞[(x)

E(X1)θ

K(θ0|θ1)

a λ a > 0λ > 0 (a, λ)Rγa,λ

γa,λ =λa

Γ(a)e−λxxa−11R+(x) Γ(a) = Z∞

0

e−xxa−1dx.

a > 1 Γ(a) = (a−1)Γ(a−1) n∈N∗Γ(n) = (n−1)!

X(a, λ)E(X) (X)

LX(t) := EetX =λ

λ−ta

t < λ.

X Y (a, λ) (b, λ)

X+Y

Y Y 2

n

χ2n

X S2

X1, . . . , Xnm σ2

X=1

n

n

X

i=1

Xi,Σ2=1

n

n

X

i=1

(Xi−m)2S2=1

n

n

X

i=1

(Xi−X)2.

Σ2σ2Σ2

σ2E(Σ2) = σ2S2

(Xi)N(m, Σ2)

X nΣ2/σ2

X S2

(Xi)X S2

φ Xi

m= 0 E(nS2)σ2E(nS2eitnX ) = (n−1)σ2φn(t)

t φ

φ00

φ−φ0

φ2

=−σ2

φ(0) = 1, φ0(0) = 0.

XiN(0, σ2)ψ(t) = log φ(t)

m= 0

1

/

2

100%