1. Rappels. Soit E une expérience aléatoire. L`ensemble des issues

Lycée A.Maurois

...... avril 2011 PROBABILITES T ES3

1. Rappels.

Soit Eune expérience aléatoire. L’ensemble des issues possibles lors de cette expérience sera noté Eet on se limite

au cas où Eest fini ; on notera nle nombre de ses éléments.

E={x1,x2,x3.......xn−1,xn}

2. Lien entre loi de probabilité sur E et statistiques.

a. Lien avec les statistiques.

Quand on répète l’expérience ENfois de suite, en notant chaque résultat obtenu, on obtient un échantillon de

taille Net on peut calculer quelle est la fréquence d’apparition de chacun des résultats possibles : on obtient

ainsi la distribution des fréquences des résultats possibles.

Pour deux échantillons de taille Nles distributions des fréquences sont différentes et on qualifie ce phénomène

de fluctuation d’échantillonnage.

Néanmoins, lorsque Ndevient de plus en plus grand, la fluctuation d’échantillonnage tend à devenir très faible,

ce qui signifie que la distribution des fréquences, pour des échantillons de très grandes tailles, tend, en quelque

sorte, vers une distribution “limite“ qu’on peut schématiser sous forme de tableau :

x∈E x1x2.... xi...... xn

P(x)p1p2..... pi...... pn

où les nombres pi, pour ientier dans [1; n], sont des nombres de [0; 1] qui vérifient

n

X

i=1

pi=1 ( pour “calquer”

les fréquences). Les nombres pi, pour ientier dans [1; n] sont les probabilités des issues xirespectivement.

b. Notion d’événement. Probabilité d’un événement. Loi de probabilité sur l’ensemble des parties de E.

On appelle “événement de E” toute partie de l’ensemble E. On note parfois P(E) l’ensemble des parties de E.

Si on considère Pcomme ci dessus, il devient possible d’attribuer une probabilité à tout événement de Ede la

façon suivante :

Soit Aune partie de E: la probabilité de Aest P(A)=X

itel que xi∈A

pi.

REGLES

•Soit la partie vide de Eon a P(∅)=0 (événement impossible)

•On a P(E)=1 (événement certain)

•Pour Aet Bdeux événements de Eon a P(A∪B)=P(A)+P(B)−P(A∩B)

•Pour Aévénement de Eon note Al’événement contraire de A. Cet événement est constitué des éléments de

Equi ne sont pas dans Aet on a P(A)=1−P(A).

La donnée de (E,P(E),P) est un espace probabilisé. On dit en abrégé que Pest une loi de probabilité sur Eou

que Eest muni de la loi de probabilité P.

Définition : Toute distribution Pdéfinie sur Ecomme dans 2.a et vérifiant les règles ci-dessus est dite loi de

probabilité sur E.

3. Espérance et variance d’une loi de probabilité sur E.

Lycée A.Maurois

...... avril 2011 PROBABILITES T ES3

a. Espérance de la loi Pnotée µ:µ=

n

X

i=1

pixi(moyenne pondérée par les probabilités)

b. Variance la loi Pnotée V:V=

n

X

i=1

pi(xi−µ)2

4. Probabilité conditionnelle.

Soit Eun ensemble muni d’une loi de probabilité Pet Aun événement de probabilité non nulle.

Pour tout Bun événement de E, on appelle probabilité de Bsachant (que ) A(est réalisé) le nombre :

PA(B)=P(A∩B)

P(A)

On a donc P(A∩B)=PA(B)×P(A) et ainsi écrite la formule prend le nom de “formule des probabilités

composées”.

5. Formule des probabilités totales et théorème de Bayes.

Soit Eun ensemble muni d’une loi de probabilité P.

Si certaines parties de E, deux à deux disjointes (i.e. d’intersection vide) sont telles que leur réunion vaut E, elles

constituent unepartition de Eou encore un système complet d’événements de E.

Soit A1,A2,.....Akune partition de Eet supposons que pour tout entier jdans [1; k] on ait P(Aj),0. On peut monter

facilement que pour tout événement Bde Eon a la formule des probabilités totales :

P(B)=

k

X

j=1

PAj(B)×P(Aj).

De là on tire aussi la “probabilité des causes” (Théorème de BAYES) :

PB(Ai)=PAi(B)×P(Ai)

Pk

j=1PAj(B)×P(Aj).

Exemples en exercices.

6. Notion d’événements indépendants et principe multiplicatif.

Soit Eun ensemble muni d’une loi de probabilité Pet Aet Bdeux événements de probabilités non nulle.

On dira que Aet Bsont indépendants si la réalisation de l’un n’influe pas sur la réalisation de l’autre ce qui se

traduit par l’une des trois propriétés suivantes et équivalentes :

PA(B)=P(B)⇐⇒ PB(A)=P(A)⇐⇒ P(A∩B)=P(A)×P(B).

Exemple : On lance deux fois de suite un dé cubique équilibré et on considère que le résultat lors d’un lancer

n’a aucune influence sur le résultat suivant. L’ensemble des issues possibles est l’ensemble des suite de 2 résultats

obtenus. Si on note A1; 3 l’événement avoir 3 au premier jet et A2; 5 avoir 5 au deuxième lancer. Alors A1; 3 et

A2; 5 sont indépendants et de probabilité 1/6 on en déduit que P((3 ;5))=1/36

Principe multiplicatif : plus généralement, soit Eune expérience aléatoire modélisée par un ensemble Emuni

d’une probabilité P. Si on répète n fois de suite l’expérience de sorte que les résultats obtenus à chaque étape

puissent être considérés comme indépendants les uns des autres, la probabilité d’une liste de résultats est le produit

des probabilités de chacun des résultats de la liste.

Exemple : lancer de dé 7 fois de suite : P(PPPFFFF)=(1/2)7

Lycée A.Maurois

...... avril 2011 PROBABILITES T ES3

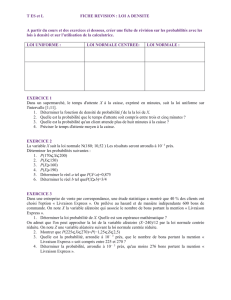

7. Epreuve de Bernouilli. Loi binômiale.

On est souvent amené à considérer une expérience aléatoire dont l’un des aspects nous intéresse et qu’on appelle

“succès”.

On modélise alors l’ensemble des issues possibles par un ensemble Eà deux éléments E={S;S},Sétant le succès

et Sl’évènement contraire et on note pla probabilité de S.

La loi sur Eest dite“ loi de Bernoulli de paramètre p” et est donnée par : Issue S S

Probabilité p q =1−p

Et l’expérience aléatoire correspondante est dite épreuve de Bernoulli.

Admis. La répétition de n épreuves indépendantes de Bernouilli de paramètre psuit la loi binômiale de paramètre

net p.

La probabilité d’UNE liste de nrésultats où figurent exactement ksuccès (kentiers compris entre 0 et n) vaut

pk(1 −p)n−k.

1

/

3

100%