Analyse de données médicales avec R

Biostatistiques avancées avec R

Tests de comparaison de base

Christophe Lalanne

www.aliquote.org

Modèles de régression

Principe de la régression linéaire

•La régression linéaire permet de modéliser la relation

linéaire entre une variable réponse continue et un

prédicteur d’intérêt.

•Expliquer les variations observées au niveau d’une

variable réponse (« dépendante ») numérique, y, en

fonction de variables prédictrices (« indépendantes »,

« explicatives »), xj, pouvant être de nature qualitative ou

quantitative.

•Prédire y(en moyenne ou pour un individu donné) selon

le modèle établi.

•La linéarité de la relation et l’influence des observations

sont deux aspects critiques de la validité des

résultats(4,2).

b3e9140 4 / 34

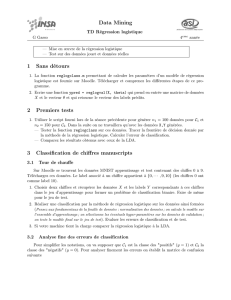

L’idée revient toujours à considérer qu’il existe une part systé-

matique et une part aléatoire (résidus) dans ces variations. Le

modèle linéaire permet de formaliser la relation entre yet les

xj, en séparant ces deux sources afin d’estimer la contribution

relative des xjdans les fluctuations de y.

Le modèle théorique relie fonctionnellement la réponse au(x)

prédicteur(s) de manière additive : E(y|x)=f(x;).

yi˜yi

b3e9140 5 / 34

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

1

/

34

100%