Notions de gradient stochastique.

Quelques notions sur

le gradient stochastique

Pr´

esentation du probl`

eme

min

u∈Uad⊂U

J(u) avec J(u) = Eju,w

La variable un’est pas al´eatoire : la mˆeme valeur de us’applique `a

toutes les valeurs prises par la variable al´eatoire w:boucle ouverte.

Si on est prˆet `a calculer des esp´erances, on retombe exactement sur

le cas de l’optimisation d´eterministe sur un ensemble admissible.

Mais on veut souvent ´eviter de tels calculs de l’esp´erance. . .

Exemple : calcul par Monte Carlo E[w] = arg min

u∈R

1

2E(u−w)2.

u(k+1) =1

k+ 1

k+1

X

l=1

w(l)

=u(k)−1

k+ 1 `u(k)−w(k+1)´

Iu(k)−w(k+1) : gradient de la fonction sous l’esp´erance ;

I1

k+1 : pas kde l’algorithme (k→0 “pas trop vite”).

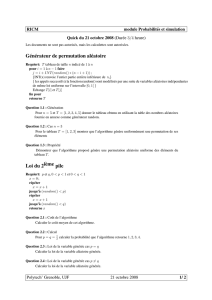

Algorithme du gradient stochastique

On remplace l’´evaluation du gradient de la fonction Jau point u(k)

(E∇uju(k),w) par une ´evaluation du gradient de la fonction j

pour une valeur w(k+1) de l’al´ea (∇uju(k),w(k+1)).

Algorithme.

1. Choisir u(0) ∈Uad et {(k)}k∈Nsuite de r´eels positifs.

2. `

A l’it´eration k, effectuer un tirage al´eatoire w(k+1) de w,

ind´ependamment des tirages pr´ec´edents (w(1), . . . , w(k)).

3. Remettre `a jour u`a l’aide du gradient de jen (u(k),w(k+1)) :

u(k+1) =projUad hu(k)−(k)∇uju(k),w(k+1)i.

4. Incr´ementer l’indice kde 1 et retourner `a l’´etape 2.

Mise en œuvre.

ITest d’arrˆet de l’algorithme.

IChoix des coefficients (k).

Propri´

et´

es du gradient stochastique

Convergence.

La suite des u(k)(vues comme des variables al´eatoires d´ependant

des tirages w(k)) converge presque-sˆurement vers la solution u]

(d´eterministe) du probl`eme. Les conditions sur les pas sont :

X

k∈N

(k)= +∞et X

k∈N(k)2<+∞.

IExemple standard :(k)=α

kγ+βavec γ∈1

2,1.

Vitesse asymptotique (Uad =U:pas de projection !).

On dispose d’un th´eor`eme de la limite centrale :

1

√(k)u(k)−u]L

−→ N0,Σ,

La vitesse maximale est obtenue pour γ= 1 ((k)=α

k+β).

Efficacit´

e asymptotique et moyennisation

Algorithme de type Newton.

Dans la classe des algorithmes `a gain matriciel :

u(k+1) =u(k)−A

k+β∇uju(k),w(k+1),

le minimum Σ?de la covariance Σ est atteint en A=∇2J(u])−1

Algorithme moyenn´e.

L’algorithme de gradient stochastique moyenn´e :

u(k+1) =u(k)−(k)∇uj(u(k),w(k+1)),

b

u(k+1) =1

k+ 1

k+1

X

l=1

u(l),

atteint la covariance minimale Σ?, avec (k)=α

kγ+β,1

2< γ < 1:

√kb

u(k)−u]L

−→ N0,Σ?.

6

6

1

/

6

100%