De nouveaux outils pour construire des modèles prédictifs

De nouveaux outils pour

construire des modèles prédictifs

PASW® Neural Networks 17.0 – Spécifications

Pour vous permettre de prendre de meilleures décisions

à chaque évolution, votre entreprise doit déterminer des

modèles et des connexions dans l’environnement complexe

et à forte évolutivité au sein duquel vous travaillez. Pour

vous aider dans cette tâche, vous utilisez peut être déjà

PASW Statistics Base* et un ou plusieurs de ses modules

compagnons. Dans ce cas, vous savez de quelle puissance

et de quelle souplesse vous pouvez disposer. Mais vous

pouvez aller encore beaucoup plus loin.

Avec PASW Neural Networks*, vous pouvez découvrir des

modèles subtils ou cachés dans vos données. Ce module

vous permet de faire apparaître des relations plus com-

plexes et génère des modèles prédictifs plus performants.

Les procédures de PASW Neural Networks complètent les

statistiques plus traditionnelles de PASW Statistics Base

et de ses modules. Avec PASW Neural Networks, vous

pouvez trouver de nouvelles relations dans vos données

puis vérifier leur signification avec des techniques

statistiques traditionnelles.

PASW Neural Networks peut être installé en tant que

logiciel client uniquement, mais, pour de meilleures per-

formances et afin d’assurer son évolutivité, vous pouvez

également l’utiliser dans une configuration client/serveur,

avec PASW Statistics Server*.

Pourquoi utiliser un réseau neuronal ?

Un réseau neuronal est un ensemble d’outils de modélisa-

tion pour des données non linéaires composé de couches

d’entrée et de sortie plus une ou deux couches cachées.

A chaque connexion entre les neurones d’une même

couche correspond un “poids” spécifique qui est ajusté

de façon itérative par l’algorithme d’apprentissage afin de

minimiser les erreurs et de fournir des prédictions précises.

Vous définissez les conditions dans lesquelles le réseau

“apprend” et vous pouvez contrôler de façon très fine les

règles d’arrêt de l’apprentissage. Vous pouvez également

définir l’architecture du réseau ou bien laisser la procédure

déterminer automatiquement cette architecture pour vous.

Dans un grand nombre de domaines, PASW Neural Networks

combiné à d’autres procédures statistiques vous permet

d’obtenir une vue plus claire. Pour les études de marché par

exemple, vous pouvez créer des profils client et découvrir

les préférences de vos clients. En marketing de base de

données, vous pouvez segmenter votre base de clients et

rentabiliser les campagnes de marketing.

En analyse financière, vous pouvez utiliser PASW Neural

Networks pour déterminer la solvabilité des clients deman-

dant un crédit et détecter d’éventuelles fraudes. Dans

l’analyse d’exploitation, utilisez ce nouvel outil pour gérer

la trésorerie et améliorer la planification logistique. Les

applications scientifiques et de santé incluent quant à

elles la prévision des coûts de traitement, l’analyse des

résultats médicaux et la prédiction de durée d’un séjour

en hôpital.

Contrôlez le processus du début à la fin

Avec PASW Neural Networks vous sélectionnez la procé-

dure Multilayer Perceptron (MLP) ou la procédure Radial

Basis Function (RBF).

Ces deux procédures correspondent à des techniques

d’apprentissage supervisées, c’est-à-dire qu’elles mettent

en correspondance les relations impliquées par les don-

nées. Toutes deux utilisent des architectures “feedforward”,

ce qui signifie que les données se déplacent dans une seule

direction depuis les nœuds d’entrée, à travers les nœuds

de la couche masquée jusqu’aux nœuds de sortie. Le choix

de la procédure est déterminé par le type de données dont

vous disposez et par le niveau de complexité que vous

cherchez à découvrir. La procédure MLP permet de

trouver des relations plus complexes. La procédure RBF

est généralement plus rapide.

* PASW Neural Networks, PASW Statistics Base et PASW Statistics Base

Server, précédemment SPSS Neural Networks

™

, SPSS Statistics Base

et SPSS Statistics Base Server, font partie du portefeuille de logiciels

d’analyse prédictive de SPSS Inc.

Avec l’une ou l’autre de ces procédures, vous divisez vos

données en trois ensembles : ensemble d’apprentissage,

ensemble de test et ensemble pilote (holdout). L’ensemble

d’apprentissage est utilisé pour estimer les paramètres du

réseau. L’ensemble de test sert à éviter tout “surapprent-

issage”. L’ensemble pilote ou “holdout” permet d’évaluer

de façon isolée le réseau final, qui sera ensuite appliqué

à la totalité de l’ensemble de données et à toute nouvelle

donnée.

Vous spécifiez les variables dépendantes qui peuvent être

des variables numériques, nominales ou une combinaison

des deux. Si une variable dépendante a un niveau de

mesure numérique, alors le réseau neuronal prédit les

valeurs continues qui s’approchent de la valeur “vraie”

d’une fonction continue des données d’entrée. Si une

variable dépendante est nominale, alors le réseau

neuronal est utilisé pour classifier les cas en “meilleure”

catégorie en fonction des prédicteurs d’entrée.

Vous rdéfinissez le modèle en choisissant le mode de

partitionnement des ensembles de données, le type

d’architecture souhaité et les ressources de traitement à

appliquer à l’analyse. Enfin vous spécifiez l’affichage des

résultats sous forme de tableaux ou de graphiques, vous

précisez si l’enregistrement des variables temporaires

optionnelles doit se faire dans l’ensemble de données

actif et si l’export des modèles se fait vers des formats

de fichier XML pour scorer les données futures.

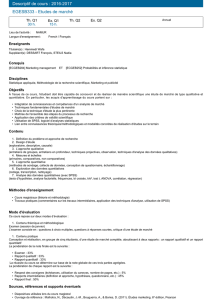

Dans un réseau MLP comme celui illustré ici, les données

sont transmises d’une couche d’entrée via une ou plusieurs

couches masquées vers la couche de sortie.

Caractéristiques

Multilayer Perceptron (MLP)

La procédure MLP s’adapte à un type particu-

lier de réseau neuronal appelé “perceptron

multicouche”. Le perceptron multicouche

est une méthode supervisée utilisant

l’architecture “feedforward”. Il peut com-

porter plusieurs couches masquées. Une ou

plusieurs variables dépendantes peuvent

être spécifiées. Il peut s’agir de variables

numériques, nominales ou d’une combinaison

des deux. Si une variable dépendante a un

niveau de mesure numérique alors le réseau

neuronal prévoit les valeurs continues qui

approchent la valeur “vraie” d’une fonction

continue des données d’entrée. Si une

variable dépendante est nominale, le réseau

neuronal est utilisé pour classifier les cas

en “meilleure” catégorie en fonction des

prédicteurs d’entrée.

n Prédicteurs

– Facteurs

– Covariables

n La sous-commande EXCEPT répertorie sur

la ligne de commande toutes les variables

que la procédure MLP doit exclure des

listes de facteurs ou de covariables. Cette

sous-commande est utile si les listes de

facteurs ou de co-variables contiennent un

grand nombre de variables.

n La sous-commande RESCALE sert à

redimensionner les covariables ou les

variables dépendantes numériques

– Variable dépendante (si numérique) :

standardisée, normalisée, ajustée

normalisée ou néant

– Covariables : standardisée, normalisée,

normalisée ajustée ou néant

n La sous-commande PARTITION spéci-

fie la méthode de partitionnement de

l’ensemble de données actif en échan-

tillon d’apprentissage, échantillon de

test et échantillon pilote. L’échantillon

d’apprentissage inclut les enregistrements

de données utilisés pour former le réseau

neuronal. L’échantillon de test est un

ensemble indépendant d’enregistrements

de données utilisés pour assurer le

suivi des erreurs de prédiction pendant

l’apprentissage afin d’empêcher le surap-

prentissage. L’échantillon pilote ou “hold-

out” est un autre ensemble indépendant

d’enregistrements de données utilisés pour

évaluer le réseau neuronal final. Vous pou-

vez spécifier :

– Le nombre relatif de cas dans l’ensemble

de données actif à affecter de façon

aléatoire à l’échantillon d’apprentissage

– Le nombre relatif de cas dans l’ensemble

de données actif à affecter de façon aléa-

toire à l’ensemble pilote.

– Une variable qui assigne chaque cas

de l’ensemble de données actif à

l’échantillon Apprentissage, Test ou

Pilote

n la sous-commande ARCHITECTURE est utili-

sée pour spécifier l’architecture de réseau

neuronal. Vous pouvez spécifier :

– si l’architecture automatique doit ou non

être utilisée :

– Le nombre de couches masquées du

réseau neuronal

– La fonction d’activation à utiliser pour

toutes les unités des couches masquées

(Tangente hyperbolique ou Sigmoid)

– La fonction d’activation à utiliser pour

toutes les unités de la couche de sor-

tie (Identité, tangente hyperbolique,

Sigmoid ou Softmax)

n La sous-commande CRITERIA spécifie les

paramètres de calcul et de ressource pour

la procédure MLP. Vous pouvez spécifier

le type d’apprentissage ce qui va déter-

miner la façon dont le réseau neuronal

traite les enregistrements de données

d’apprentissage : apprentissage par lots,

apprentissage en ligne, apprentissage par

mini-lots. Vous pouvez également spécifier:

– Le nombre d’enregistrements

d’apprentissage par mini-lots (si

cette méthode est sélectionnée pour

l’apprentissage)

– Le nombre maximum de cas à enregistrer

en mémoire lorsque la sélection est :

architecture automatique et/ou apprent-

issage par mini-lots

– L’algorithme d’optimisation utilisé pour

déterminer les poids synaptiques :

Méthode du gradient, gradient conjugué

– La vitesse d’apprentissage initiale

pour l’algorithme d’optimisation de la

Méthode du gradient

– La limite inférieure pour la vitesse

d’apprentissage lorsque la Méthode du

gradient est utilisée avec l’apprentissage

en ligne ou par mini-lots

– La vitesse de propagation pour

l’algorithme d’optimisation de la

Méthode du gradient

– Le lambda initial pour l’algorithme

d’optimisation du gradient conjugué

numérique

– Le sigma initial pour l’algorithme

d’optimisation du gradient conjugué

numérique

– L’intervalle [a0−a, a0+a] dans lequel les

vecteurs de poids sont générés de façon

aléatoire lorsque l’hybridation simulée

est utilisée

Les résultats de l’exploration des données à l’aide des techniques des

réseaux neuronnaux peuvent être affichés avec toute une variété de

graphiques. Ce simple diagramme à barres est l’une des nombreuses

options possibles.

A partir de la boîte de dialogue Multilayer Perceptron (MLP),

vous sélectionnez les variables à inclure dans votre modèle.

Pour en savoir plus, visitez www.spss.com. Pour les adresses et numéros de téléphone

de SPSS, visitez www.spss.com/worldwide.

SPSS est une marque déposée et les autres produits SPSS Inc. nommés sont des marques de SPSS Inc.

Tous les autres noms sont des marques appartenant à leur détenteur respectif. © 2009 SPSS Inc. Tous droits

réservés. SN1702SPC-0209-FR

n La sous-commande STOPPINGRULES

spécifie les règles d’arrêt de l’apprentissage

du réseau neuronal. Vous pouvez spécifier :

– Le nombre d’étapes à autoriser avant

de vérifier toute diminution de l’erreur

de prédiction

– Si le temporisateur d’apprentissage

est activé ou non et le temps

d’apprentissage maximum

– Le nombre maximum d’époques

(intervalles de mesure)

– Le changement relatif au niveau du

critère d’erreur d’apprentissage

– Le critère de taux d’erreur

d’apprentissage

n La sous-commande MISSING est utilisée

pour déterminer si les valeurs utilisateur

manquantes pour les variables nominales

(c’est-à-dire, les facteurs et les variables

dépendantes nominales) sont traitées ou

non comme des valeurs valides

n La sous-commande PRINT spécifie le type

de sortie tabulaire à afficher et peut être

utilisée pour demander une analyse de

sensibilité.

Vous pouvez choisir d’afficher :

– Le tableau résumé de traitement des cas

– Des informations sur le réseau neuronal,

y compris les variables dépendantes, le

nombre d’unités d’entrée et de sortie, le

nombre de couches et d’unités cachées

et les fonctions d’activation

– Un résumé des résultats du réseau

neuronal, incluant l’erreur générale

moyenne, la règle utilisée pour

arrêter l’apprentissage et le temps

d’apprentissage

– Un tableau de classification pour chaque

variable dépendante nominale

– Les poids synaptiques, c’est-à-dire les

estimations de coefficients, depuis la

couche i−1, unité j jusqu’à la couche i,

unité k

– Une analyse de sensibilité qui calcule

l’importance de chaque prédicteur dans

la détermination du réseau neuronal

n La sous-commande PLOT indique la sortie

graphique à afficher. Vous pouvez afficher:

– Le diagramme du réseau

– Un graphique de prévision par valeur

observée pour chaque variable

dépendante

– Un graphique résiduel par valeur prédite

pour chaque variable dépendante

numérique

– Des courbes ROC (Receiver Operating

Characteristic) pour chaque variable

dépendante nominale. La sous-com-

mande PRINT affiche également un

tableau spécifiant la zone correspondant

à chaque courbe.

– Des graphiques de gains cumulatifs pour

chaque variable dépendante nominale

– Des graphiques de “lift” pour chaque

variable dépendante nominale

n La sous-commande SAVE écrit des variables

temporaires optionnelles dans l’ensemble

de données actif. Vous pouvez enregistrer

les données suivantes :

– Valeur ou catégorie prédite

– Pseudo-probabilité prédite

n La sous-commande OUTFILE enregistre les

fichiers au format XML contenant les poids

synaptiques estimés.

Radial Basis Function (RBF)

La procédure RBF est utilisée pour un réseau

neuronal RBF qui est un réseau d’apprentissage

supervisé de type “feedforward” comportant

une couche d’entrée, une couche masquée

appelée “la couche RBF” et une couche de

sortie. La couche masquée transforme les

vecteurs d’entrée en fonctions à base radiale.

Comme la procédure MLP, la procédure RBF

exécute la prédiction et la classification.

La procédure RBF réalise l’apprentissage du

réseau en deux étapes :

1. La procédure détermine les fonctions

radiale s de base en utilisant des méthodes

de clustering. Le centre et la largeur de

chaque fonction sont déterminés.

2. La procédure estime les poids synaptiques

à partir des fonctions radiales de base. La

fonction d’erreur de la somme des carrés

avec fonction d’activation d’identité pour

la couche de sortie est utilisée à la fois pour

la prédiction et pour la classification. La

méthode des moindres carrés est utilisée

pour réduire l’erreur de la somme des carrés.

Du fait de cette approche en deux étapes pour

l’apprentissage, le réseau RBF est en général

estimé plus rapidement que le réseau MLP.

Les sous-commandes répertoriées pour la

procédure MLP exécutent des fonctions

similaires pour la procédure RBF avec les

exceptions suivantes :

n Avec la sous-commande ARCHITECTURE, il

est possible de spécifier la fonction à base

radiale Gaussian utilisée dans la couche

masquée : RBF Normalisé ou RBF Ordinaire

n Avec la sous-commande CRITERIA, il est

possible de spécifier les paramètres de

calcul des procédures RBF, en précisant la

quantité de recouvrement entre les unités

masquées

Configuration système

n Logiciel : PASW Statistics Base 17.0

n Les autres pré-requis système varient en

fonction du système d’exploitation

Ces fonctions sont susceptibles d’être modifiées en

fonction de la version finale du produit

1

/

3

100%