LA PARTICULE DE DIEU

LA PARTICULE

DE DIEU

LA PARTICULE

DE DIEU

À LA DÉCOUVERTE

DU BOSON DE HIGGS

TRADUIT DE L’ANGLAIS PAR BENOÎT CLENET

Jim Baggott

L’édition originale de cet ouvrage a été publiée en

anglais en 2012 par Oxford University Press, sous le titre:

Higgs: The Invention and Discovery of the ‘God particle’.

Higgs: The Invention and Discovery of the ‘God Particle’,

First Edition was originally published in English in

2012. This translation is published by arrangement with

Oxford University Press.

Conception de la couverture : Raphaël Tardif

Illustration de couverture :

Simulation de la désintégration d’un boson de Higgs en

4 muons (traces jaunes) par ATLAS. © 1995 CERN

© Dunod, Paris, 2013, pour la traduction française

ISBN 978-2-10-059717-8

PRÉFACE

Nombreuses sontlesdécouvertes scientifiquesmajeuresquiontété

suiviesd’ouvragesdevulgarisationrelatantcesaventuresaucommun

desmortels.Maisc’estlapremièrefoisquejevoisunlivreayantété

rédigé,dansunelargemesure,paranticipationd’unedécouverte.La

rapiditéaveclaquellecelivreaétépublié,aussitôtaprèsl’annoncefaite

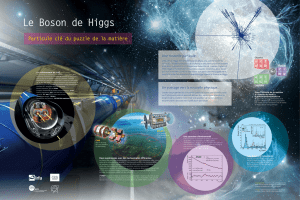

enjuillet2012 deladécouverteauCERN(etd’uneconfirmationdu

Fermilab)d’unenouvelleparticulequisemble êtrelaparticuledeHiggs,

témoignedel’énergie etdel’ardeur remarquablesdeJimBaggott et

d’OxfordUniversityPress.

Lapromptepublicationdecetouvrageatteste égalementdugrand

intérêtdeslecteurspourcettedécouverte.Ilseraitdoncopportunque

j’ajoutedanscettepréfacequelquesremarquespersonnellesausujetde

cequiaétéaccompli.Onentendsouventdirequederrièrelaquête

dubosondeHiggs setrouvel’originedelamasse.Certes,maiscette

explicationnécessitequelqueséclaircissements.

Danslesannées1980,nousavionsunebonnethéoriequirendait

comptedetouteslesparticulesélémentairesobservéesetdesforces(autres

quelagravitation)qu’ellesexercententre elles.L’undesingrédients

essentielsdecettethéorie estunesymétrie,telleunerelationdeparenté,

quireliedeuxdecesforces:laforce électromagnétique etlaforce

nucléairefaible.L’électromagnétisme estàl’originedelalumière;

laforcefaiblepermetauxparticulesauseindesnoyauxatomiquesde

changerd’identitédansdesprocessusdedésintégrationradioactive.Cette

symétriefusionnelesdeuxforcesenuneseuleinteraction«électrofaible».

Lespropriétésgénéralesdelathéorie électrofaibleontététestéesavec

succès.LesexpériencesréaliséesrécemmentauCERNetauFermilab

Dunod–Toutereproduction nonautorisée estundélit.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

1

/

20

100%