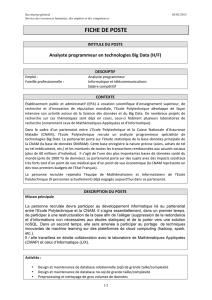

Langages Centrés Données Master 2 Fiil Données massives

2/47

Plan

1Indexation/ImplantationdesOpérateurs/Calculdecoût✔

2RappelsJDBC/ImpedanceMismatch/JPA&Hibernate✔

3XML:Généralités,langageXPath✔

4LeLangageℂDuce✔

5Évaluationefficaced'XPath✔

6DonnéesMassive,MapReduce

6.1PropriétésetlimitesdesbasesSQL

6.2ParadigmeMapReduce

6.3HadoopetHDFS

6.4HiveetHiveQL

3/47

SQL

Le standard SQL spécifie un grand nombre d'aspects des bases de données

relationnelles:

Unlangagederequête( )

Unlangagedemodificationdedonnées( , )

Unlangagedeschémaetdecontraintes

Unlangagedeprogrammation(SQL/PSM)

Unmodèledeconcurrence(transactions, , , )

4/47

Garanties

Le modèle relationnel et les bases de données SQL offrent des garanties très

fortes:

Atomicity (Atomicité) : chaque transaction est du « tout ou rien ». Il est

impossible pour quelqu'un en dehors de la transaction d'observer une étape

intermédiaire.

Consistency (Cohérence) : chaque transaction fait passer la base d'un état

cohérentàunnouvelétatcohérent.Toutedonnéesauvegardéedanslabasedoit

êtrevalidevisàvisd'unensemblederègles(types,contraintes,triggers,…).

Isolation:l'exécutionconcurrentededeuxtransactionsT1etT2doitêtrela

mêmequeleurexécutionséquentielle.

Durability(Durabilité):unetransactionconfirmée( )lerestemêmeen

casdeproblèmes(pertedecourant,erreurinterne,…).

5/47

Quelimpact?

MaintenirunmodèleACIDaunimpacténormesurlesperformances(créationde

snapshots

, mise en place de verrous coûteux, attente de confirmation par le

disquequelesdonnéessontsauvées,…).

Commentaugmenterlesperformancesetlevolumedesdonnées?

Prendreun serveurplus puissant(ex. OracleExadata de40000à1 300000

USD+souscriptionmensuelle,entretien,…)

Mettreplusieursserveurs?Trèsdifficile,pourquoi?

6/47

DistributionetmodèleACID

Ilexistedeuxmodèlesdedistributionpossible:

Plusieursserveurscontenantchacununecopiecomplètedelabase:

Performancesaccruespourlesrequêtes

Diversitégéographiquepossible(plusgranderésistanceauxévènement

extérieurs)

Baissedesperformancespourlesmisesàjour

Nepermetpasdestockerplusdedonnéesquesurunseulserveur

Partitionnementdesdonnées.UnerelationRpeutêtredécoupésenmorceaux

R1,…,R1,disposéssurdes machines différentes. Ledécoupagepeut se faire

parcolonnesouparlignes.

Augmentationdelacapacitédestockageglobale

Jointures très coûteuses si deux colonnes sont sur deux machines

différentes

Agrégatscoûteuxsileslignessontsurdeuxmachinesdifférentes

Unemachineenpanneouinaccessiblecompromettoutlesystème

7/47

LemodèleACIDest-iltoujoursadapté?

LemodèleACIDestparfoistropcontraignant:

Systèmederéservationdebilletsd'avion?ModèleACIDnécessaire

Calcul du nombre de messages envoyé par utilisateurs de chaque tranche

d'âge,surFacebook?ModèleACIDinutile

Yat-ilunmodèlealternatif?

8/47

ThéorèmedeBrewer

Lethéorème(énoncécommeuneconjectureen1999parE.Breweretprouvéen

2004)ditquedansunsystèmedistribuépartageantdesdonnées,auplus2des3

propriétéssuivantespeuventêtreoptimale:

Consistency(cohérence):touslesnœudsdecalculvoientlesmêmedonnées

aumêmemoment

Availability (disponibilité) : chaque requête reçoit une réponse de succès ou

d'échec

Partition tolerence (tolérance aux pannes) : le système continue de

fonctionner correctement malgré un découpage arbitraire lié à des pannes

réseau

Le théorème en lui-même est souvent mal interprété. Il a surtout été énoncé

(d'aprèsBrewer)pourinciterlesgensàexplorerd'autresmodèles/compromis.

9/47

ModèleBASE

LemodèleBASEestrégitparlespropriétéssuivantes:

BasicallyAvailable(toujoursdisponible):lesystèmes'efforcederépondreà

unerequête,quelquesoitsonétat

Soft state (état « mou ») : l'état interne du système peut changer sans

interventiond'unutilisateur

Eventuallyconsistent(cohérentauboutd'untempsfini):sionlaissepasser

suffisammentdetempsentredeuxmisesàjouroupannes,lesystèmeconverge

versunétatcohérent

10/47

Exempleconcret

OnconsidèreunsystèmeavecdeuxnœudsN1etN2:

MiseàjourMsuividedeuxfoislamêmerequêteQ:

ACID : si M est dans une transaction, alors Q s'effectue strictement

aprèsMetlesdeuxinstancesdeQrenvoientlemêmerésultat

BASE : les deux instances de Q peuvent renvoyer des résultats

différents,Mpeuts'exécuterenmêmetempsqueQetnemêmepasêtre

fini.

N2tombeenpanne:

ACID:lesystèmeentierestenpanne

BASE:N1continuederépondre

11/47

QuepeutonfaireavecBASE?

LemodèleBASEpermetdecréerdessystèmescomposésdeplusieursnœuds,

capable de stocker des données indépendemment et de répondre rapidement.

Commentlemettreàprofit?

12/47

Plan

1Indexation/ImplantationdesOpérateurs/Calculdecoût✔

2RappelsJDBC/ImpedanceMismatch/JPA&Hibernate✔

3XML:Généralités,langageXPath✔

4LeLangageℂDuce✔

5Évaluationefficaced'XPath✔

6DonnéesMassive,MapReduce

6.1PropriétésetlimitesdesbasesSQL✔

6.2ParadigmeMapReduce

6.3HadoopetHDFS

6.4HiveetHiveQL

13/47

Programmationfonctionnelle,leretour

UnpeudecodeOCamlpoursedétendre

14/47

Lesitérateursmapetfold

:

:

detype( → ) → list → list ,prendenargumentunefonction

et une liste d'éléments et applique la fonction à chaque élément. Elle

renvoielalistedesélémentstransformés(danslemêmeordre).

detype( → → ) → → list → ,prendunefonctiond'agrégat,

unaccumulateurinitialetunelisted'élémentquisontpasséstouràtourà

lafonction.Lavaleurfinaledel'accumulateurestrenvoyée.

15/47

Visuellement

map

fffff

fold

f

f

f

f

f

16/47

Propriétésdemapetfold?

Lescollectionsdedépartsontinchangées

lesapplications delatransformationpar sont indépendantes, leur ordre

d'applicationn'estpasimportant

pour , l'ordre n'est pas important si l'agrégateur est associatif et

commutatif

CesobservationssontàlabasedeMapReduce

17/47

MapReduce

PopulariséparJeffreyDeanetSanjayGhemawatdansl'article:

MapReduce:SimplifiedDataProcessingonLargeClusters

(OSDI,2004)

Remarque: le paradigme n'est pas nouveau (BD distribuées, langages

fonctionnels), mais l'article l'a popularisé et a permis l'arrivée

d'implémentationsOpen-Sourcerobustes.

Cadre : on dispose d'un grand nombre de machines, dont chacune dispose

localementd'unensemblededonnées(distinctdesautres).Unnœudparticulier

jouelerôled'orchestrateurlesautressontdestravailleurs(workers).

UnetransformationMapReducesedécomposeentroisphases:

1.PhaseMap

2.PhaseShuffle

3.PhaseReduce(fold)

18/47

Préambule

Leprogrammeurfournitdeuxtransformations:

→

→

19/47

PhaseMap

Lorsdelaphase ,l'orchestrateurexécuteunecopiedelatransformationmap

sur chaque worker. Chacun ne transforme que les données qu'il possède

localement.

La fonction reçoit ses données d'entrées sous la forme d'une paire clé,

valeur (par exemple (nom defichier, fichier) ou (id, ligne correspondant à l'id

dansunetable)).

Lafonctionrenvoiecommerésultatunelistedevaleurtransformées associéà

uneclédegroupe

20/47

PhaseShuffle

Lorsque la phase est terminée sur tous les nœuds, les données sont

échangéesentrenœudsetgroupéesselonlaclédegroupe

Cetteopérationestunebarrière,ellenepeutseproduirequ'après lafindela

phase .Deplusellenécessitel'échangededonnéessurleréseau(coûteux).

6

6

7

7

8

8

9

9

10

10

11

11

12

12

1

/

12

100%