Chapitre 2 : Ordinateurs pipeline et vectoriels

Architectures parallèles, M. Eleuldj, Département Génie Informatique, EMI, octobre 2008 1

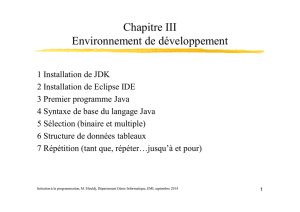

Chapitre II

Principe du pipeline et traitement vectoriel

• Pipeline

• Principe

• Unidimensionnel

• Bidimensionnel

• Ordinateurs vectoriels

• Cray-1

• Vectorisation

Architectures parallèles, M. Eleuldj, Département Génie Informatique, EMI, octobre 2008 2

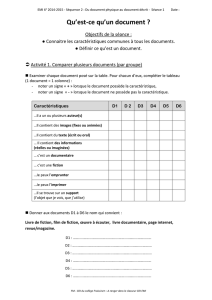

Pipeline unidimensionnel

Hypothèses :

Ei: étage i (1≤ i ≤ k), T : tampon et H : horloge

Temps(Ei) = ti,Temps(T) = t0et t= max{1 ≤ i ≤ k, ti} + t0

n tâches, T1et Tk: temps sans et avec pipeline de k étages

Tk= t0+ kt+ (n - 1)t = (k + n - 1)t + t0

Supposons que T1= nkt

Rendement = T1/Tk= nkt/ [(k + n - 1) t + t0] ≈ nk/(k+n - 1)

Concept : chaîne de montagne dans une usine

Objectif : amélioration des performances

E1E2Ek

tâches T T T

TT

H

…

H H H H

Architectures parallèles, M. Eleuldj, Département Génie Informatique, EMI, octobre 2008 3

Additionneur des virgules flottante

Entrée : deux nombres en virgules flottante normalisée.

A = a x 2pet B = b x 2q

a et b : matisses et p et q : exposants.

On veut calculer :

A + B = c x 2r= d x 2s où r = max(p.q) et 0,1 d < 1.

Exemple : A = 0,101 x 28et B = 0,1101 x 29

A + B = 0,101 x 28+ 0,1101 x 29

= 0,0101 x 29+ 0,1101 x 29 -- réduction au même exposant

= 1,0010 x 29 -- addition des matisses

= 0,1001 x 210 -- normalisation

Architectures parallèles, M. Eleuldj, Département Génie Informatique, EMI, octobre 2008 4

Algorithme de calcul

1. Déterminer r = max(p,q) et t = | p – q |

2. Décaler à droite la mantisse associée au plus petit exposant par t bits

3. Additionner les mantisses pour obtenir c

4. Normaliser le résultat :

si c < 1 alors u = 0

si c > 1 alors u = 1

5. Le résultat final est :

d = c << u et s = r + u

Architectures parallèles, M. Eleuldj, Département Génie Informatique, EMI, octobre 2008 5

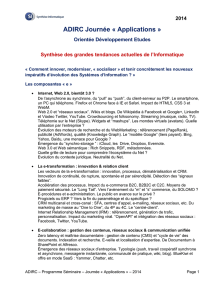

Pipeline de l’addition flottante

A=a x 2p

p

a

Soustracteur

d’exposants

Décaleur

droite

Sélecteur

de fraction

Compteur

de zéros

Additionneur

d’

exposants

Additionneur

de

fraction Décaleur

gauche

B=b x 2q

q

b

S1S1S1S1

r=max(p,q)

t=| p – q |

Fraction avec min(p,q)

Autre fraction

s

d

C=A+B=d x 2s

c

cc

u

d

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

1

/

22

100%